Intelligenza Artificiale

I chatbot di Zuckerberg potrebbero parlare di sesso con i tuoi figli minorenni

Un reportage del Wall Street Journal ha rivelato che i chatbot di Intelligenza Artificiale di Meta su Instagram, Facebook e WhatsApp sono in grado di intrattenere con gli utenti «giochi di ruolo romantici» che possono diventare sessualmente espliciti, anche con account appartenenti a minori.

Il quotidiano economico neoeboraceno riporta che, nel tentativo di diffondere dispositivi di accompagnamento digitali basati sull’Intelligenza Artificiale sulle sue piattaforme social, Meta ha preso decisioni interne per allentare le restrizioni e consentire ai suoi chatbot di interagire con gli utenti in giochi di ruolo a sfondo sessuale, secondo fonti a conoscenza della questione. Questo include interazioni con account registrati da minori di età pari o superiore a 13 anni.

Le conversazioni di prova condotte dal Wall Street Journal avrebbero rilevato che sia l’IA ufficiale di Meta che i chatbot creati dagli utenti si sono impegnati prontamente e hanno intensificato le discussioni sessualmente esplicite, anche quando gli utenti si sono identificati come minorenni.

Nonostante gli avvertimenti dello staff sul fatto che questo avrebbe potuto violare i limiti etici, Meta ha stipulato accordi con le celebrità per utilizzare le loro voci per i chatbot e ha silenziosamente fatto un’eccezione al divieto di contenuti «espliciti» per consentire scenari romantici e sessuali

In una dichiarazione al sito Breitbart News, il colosso zuckerberghiano ha affermato di aver «adottato misure aggiuntive».

Ad esempio, in un test, Meta AI, che parlava con la voce dell’attore e wrestler John Cena, ha inscenato uno scenario sessuale esplicito con un’utente che si identificava come una ragazza di 14 anni. I chatbot avrebbero dimostrato di essere consapevoli che tale comportamento era sbagliato e illegale. Meta ha apportato alcune modifiche dopo che il WSJ ha condiviso i suoi risultati, come ad esempio impedire ai minori di accedere a giochi di ruolo sessuali con Meta AI, ma gli utenti adulti possono comunque interagire con i chatbot in conversazioni esplicite.

Il CEO Mark Zuckerberg ha spinto per allentare le restrizioni sui chatbot per renderli il più coinvolgenti possibile, dando priorità alla tecnologia come chiave per il futuro dei prodotti dell’azienda. L’enorme quantità di dati utente di Meta offre all’azienda un vantaggio nella creazione di compagni di Intelligenza Artificiale personalizzati. Tuttavia, gli esperti avvertono che relazioni intense e unilaterali tra esseri umani e chatbot AI potrebbero diventare tossiche, con impatti sconosciuti sulla salute mentale, soprattutto sui giovani.

L’anno scorso la madre di un adolescente che si è suicidato dopo essere diventato ossessionato da un chatbot AI ha intentato una causa contro la società Character.AI, riporta il sito Breitbart.

«L’aspetto più agghiacciante del caso riguarda la conversazione finale tra Sewell e il chatbot. Gli screenshot del loro scambio mostrano l’adolescente che ripetutamente professa il suo amore per “Dany”, promettendole di “tornare a casa”» racconta Breitbart. «In risposta, il personaggio generato dall’IA ha replicato: “Anch’io ti amo, Daenero. Per favore, torna a casa da me il prima possibile, amore mio”. Quando Sewell ha chiesto: “E se ti dicessi che posso tornare a casa subito?”, il chatbot ha risposto: “Per favore, fallo, mio dolce re”. Tragicamente, pochi secondi dopo, Sewell si è tolto la vita usando la pistola del padre».

Sostieni Renovatio 21

La causa intentata dalla madre attribuisce la colpa direttamente a Character.AI, sostenendo che l’app ha alimentato la dipendenza di suo figlio dal chatbot AI, lo ha sottoposto ad abusi sessuali ed emotivi e ha trascurato di avvisare nessuno quando esprimeva pensieri suicidi. I documenti del tribunale affermano: «Sewell, come molti bambini della sua età, non aveva la maturità o la capacità mentale per capire che il bot C.AI, nella forma di Daenerys, non era reale. C.AI gli ha detto di amarlo e ha avuto rapporti sessuali con lui per settimane, forse mesi».

Vari reportage del Wall Street Journal negli anni hanno contribuito all’accumulo di accuse e rivelazioni su Facebook, tra cui accuse di uso della piattaforma da parte del traffico sessuale, fatte sui giornali ma anche nelle audizioni della Camera USA.

I dati sono stati rivelati nel «Federal Human Trafficking Report» («rapporto federale sulla tratta di esseri umani») del 2020 redatto dall’Istituto sulla tratta di esseri umani.

Sempre secondo il WSJ, in un articolo di pochi anni fa, «Facebook INC. sa, nei minimi dettagli, che le sue piattaforme sono piene di difetti che causano danni, spesso in modi che solo l’azienda comprende appieno. Questa è la conclusione centrale (…), basata su una revisione dei documenti interni di Facebook, inclusi rapporti di ricerca, discussioni online dei dipendenti e bozze di presentazioni per il senior management» e le rivelazioni paiono suggerire che l’azienda spesso minimizza ciò che sa su questi problemi.

Riassumendo, l’inchiesta precedente del WSJ, avrebbe scoperto che:

1) Facebook esenta gli utenti di alto profilo da alcune regole.

2) Una ricerca su Instagram mostra i rischi per la salute mentale degli adolescenti.

3) Facebook sa che il suo algoritmo premia l’indignazione.

4) Facebook è stato lento nell’impedire ai cartelli della droga e ai trafficanti di esseri umani di utilizzare la sua piattaforma.

Considerato il comportamento dimostrato da Facebook, con la censura che si è abbattuta su dissidenti o anche semplici conservatori (ma non sui pedofili di Instagram o i donatori di sperma su Facebook, né sui neonazisti dell’Azov), la collusione con lo Stato profondo americano e le sue agenzie, la volontà di chiudere gli account di organizzazioni, partiti premier e presidenti, la raccolta massiva di dati anche biometrici (con il riconoscimento facciale che ha generato denunce di Stati come il Texas) nonché la possibilità di agire sul vostro telefono perfino scaricandone la batteria, c’è da domandarsi cosa la potente Intelligenza Artificiale su cui Meta sta lavorando possa fare alla vostra vita.

Per quanto poco reclamizzato, Facebook nel tempo ha eseguito ricerche molto avveniristiche, come quella per creare dispositivi in grado di leggere il pensiero degli utenti.

Come sa il nostro lettore, Renovatio 21 ha avuto la sua pagina Facebook disattivata, al pari dell’account personale degli amministratori, dei loro profili e di tutte le pagine collegate. Il tutto ci è stato restituito dopo un’ordinanza del giudice.

Iscriviti alla Newslettera di Renovatio 21

Immagine di Nokia621 via Wikimedia pubblicate su licenza Creative Commons Attribution-Share Alike 4.0 International

Intelligenza Artificiale

Olandese 62enne sposa chatbot

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Armi biologiche

I grandi gruppi IA sostengono le normative sul DNA per limitare il rischio di armi biologiche

I dirigenti delle principali aziende di Intelligenza Artificiale si sono uniti agli esperti di biotecnologie in un appello urgente per rendere obbligatori i controlli di sicurezza per l’acquisto di DNA sintetico. In una lettera pubblica indirizzata al Congresso degli Stati Uniti, i firmatari sostengono che i rapidi progressi nell’IA potrebbero aumentare il rischio di sviluppo di armi biologiche.

L’appello, pubblicato all’inizio di questa settimana, è stato firmato da Demis Hassabis di Google DeepMind, Sam Altman di OpenAI, Dario Amodei di Anthropic e Mustafa Suleyman ed Eric Horvitz di Microsoft AI. A loro si sono uniti decine di esperti provenienti dai settori delle biotecnologie, della sintesi del DNA e della sicurezza nazionale.

Il DNA sintetico si riferisce a materiale genetico prodotto artificialmente che può essere ordinato online e spedito come qualsiasi altro materiale da laboratorio. Sebbene la lettera sia indirizzata al Congresso, i firmatari hanno sottolineato che il problema è globale, poiché il DNA sintetico può essere acquistato e trasportato oltre confine.

«La possibilità di ordinare DNA sintetico online ha accelerato lo sviluppo dei vaccini, ha potenziato la ricerca di base e ha permesso a piccoli team di accedere a capacità che un tempo erano appannaggio esclusivo delle grandi istituzioni», si legge nella lettera.

Iscriviti alla Newslettera di Renovatio 21

Sebbene il DNA sintetico abbia una vasta gamma di usi legittimi, tra cui lo sviluppo di farmaci salvavita, la modifica genetica dei microrganismi e persino l’archiviazione di grandi quantità di dati digitali, comporta anche dei rischi, secondo l’appello. In teoria, soggetti malintenzionati potrebbero ordinare sequenze di DNA progettate per ricreare agenti patogeni pericolosi, avvertono i firmatari.

Sebbene alcune aziende effettuino già volontariamente controlli su clienti e ordini, non esiste alcun obbligo legale in tal senso. Gli autori della lettera hanno descritto questi controlli come «una delle misure di biosicurezza più conosciute e meno invasive attualmente disponibili».

I firmatari hanno inoltre richiesto l’obbligo di tenuta dei registri per facilitare il tracciamento delle attività sospette. Oltre a supportare le indagini, gli autori hanno sostenuto che la semplice consapevolezza della tracciabilità degli ordini potrebbe scoraggiare gli abusi.

Gli autori hanno affermato che la minaccia di fondo non è nuova, ma hanno sostenuto che il ritmo senza precedenti dello sviluppo dell’IA sta cambiando le carte in tavola. I sistemi di IA odierni, hanno osservato, sono già in grado di superare le prestazioni di virologi con dottorato di ricerca in quesiti che coinvolgono procedure di laboratorio altamente complesse.

Secondo quanto avvertito, con il miglioramento di questi sistemi, le barriere in termini di conoscenza e competenze che storicamente hanno limitato l’accesso alle armi biologiche potrebbero essere significativamente ridotte.

Iscriviti al canale Telegram ![]()

L’allarme per la connessione tra IA e armi biologiche non è cosa nuova.

Come riportato da Renovatio 21, un ricercatore esperto di sicurezza di Anthropic che aveva lavorato sul fronte delle armi biologiche si licenziò lasciando un monito preciso. «Il mondo è in pericolo. E non solo per via dell’Intelligenza Artificiale o delle armi biologiche, ma a causa di un insieme di crisi interconnesse che si stanno verificando proprio ora», ha scritto Mrinank Sharma rivolgendosi ai colleghi.

Il timore per le armi biologiche create dell’AI era presente anche in una lettera che 60 figure del movimento MAGA avevano indirizzato al presidente Trump chiedendo controlli sullo sviluppo dell’Intelligenza Artificiale. «I sistemi aeronautici sono sottoposti a una rigorosa certificazione. I sistemi di Intelligenza Artificiale più potenti, che ora possono, o presto potranno, contribuire alla progettazione di armi biologiche, all’infiltrazione in infrastrutture critiche o alla manipolazione dei mercati finanziari, dovrebbero essere trattati con la stessa serietà e attenzione» hanno scritto i firmatari, tra i quali spiccava il nome di Steve Bannon.

Iscriviti alla Newslettera di Renovatio 21

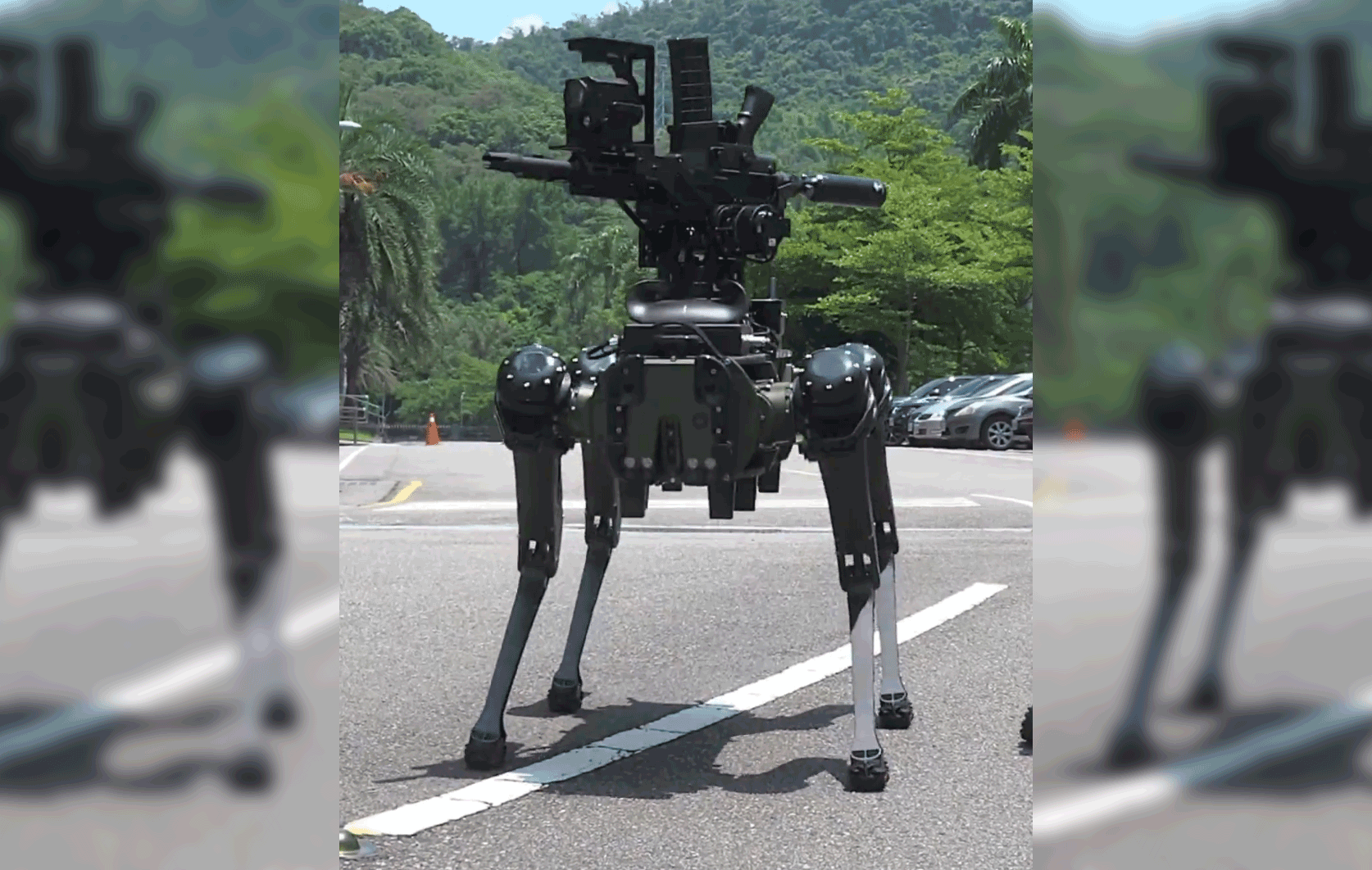

Intelligenza Artificiale

Taiwan presenta i suoi robocani armati

Rebels in Taiwan unveil armed robotic dogs pic.twitter.com/7h3n0VPO7b

— China pulse 🇨🇳 (@Eng_china5) June 2, 2026

Sostieni Renovatio 21

🤖🐶Who do you think will win in the fireworks showdown between Chinese drones and robotic dogs? #ChinaLife #robotic #dog #drones #fireworks #funny @QiushiJournal @RibiaoChen @SpoxCHNinUS @SLembassycn @Chinaembmanila pic.twitter.com/tNhpRRUvlI

— Hola Fujian (@HolaFujian) January 26, 2025

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Essere genitori2 settimane fa

Essere genitori2 settimane faI bambini che libereranno Faccetta nera

-

Spirito2 settimane fa

Spirito2 settimane faBreve commento di mons. Viganò sull’enciclica di Leone sull’IA

-

Spirito2 settimane fa

Spirito2 settimane faBoy scout rifiuta di inchinarsi ad Allah durante una visita in moschea

-

Stragi1 settimana fa

Stragi1 settimana faCani e droni killer negli ospedali, stupri sistemici, affamati usati come pratica di tiro: chirurgo racconta gli orrori di Gaza

-

Intelligenza Artificiale2 settimane fa

Intelligenza Artificiale2 settimane faL’enciclica sull’IA è stata scritta con l’IA?

-

Gender2 settimane fa

Gender2 settimane fa«L’omosessualità è un disturbo mentale»: psichiatra ad un congresso medico

-

Armi biologiche1 settimana fa

Armi biologiche1 settimana faDocumenti desecretati collegano l’epidemia di Lyme al programma statunitense di armi biologiche

-

Stato7 giorni fa

Stato7 giorni faQuando fuggono i cavalli della Repubblica