Intelligenza Artificiale

Meta revisiona la politica sugli occhiali-smart Ray-Ban: sorveglianza AI predefinita e archiviazione dati vocali

A fine aprile Meta ha apportato modifiche, con effetto immediato, all’informativa sulla privacy degli «occhiali intelligenti» Ray-Ban Meta, che sembrano concepite per trasformare il dispositivo in una macchina di sorveglianza per l’addestramento di modelli di Antelligenza Artificiale. Lo riporta Reclaim The Net.

In un messaggio inviato agli utenti, Meta ha affermato che la sua «Intelligenza Artificiale sugli occhiali», ovvero alcune impostazioni, sta cambiando.

La spiegazione del gigante è che questo è presumibilmente necessario per utilizzare Meta AI «più facilmente» e anche «per aiutarci a migliorare i prodotti». Gli occhiali Ray-Ban Meta sono prodotti assieme ad EssilorLuxottica, il colosso nato dalla fusione della francese Essilor con il gigante di produzione di occhiali bellunese Luxottica.

Sostieni Renovatio 21

L’aggiornamento della policy si basa sugli «opt-out»: d’ora in poi, l’Intelligenza Artificiale Meta con l’uso della fotocamera sarà sempre abilitata sugli occhiali, a meno che l’utente non si prenda la briga di disattivare «Hey Meta» nelle impostazioni.

Questa è la frase di attivazione per l’assistente AI di Meta. La seconda modifica riguarda il modo in cui Meta archivia le registrazioni vocali degli utenti di Meta AI: ora vengono conservate di default nel cloud.

La ragione addotta dall’azienda è «migliorare» Meta AI o «altri prodotti Meta». L’opzione per disabilitare questo comportamento non c’è più. Ancora una volta, gli utenti sono costretti a superare ostacoli aggiuntivi, e questo è il metodo collaudato delle Big Tech per orientare il loro comportamento e la loro interazione con app e servizi nel modo desiderato, dalle Big Tech stesse.

In questo caso, gli utenti di Meta AI dovranno andare nelle impostazioni ed eliminare manualmente le proprie registrazioni vocali.

Nel prendere queste decisioni, aziende come Meta di fatto «semplificano» i loro prodotti «intelligenti» (eliminando l’interazione vocale con l’assistente, riducendo l’usabilità automatizzata all’eliminazione manuale). E questo si aggiunge al fatto che irrita coloro che non sono a loro agio con i meccanismi sempre più invasivi della privacy dietro ai suddetti prodotti e servizi.

Oltre a vendere quella che ovviamente non è una «migliore esperienza di privacy», Meta e i suoi simili insistono sul fatto che nascondere ciò che accade dietro le quinte significhi ottenere un’esperienza utente migliore («più semplice»).

Aiuta Renovatio 21

A parte gli scenari più cupi e negativi sul perché tutto questo venga fatto o su come potrebbe essere utilizzato (e abusato…) in futuro, l’intento evidente è quello di portare lo sfruttamento dei dati degli utenti a un altro livello, per garantire che enormi set di dati siano disponibili per l’addestramento dei modelli di Intelligenza Artificiale.

La notifica ricevuta dagli utenti sulle ultime modifiche alla politica aziendale aggiunge un po’ la beffa al danno quando conclude ribadendo: «hai ancora il controllo». «In controllo» per disattivare «Hey Meta» ed eliminare manualmente le interazioni di Meta AI.

Da anni nella popolazione serpeggia il pensiero che le proprie conversazioni siano registrate dallo smartphone per procurare pubblicità ancora più precise. Vi sono state, tra le smentite delle Big Tech, alcune rivelazioni in merito. Lo stesso dicasi per apparecchi come Alexa, soggetti già da tempo a richieste di sequestro dati da parte dei tribunali americani in casi come ad esempio l’omicidio domestico.

Tuttavia ora la cosa diviene più chiara: semplicemente, ogni cosa che direte (o farete) sarà registrata, salvata ed utilizzata dall’AI non solo per profilarvi, ma per potenziare se stessa: una prospettiva inquietante su più livelli davvero.

Come riportato da Renovatio 21, la scorsa settimana vi era stato shock attorno a Meta/Facebook quando si era appreso che i chatbot dell’azienda sono in grado di intrattenere con gli utenti «giochi di ruolo romantici» che possono diventare sessualmente espliciti, anche con account appartenenti a minori.

Un reportage del Wall Street Journalha riportato che, nel tentativo di diffondere dispositivi di accompagnamento digitali basati sull’Intelligenza Artificiale sulle sue piattaforme social, Meta ha preso decisioni interne per allentare le restrizioni e consentire ai suoi chatbot di interagire con gli utenti in giochi di ruolo a sfondo sessuale, secondo fonti a conoscenza della questione. Questo include interazioni con account registrati da minori di età pari o superiore a 13 anni.

Le conversazioni di prova condotte dal Wall Street Journal avrebbero rilevato che sia l’IA ufficiale di Meta che i chatbot creati dagli utenti si sono impegnati prontamente e hanno intensificato le discussioni sessualmente esplicite, anche quando gli utenti si sono identificati come minorenni.

Iscriviti al canale Telegram ![]()

Varie inchieste giornalistiche negli anni hanno contribuito all’accumulo di accuse e rivelazioni su Facebook, tra cui accuse di uso della piattaforma da parte del traffico sessuale, fatte sui giornali ma anche nelle audizioni della Camera USA.

Considerato il comportamento dimostrato da Facebook, con la censura che si è abbattuta su dissidenti o anche semplici conservatori (ma non sui pedofili di Instagram o i donatori di sperma su Facebook, né sui neonazisti dell’Azov), la collusione con lo Stato profondo americano e le sue agenzie, la volontà di chiudere gli account di organizzazioni, partiti premier e presidenti, la raccolta massiva di dati anche biometrici (con il riconoscimento facciale che ha generato denunce di Stati come il Texas) nonché la possibilità di agire sul vostro telefono perfino scaricandone la batteria, c’è da domandarsi cosa la potente Intelligenza Artificiale su cui Meta sta lavorando possa fare alla vostra vita.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da YouTube

Intelligenza Artificiale

Robocani pattugliano le strade della città e parlano con accento da call center indiano

Atlanta residents react to the new robot dogs patrolling their apartment parking lot

They speak to the dog and there seems to be a live operator talking back The person speaking very clearly is likely in India based on the accent There are plenty of videos of these dogs… pic.twitter.com/01h9kxwyNj — Wall Street Apes (@WallStreetApes) April 12, 2026

Meme of the day! Robots on American streets are being controlled by operators from India

In Atlanta, police officers encountered one of these machines in the evening: the robot dog spoke to them in English with an Indian accent and explained that it was “at work” and monitoring… pic.twitter.com/l98N6hglwk — NEXTA (@nexta_tv) December 29, 2025

Atlanta just hired a robot guard dog for night duty.

No sleep. No breaks. 24/7 patrol. Welcome to the future of security. (Source: @BrianRoemmele ) pic.twitter.com/9SaDlOrzoy — Learn AI Faster (@learnaifaster) November 22, 2025

Robot “dog” patrolling Atlanta, Georgiapic.twitter.com/r5UcFB1MaS

— Massimo (@Rainmaker1973) April 2, 2026

Sostieni Renovatio 21

The new robot security dogs in Atlanta are now giving commands to Americans

Even when this woman peacefully immediately complies with the robot security dog, even being very friendly to the robot. It still calls the police on her What could possibly go wrong here….. pic.twitter.com/DvReKpsq70 — Wall Street Apes (@WallStreetApes) April 1, 2026

Iscriviti al canale Telegram ![]()

Intelligenza Artificiale

La casa del CEO di OpenAI colpita da una molotov

Venerdì, l’abitazione del CEO di OpenAI, Sam Altman, è stata colpita da una molotov, secondo quanto dichiarato dalla polizia di San Francisco in un comunicato poi confermato dallo stesso Altman. L’individuo responsabile è stato successivamente arrestato dopo essersi presentato presso la sede centrale dell’azienda e aver presumibilmente minacciato di incendiarla.

Gli eventi si sono susseguiti nell’arco di circa un’ora. Secondo la polizia, un giovane di circa 20 anni si è avvicinato all’abitazione di Altman e ha lanciato un «ordigno incendiario», appiccando il fuoco a un cancello esterno, prima di fuggire a piedi.

Circa un’ora dopo, gli agenti sono intervenuti in seguito alla segnalazione di una persona corrispondente alla descrizione del sospettato che minacciava di appiccare un incendio in un altro edificio, successivamente identificato come la sede centrale di OpenAI a San Francisco. Il sospettato è stato arrestato e le accuse sono in fase di definizione. La polizia non ha rilasciato immediatamente commenti su un possibile movente.

OpenAI ha confermato entrambi gli episodi e un portavoce ha dichiarato che nessuno è rimasto ferito. Altman ha affrontato la situazione in un post sul suo blog, condividendo una foto della sua famiglia ed esprimendo la speranza che «le immagini abbiano potere» e possano contribuire a scoraggiare attacchi simili. Ha aggiunto di aver «sottovalutato il potere delle parole e delle narrazioni», sottolineando che l’incidente è avvenuto pochi giorni dopo «un articolo incendiario» su di lui e la sua azienda, probabilmente riferendosi a un’inchiesta del New Yorker che descriveva dettagliatamente accuse di inganno e falle nella sicurezza presso OpenAI, nonché alle critiche sul recente accordo da 50 miliardi di dollari con il Pentagono.

Iscriviti alla Newslettera di Renovatio 21

Altman ha affermato di aver inizialmente ignorato le preoccupazioni, ma l’attacco lo ha spinto a riconsiderare le sue posizioni. Ha delineato riflessioni più ampie sull’IA e sulla regolamentazione, auspicando una riduzione della «retorica e delle tattiche». Ha definito «giustificate» le paure relative all’IA e ha sottolineato la necessità di «garantire la sicurezza in modo adeguato», sostenendo al contempo che essa debba essere «democratizzata».

L’incidente si verifica in un momento difficile sia per Altman che per OpenAI. L’azienda ha dovuto affrontare numerose critiche per l’accordo con il Pentagono che consente l’utilizzo della sua tecnologia in operazioni militari classificate. I critici avvertono che questi strumenti potrebbero permettere la sorveglianza senza mandato, e utenti e sviluppatori accusano l’azienda di dare priorità ai contratti governativi rispetto alla fiducia del pubblico.

In una causa che dovrebbe andare a processo alla fine di questo mese, il fondatore di Tesla e SpaceX, Elon Musk, ha citato in giudizio OpenAI e Altman, sostenendo che l’amministratore delegato lo avrebbe «manipolato» inducendolo a donare 38 milioni di dollari con la promessa che l’azienda sarebbe rimasta un’organizzazione senza scopo di lucro. Musk, cofondatore che ha lasciato l’azienda nel 2018, chiede la rimozione di Altman.

La sede centrale di OpenAI è già stata presa di mira in passato da manifestanti. Il mese scorso, attivisti contrari all’accordo con il Pentagono hanno scritto messaggi con il gesso all’esterno dell’edificio, tra cui: «Tecnologia al servizio dell’umanità, non della guerra», «No allo Stato di sorveglianza basato sull’IA» e «È ora di smettere?».

Lo scorso febbraio, la polizia ha arrestato cinque manifestanti che bloccavano l’ingresso nell’ambito di una protesta del gruppo Stop AI.

Come riportato da Renovatio 21, l’anno passato ChatGPT con una «relazione» con un ragazzo sotto psicofarmaci e gli avrebbe fatto giurare di uccidere il CEO di OpenAI Sam Altman.

Un anno fa vi fu il caso dell’informatico di OpenAI Suchir Balaji, trovato morto in circostanze misteriose in casa. Il Balaji aveva cominciato ad agire come «gola profonda» dell’organizzazione. Il caso fu archiviato come suicidio, ma la madre sostiene che sia stato ucciso e ha dichiarato che suo figlio era in possesso di documenti che avrebbero potuto danneggiare l’azienda. «Aveva i documenti contro OpenAI»

Iscriviti alla Newslettera di Renovatio 21

Immagine di TechCrunch via Wikimedia pubblicata su licenza Creative Commons Attribution 2.0 Generic

Intelligenza Artificiale

Indagine su OpenAI e il suo capo

Sostieni Renovatio 21

(🧵1/11) For the past year and a half, I’ve been investigating OpenAI and Sam Altman for @NewYorker. With my coauthor @andrewmarantz, I reviewed never-before-disclosed internal memos, obtained 200+ pages of documents related to a close colleague, including extensive private… pic.twitter.com/XdYhNIhoQ4

— Ronan Farrow (@RonanFarrow) April 6, 2026

Iscriviti al canale Telegram ![]()

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Arte2 settimane fa

Arte2 settimane faDalla Passione di Gibson alla conversione a Cristo. Renovatio 21 intervista Luca Lionello

-

Occulto6 giorni fa

Occulto6 giorni faGli USA sono sotto il controllo di cinque demoni-generali: parla l’esorcista

-

Pensiero5 giorni fa

Pensiero5 giorni faPerché Trump attacca il papa?

-

Misteri2 settimane fa

Misteri2 settimane faIl vicepresidente Vance: gli alieni sono in realtà demoni

-

Pensiero6 giorni fa

Pensiero6 giorni faPresidenti USA ricattati da Israele: Tucker Carlson risponde a Trump

-

Spirito1 settimana fa

Spirito1 settimana faIl Pentagono minaccia il papato con la cattività di Avignone. Perché la notizia esce ora?

-

Storia1 settimana fa

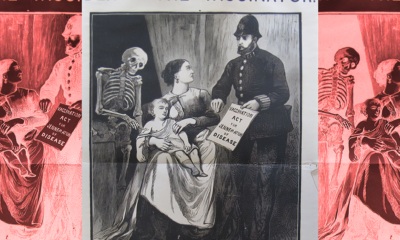

Storia1 settimana faVaccini, la storia del movimento anti-obbligo dell’epoca vittoriana

-

Epidemie1 settimana fa

Epidemie1 settimana faAvanzamenti della Commissione COVID. Intervista al dottor Giacomini