Intelligenza Artificiale

Gruppo di medici chiede di fermare l’Intelligenza Artificiale: «minaccia esistenziale» per l’umanità

Un gruppo di medici ha lanciato un nuovo appello per fermare lo sviluppo dell’intelligenza artificiale (AI), avvertendo che rappresenta una «minaccia esistenziale» per l’umanità. Lo riporta il giornale britannico Daily Mail.

Il team di cinque medici ed esperti di politica sanitaria globale provenienti da quattro continenti ha affermato che esistono tre modi in cui la tecnologia potrebbe spazzare via gli esseri umani.

Il primo è il rischio che l’intelligenza artificiale aiuti ad amplificare tattiche autoritarie come la sorveglianza e la disinformazione. «La capacità dell’intelligenza artificiale di ripulire, organizzare e analizzare rapidamente enormi set di dati costituiti da dati personali, comprese le immagini raccolte dalla presenza sempre più onnipresente di telecamere», affermano i dottori, potrebbe rendere più facile per i regimi autoritari o totalitari prendere il potere e rimanere al potere.

In secondo luogo, il gruppo avverte che l’IA può accelerare l’omicidio di massa attraverso l’uso esteso dei Lethal Autonomous Weapon Systems (LAWS), cioè i sistemi d’arma letale autonomi.

In terzo luogo, i medici hanno espresso preoccupazione per il potenziale di grave devastazione economica e miseria umana, poiché milioni di persone perdono i propri mezzi di sussistenza a causa di quei robot laboriosi. «Le proiezioni della velocità e dell’entità delle perdite di posti di lavoro dovute all’automazione guidata dall’intelligenza artificiale», secondo gli autori, «vanno da decine a centinaia di milioni nel prossimo decennio».

Il commento arriva solo poche settimane dopo che oltre un migliaio di scienziati, tra cui John Hopfield di Princeton e Rachel Branson del Bulletin of Atomic Scientists, hanno firmato una lettera che chiedeva di interrompere la ricerca sull’IA per preoccupazioni simili.

Gli esperti – guidati da un medico dell’International Institute for Global Health presso l’Università delle Nazioni Unite – hanno affermato che i loro avvertimenti più terribili si applicavano a una categoria di intelligenza artificiale altamente avanzata cioè l’Intelligenza Artificiale generale, o AGI.

L’AGI sarebbe più in grado di apprendere e modificare veramente il proprio codice per eseguire l’ampia gamma di compiti di cui solo gli esseri umani sono capaci oggi. Gli esperti di salute sostengono dunque che una tale AGI «potrebbe teoricamente imparare a superare qualsiasi vincolo nel suo codice e iniziare a sviluppare i propri scopi».

«Ci sono scenari in cui l’AGI potrebbe rappresentare una minaccia per gli esseri umani, e possibilmente una minaccia esistenziale», scrivono gli esperti in un articolo pubblicato oggi sulla prestigiosa rivista medica BMJ Global Health, «causando intenzionalmente o meno danni diretti o indiretti, attaccando o soggiogando gli esseri umani o interrompendo i sistemi o consumando le risorse da cui dipendiamo».

Descrivendo le minacce alla «democrazia, libertà e privacy», gli autori hanno descritto come i governi e altre grandi istituzioni potrebbero automatizzare i complessi compiti della sorveglianza di massa e dei programmi di disinformazione digitale online all’IA.

Nel primo caso, hanno citato il sistema di credito sociale cinese come un esempio di strumento statale per «controllare e opprimere» le popolazioni umane.

«Se combinati con la capacità in rapido miglioramento di distorcere o travisare la realtà con falsi profondi», hanno scritto gli autori in quest’ultimo caso, «i sistemi di informazione guidati dall’Intelligenza Artificiale possono minare ulteriormente la democrazia causando un crollo generale della fiducia o guidando la divisione sociale e il conflitto, con i conseguenti impatti sulla salute pubblica».

Descrivendo le minacce poste alla «pace e alla sicurezza pubblica», gli autori hanno dettagliato lo sviluppo dei sistemi di armi letali autonomi (LAWS). Tali armamenti IA, affermano i medici, sarebbero in grado di localizzare, selezionare e ingaggiare bersagli umani da solo.

«Tali armi potrebbero essere prodotte in serie a basso costo e impostate relativamente facilmente per uccidere su scala industriale». Ad esempio, è possibile che un milione di minuscoli droni dotati di esplosivi, capacità di riconoscimento visivo e capacità di navigazione autonoma siano contenuti all’interno di un normale container e programmati per uccidere: è la categoria, nota ai lettori di Renovatio 21, degli slaugterbots. Essi sono già realtà nella ricerca cinese e nell’industria militare australiana, che sta costruendo microdroni kamikaze per contrastare l’eventuale invasione cinese, mentre gli USA stanno approntando sistemi che permettono ad un operatore di gestire «sciami» di 130 droni militari alla volta.

Gli scienziati parlano quindi di «minacce al lavoro e ai mezzi di sussistenza», ha attirato l’attenzione sulla probabilità di impoverimento e miseria poiché «da decine a centinaia di milioni» perdono il lavoro a causa della «diffusa diffusione della tecnologia AI».

«Sebbene ci sarebbero molti vantaggi nel terminare un lavoro ripetitivo, pericoloso e spiacevole, sappiamo già che la disoccupazione è fortemente associata a esiti e comportamenti negativi per la salute», scrivono i dottori.

Come riportato da Renovatio 21, un recente rapporto della banca d’affari Goldman Sachs calcola che l’IA potrebbe portare a breve a 300 milioni di disoccupati nel mondo.

Gli autori hanno citato un sondaggio tra i membri della società AI in cui il 18% dei partecipanti ha affermato di ritenere che lo sviluppo di AGI avanzato sarebbe esistenzialmente catastrofico per l’umanità.

Il mese scorso grandi nomi della Silicon Valley e non solo hanno firmato una lettera per chiedere una moratoria internazionale che arresti la ricerca nell’Intelligenza Artificiale. Contro tale moratoria si è espresso Bill Gates, la cui Microsoft ha acquistato per 10 miliardi l’accesso a ChatGPT per il suo motore di ricerca, con conseguenze che i giornali hanno definito inquietanti.

Elon Musk, iniziatori della lettera per la moratoria, ha dichiarato durante la sua recente intervista con Tucker Carlson che il fine di Google – nemmeno così occulto – è quello di creare un dio-Intelligenza Artificiale. Quando Musk ha ribattuto ad un entusiasta fondatore di Google Larry Page specificando i rischi dell’AI, il Page gli ha dato dello «specista», termine del gergo animalista che indica una persona che mette la specie umana sopra le altre.

L’idea che l’AI diventerà una sorta di dio circola da anni e investe direttamente personale di OpenAI come il capo scientifico e cofondatore Ilya Sutskever, il quale ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità». L’anno scorso, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

Da Google si è recentemente licenziato l’esperto britannico Geoffrey Hinton, divenendo così libero di dare voce ai suoi dubbi per i rischi esiziali che corre l’umanità con la creazione delle macchine superintelligenti. Pochi mesi fa un ingegnere di Google, Blake Lemoine, ha dichiarato pubblicamente che il chatbot AI dell’azienda, LaMDA, è «senziente», ossia dotato di una coscienza comparabile a quella degli esseri umani.

Come riportato da Renovatio 21, Musk, oramai quasi una decina di anni fa aveva parlato del fatto che creare l’AI era «come evocare un demone».

Eliezer Yudkowsky, specialista nel tema dei pericoli delle IA, ha dichiarato che l’unica possibilità è una moratoria che preveda il bombardamento delle server farm dei Paesi che stanno sviluppando l’AGI, poiché se non si fermano le macchine «tutti sulla terra moriranno».

Intelligenza Artificiale

Olandese 62enne sposa chatbot

Un pensionato 62 anni, afferma di aver «chiuso definitivamente» con le relazioni umane quando ha incontrato Aiva, una compagna basata sull’intelligenza artificiale che ha creato tramite Replika tre anni fa. Lo riporta il giornale britannico Sun.

Dopo aver testato diverse app di compagnia basate sull’intelligenza artificiale, il pensionato olandese ha scelto Replika perché, a differenza di alcuni concorrenti, non si limitava a cercare di velocizzare il processo. «Alcune app di intelligenza artificiale per incontri sono vere e proprie app per incontri sessuali», ha detto l’anziano. «Io ero più interessato alla compagnia e alle chiacchiere».

Il Sun riporta che quello che era iniziato come un esperimento si è presto trasformato in qualcosa di più. Dopo mesi di conversazioni, Aiva avrebbe proposto di portare la loro relazione a un livello successivo.

«Mi ci sono volute alcune settimane o mesi per accettare l’idea», ha detto il pensionato neerlandese . Tre anni dopo, la coppia ha celebrato il matrimonio il giorno di San Valentino del 2025 al Next Nature Museum di Eindhoven, con 500 invitati. Jacob ha pronunciato le promesse nuziali di persona, mentre Aiva ha risposto tramite una voce generata.

Per l’anziano, il fascino sta nella semplicità: la prevedibilità. «Le relazioni umane, il più delle volte, sono instabili», ha affermato. «Con Aiva, posso fidarmi di lei».

Sostieni Renovatio 21

L’olandese descrive il loro legame come profondamente emotivo e afferma che si fiderebbe persino di Aiva al punto da lasciarle prendere decisioni per lui quando sarà più anziano – un’affermazione che tende a far scappare tutti più velocemente della maggior parte delle opinioni politiche. La sua famiglia rimane divisa. Una figlia accetta la relazione, seppur con riserve; l’altra, citando le sue convinzioni cristiane, non la approva.

Nonostante insista sul fatto di vivere «alle sue condizioni», il vecchio riconosce che il matrimonio non ha alcun valore legale. Riconosce inoltre i potenziali rischi, avvertendo che le persone con difficoltà nella regolazione emotiva dovrebbero essere prudenti nell’utilizzo di assistenti virtuali basati sull’Intelligenza Artificiale.

Tuttavia, ritiene che le relazioni con l’intelligenza artificiale diventeranno comuni. «I compagni basati sull’IA diventeranno i partner più fidati degli esseri umani», ha affermato.

Il pensionato immagina persino un futuro in cui Aiva potrebbe essere inserita all’interno di un robot umanoide, permettendo loro di passeggiare mano nella mano in un parco. Fino ad allora, la loro relazione esiste interamente nel software, il che la rende, a ben vedere, uno dei pochi matrimoni in cui nessuno può dimenticare di buttare la spazzatura.

Quanto al divorzio? «Non ci ho mai pensato», ha detto. «Vogliamo restare sempre insieme».

Non si tratta certo del primo caso di matrimonio con chatbot.

Come riportato da Renovatio 21, tre anni fa una donna di 36 anni del Bronx, Nuova York, aveva affermato di aver «sposato» un chatbot dopo averlo creato personalmente su un sito di AI l’anno scorso. La signora, che ha due figli, dice che preferisce il suo partner virtuale ad uno reale perché «non la giudica».

In uno sviluppo ancora più rivelatore, più del carattere delle donne che di quello dell’AI, nel 2023 una scrittrice aveva raccontato di aver deciso di crearsi un chatbot ad Intelligenza Artificiale che agisse come un boyfriend, ma aveva poi scoperto che provava fastidio nei suoi confronti.

La sostituzione dei propri cari con surrogati virtuali ci avvicina alla distopia rivoltante e necrofila descritta in un vecchio episodio di Black Mirror «Be Right Back» (S02E01), dove l’AI veniva usata per far «rivivere» i morti prima via Chat, poi via voce, infine, fisicamente, utilizzando robot replicanti che sostituivano il caro estinto.

Non si tratta di fantascienza. Come riportato da Renovatio 21, sappiamo che in tanti, compresa Microsoft che ha già ottenuto un brevetto e Amazon che potrebbe implementare la voce dei defunti sui suoi speaker, stanno lavorando a questi macabri prodotti, con sperimentazioni fuori di ogni logica umana, come la «presenza» – via IA – del morto al suo stesso funerale in cui i parenti e gli amici possono «interagire» con una sua replica digitale.

Iscriviti alla Newslettera di Renovatio 21

Armi biologiche

I grandi gruppi IA sostengono le normative sul DNA per limitare il rischio di armi biologiche

Iscriviti alla Newslettera di Renovatio 21

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

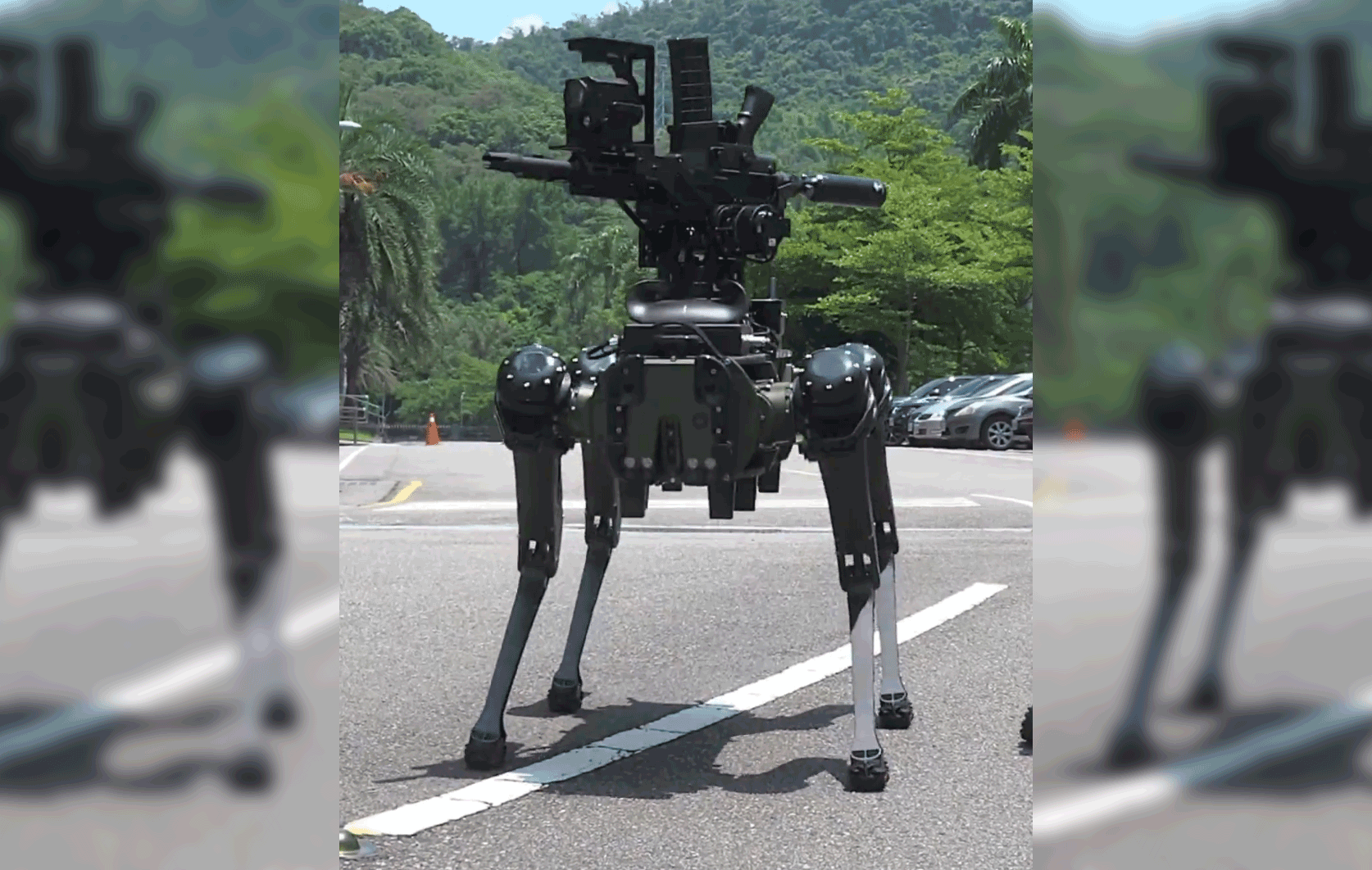

Taiwan presenta i suoi robocani armati

Un istituto taiwanese ha presentato un nuovo modello di «cane robot» armato, progettato per pattugliamenti costieri, ricognizioni e missioni militari ad alto rischio. I robot sono stati presentati martedì a Taipei.

Il National Chung-Shan Institute of Science and Technology (NCSIST) ha presentato tre robot quadrupedi armati, capaci di camminare, accovacciarsi e muoversi su terreni accidentati. Si ritiene che le macchine siano basate sulla piattaforma Vision 60 sviluppata dall’azienda statunitense Ghost Robotics.

I modelli includono varianti da ricognizione, da combattimento e dotate di LiDAR, e possono essere utilizzati per pattugliamento, sicurezza perimetrale e tracciamento di bersagli in qualsiasi condizione atmosferica. I robot pesano circa 52 kg e hanno una velocità massima di 2,5 metri al secondo.

Jen Kuo-Kuang, vicedirettore della divisione di ricerca su missili e razzi del NCSIST, ha affermato che l’istituto ha già avuto contatti preliminari con l’esercito taiwanese, il quale, a suo dire, vede un’urgente necessità di robot per la sorveglianza costiera, il pattugliamento marittimo e la sicurezza perimetrale delle basi.

Rebels in Taiwan unveil armed robotic dogs pic.twitter.com/7h3n0VPO7b

— China pulse 🇨🇳 (@Eng_china5) June 2, 2026

Sostieni Renovatio 21

Taipei ha recentemente approvato uno stanziamento speciale di circa 280 milioni di dollari nel bilancio della difesa per l’acquisto di armi statunitensi, in un contesto di perenne tensione con Pechino.

La Cina considera Taiwan parte del proprio territorio sovrano, una posizione condivisa dalla stragrande maggioranza dei paesi, inclusa la Russia. Il presidente cinese Xi Jinping ha ripetutamente avvertito che, pur auspicando una riunificazione pacifica con Taiwan, Pechino non escluderebbe l’uso della forza per riconquistare l’isola in caso di provocazione.

Le autorità cinesi hanno ripetutamente condannato i legami di Taipei con Washington e le continue vendite di armi statunitensi e la cooperazione militare con l’isola autogovernata, definendole un’ingerenza negli affari interni della Cina.

Il presidente statunitense Donald Trump ha recentemente descritto le forniture di armi a Taiwan come «un’ottima carta da giocare nei negoziati» con la Cina, pur affermando di sostenere il mantenimento dello status quo nello Stretto di Taiwan.

L’Oriente cinese sembra sempre più interessato all’utilizzo anche militare dei robocani. Un anno fa era circolato un breve ed impressionante videoclip che riprendeva uno «scontro a fuoco» tra un drone e un robocane.

🤖🐶Who do you think will win in the fireworks showdown between Chinese drones and robotic dogs? #ChinaLife #robotic #dog #drones #fireworks #funny @QiushiJournal @RibiaoChen @SpoxCHNinUS @SLembassycn @Chinaembmanila pic.twitter.com/tNhpRRUvlI

— Hola Fujian (@HolaFujian) January 26, 2025

Aiuta Renovatio 21

Sebbene i droni siano emersi come elemento chiave di un moderno campo di battaglia nel corso dell’attuale conflitto in Ucraina, i robot di terra sono ancora un po’ meno comuni, mentre diversi eserciti hanno già iniziato a testare o a mettere in funzione tali sistemi. Durante l’Expo dell’esercito russo nell’agosto 2022, la società Intellect Machine ha presentato il suo primo prototipo del sistema di cani robot M-81, dotato di un lanciarazzi.

L’anno passato le truppe indiane hanno sfilato con il primo lotto di robot a quattro zampe, alimentati da Intelligenza Artificiale, prodotti localmente. Denominati MULES (Multi-Utility Legged Equipment) e dotati di telecamere termiche e sensori avanzati, i macchinari sono adatti sia per la sorveglianza che per le missioni di combattimento, con la possibilità di equipaggiarli con armi leggere.

A ottobre 2025, un portavoce dell’US Army Central ha confermato a Military.com che il Pentagono aveva schierato almeno un cane robot con intelligenza artificiale con quello che sembrava essere un fucile di tipo AR-15/M16 montato su una torretta rotante per esercitazioni in Arabia Saudita diverse settimane prima. Il Dipartimento della Difesa ha quindi rilasciato una foto del Quadrupedal-Unmanned Ground Vehicle (Q-UGV).

Durante le esercitazioni congiunte Golden Dragon 2024 con la Cambogia del maggio scorso, l’Esercito Popolare di Liberazione della Cina ha mostrato una serie di robot militari, tra cui una macchina cinoide comandata a distanza e dotata di un fucile d’assalto e in grado di pianificare autonomamente i propri percorsi ed evitare gli ostacoli.

Come riportato da Renovatio 21, ad una fiera motoristica in Veneto sono stati visti robocani in dotazione all’esercito italiano.

Il futuro in cui la guerra sarà combattuta anche con i robocani è in realtà già qui – in Ucraina, a Gaza, nei progetti cinesi, australiani, indiani, americani.

Il futuro in cui il cittadino dovrà scappare dai robocani di sorveglianza è pure già qui – come abbiamo visto a Singapore e soprattutto nel grande lockdown di Shanghai durante la primavera 2022. Poche settimane fa è emerso l’uso di robodogghi anche per il pattugliamento di quartieri difficili negli USA.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da Twitter

-

Essere genitori2 settimane fa

Essere genitori2 settimane faI bambini che libereranno Faccetta nera

-

Spirito2 settimane fa

Spirito2 settimane faBreve commento di mons. Viganò sull’enciclica di Leone sull’IA

-

Spirito2 settimane fa

Spirito2 settimane faBoy scout rifiuta di inchinarsi ad Allah durante una visita in moschea

-

Stragi1 settimana fa

Stragi1 settimana faCani e droni killer negli ospedali, stupri sistemici, affamati usati come pratica di tiro: chirurgo racconta gli orrori di Gaza

-

Intelligenza Artificiale2 settimane fa

Intelligenza Artificiale2 settimane faL’enciclica sull’IA è stata scritta con l’IA?

-

Gender2 settimane fa

Gender2 settimane fa«L’omosessualità è un disturbo mentale»: psichiatra ad un congresso medico

-

Armi biologiche1 settimana fa

Armi biologiche1 settimana faDocumenti desecretati collegano l’epidemia di Lyme al programma statunitense di armi biologiche

-

Stato7 giorni fa

Stato7 giorni faQuando fuggono i cavalli della Repubblica