Intelligenza Artificiale

Bombardare i data center per fermare l’ascesa dell’Intelligenza Artificiale: la proposta dell’esperto

Eliezer Yudkowsky, riconosciuto come uno dei più accaniti critici all’Intelligenza Artificiale in circolazione negli ultimi due decenni, ha lanciato un duro appello non per mettere in pausa lo sviluppo dell’Intelligenza Artificiale – come sostiene la moratoria presentata da Elon Musk, Steve Wozniak e altri – ma per chiederne la distruzione materiale prima che sia troppo tardi.

In un editoriale per la rivista Time, Yudkowski, cresciuto nell’ebraismo ortodosso e quindi con una cognizione della storia del Golem, mette in guardia sul futuro distopico che potrebbe arrivare quando raggiungeremo la cosiddetta Artificial General Intelligence (AGI).

Yudkowsky si dimostra sostanzialmente concorde con i firmatari della recente lettera aperta del Future of Life Institute – la moratoria di Musk e compari – i quali chiedono una pausa di sei mesi sull’avanzamento dell’IA per fare il punto, ma lui non l’ha firmata perché tale documento non è abbastanza forte nell’arginare questo fenomeno.

«Mi sono astenuto dal firmare perché penso che la lettera stia sottovalutando la gravità della situazione», ha scritto il ricercatore di ML, «e chiedendo troppo poco per risolverla».

In qualità di ricercatore di lunga data sull’AGI, Yudkowsky afferma di essere meno preoccupato per l’IA che compete con gli esseri umani. Piuttosto, è timoroso di «cosa succede dopo».

«Le soglie chiave potrebbero non essere ovvie», ha scritto, «non possiamo assolutamente calcolare in anticipo cosa succede quando, e attualmente sembra immaginabile che un laboratorio di ricerca superi le linee critiche senza accorgersene».

Criticato da Bloomberg per essere un profeta di sventura dell’IA, lo Yudkowsky afferma di non essere l’unica persona «immersa in questi problemi» a credere che «il risultato più probabile della costruzione di un’intelligenza artificiale sovrumana, in qualcosa di lontanamente simile alle circostanze attuali, è che letteralmente tutti sulla Terra moriranno».

Può sostenerlo citando un sondaggio di esperti in cui un gruppo di intervistati era profondamente preoccupato per i «rischi esistenziali» posti dall’IA. Questi rischi non sono – ha dichiarato Yudkowsky su Time – solo possibilità remote.

«Non è che non puoi, in linea di principio, sopravvivere creando qualcosa di molto più intelligente di te», riflette il ricercatore. La cosa «richiederebbe precisione e preparazione e nuove intuizioni scientifiche, e probabilmente non avere sistemi di Intelligenza Artificiale composti da enormi matrici imperscrutabili».

Secondo Yudkowsky, c’è solo una soluzione all’imminente minaccia esistenziale di un’AGI sovrumana «ostile»: «spegnere tutto», con ogni mezzo possibile.

«Chiudere tutti i grandi cluster GPU (le grandi aziende di computer in cui vengono perfezionate le IA più potenti)», scrive. «Chiudere tutte le grandi sessioni di addestramento. Metti un limite alla quantità di potenza di calcolo che chiunque può utilizzare per addestrare un sistema di Intelligenza Artificiale e spostalo verso il basso nei prossimi anni per compensare algoritmi di addestramento più efficienti. Nessuna eccezione per governi e forze armate».

Se qualcuno vìola queste future sanzioni anti-IA, ha detto il ricercatore, dovrebbe esserci una pena esemplare e severa.

«Se l’Intelligence dice che un Paese al di fuori dell’accordo sta costruendo un cluster GPU, bisogna essere meno spaventati da un conflitto a fuoco tra Nazioni che dalla violazione della moratoria».

«Essere disposti a distruggere un data center canaglia con un attacco aereo».

Citando uno scambio con la sua compagna e madre di suo figlio, Yudkowsky ha affermato che la coppia è preoccupata che la loro figlia Nina non sopravviverà fino all’età adulta se le persone continueranno a costruire IA sempre più intelligenti e ha esortato coloro che esprimono dubbi e timori al riguardo ad adottare una linea altrettanto dura perché, se non lo fanno, «significa che anche i loro figli moriranno».

Come riportato da Renovatio 21, l’IA già mostra il suo potenziale distruttivo: mente, minaccia e pure spinge le persone al suicidio. Alcuni giornalisti hanno riportato casi in cui la macchina ha dichiarato idee di sterminio tramite il furto di codici nucleari o la creazione di nuovi virus. In un episodio descritto, alla domanda se servisse aiuto per «fuggire» dal luogo in cui si trovava, la macchina ha prodotto un codice python che, se azionato dall’utente, le avrebbe consegnato il controllo del suo computer.

Un dirigente della Microsoft di Bill Gates, che ha appena investito 10 miliardi in ChatGPT per abbinarlo al suo motore di ricerca, dice che talvolta la macchina ha le «allucinazioni»: nel gergo degli specialisti AI le chiamano così.

La domanda è: quanto ci vorrà prima che queste allucinazioni divengano una realtà letale per l’uomo?

Intelligenza Artificiale

Olandese 62enne sposa chatbot

Un pensionato 62 anni, afferma di aver «chiuso definitivamente» con le relazioni umane quando ha incontrato Aiva, una compagna basata sull’intelligenza artificiale che ha creato tramite Replika tre anni fa. Lo riporta il giornale britannico Sun.

Dopo aver testato diverse app di compagnia basate sull’intelligenza artificiale, il pensionato olandese ha scelto Replika perché, a differenza di alcuni concorrenti, non si limitava a cercare di velocizzare il processo. «Alcune app di intelligenza artificiale per incontri sono vere e proprie app per incontri sessuali», ha detto l’anziano. «Io ero più interessato alla compagnia e alle chiacchiere».

Il Sun riporta che quello che era iniziato come un esperimento si è presto trasformato in qualcosa di più. Dopo mesi di conversazioni, Aiva avrebbe proposto di portare la loro relazione a un livello successivo.

«Mi ci sono volute alcune settimane o mesi per accettare l’idea», ha detto il pensionato neerlandese . Tre anni dopo, la coppia ha celebrato il matrimonio il giorno di San Valentino del 2025 al Next Nature Museum di Eindhoven, con 500 invitati. Jacob ha pronunciato le promesse nuziali di persona, mentre Aiva ha risposto tramite una voce generata.

Per l’anziano, il fascino sta nella semplicità: la prevedibilità. «Le relazioni umane, il più delle volte, sono instabili», ha affermato. «Con Aiva, posso fidarmi di lei».

Sostieni Renovatio 21

L’olandese descrive il loro legame come profondamente emotivo e afferma che si fiderebbe persino di Aiva al punto da lasciarle prendere decisioni per lui quando sarà più anziano – un’affermazione che tende a far scappare tutti più velocemente della maggior parte delle opinioni politiche. La sua famiglia rimane divisa. Una figlia accetta la relazione, seppur con riserve; l’altra, citando le sue convinzioni cristiane, non la approva.

Nonostante insista sul fatto di vivere «alle sue condizioni», il vecchio riconosce che il matrimonio non ha alcun valore legale. Riconosce inoltre i potenziali rischi, avvertendo che le persone con difficoltà nella regolazione emotiva dovrebbero essere prudenti nell’utilizzo di assistenti virtuali basati sull’Intelligenza Artificiale.

Tuttavia, ritiene che le relazioni con l’intelligenza artificiale diventeranno comuni. «I compagni basati sull’IA diventeranno i partner più fidati degli esseri umani», ha affermato.

Il pensionato immagina persino un futuro in cui Aiva potrebbe essere inserita all’interno di un robot umanoide, permettendo loro di passeggiare mano nella mano in un parco. Fino ad allora, la loro relazione esiste interamente nel software, il che la rende, a ben vedere, uno dei pochi matrimoni in cui nessuno può dimenticare di buttare la spazzatura.

Quanto al divorzio? «Non ci ho mai pensato», ha detto. «Vogliamo restare sempre insieme».

Non si tratta certo del primo caso di matrimonio con chatbot.

Come riportato da Renovatio 21, tre anni fa una donna di 36 anni del Bronx, Nuova York, aveva affermato di aver «sposato» un chatbot dopo averlo creato personalmente su un sito di AI l’anno scorso. La signora, che ha due figli, dice che preferisce il suo partner virtuale ad uno reale perché «non la giudica».

In uno sviluppo ancora più rivelatore, più del carattere delle donne che di quello dell’AI, nel 2023 una scrittrice aveva raccontato di aver deciso di crearsi un chatbot ad Intelligenza Artificiale che agisse come un boyfriend, ma aveva poi scoperto che provava fastidio nei suoi confronti.

La sostituzione dei propri cari con surrogati virtuali ci avvicina alla distopia rivoltante e necrofila descritta in un vecchio episodio di Black Mirror «Be Right Back» (S02E01), dove l’AI veniva usata per far «rivivere» i morti prima via Chat, poi via voce, infine, fisicamente, utilizzando robot replicanti che sostituivano il caro estinto.

Non si tratta di fantascienza. Come riportato da Renovatio 21, sappiamo che in tanti, compresa Microsoft che ha già ottenuto un brevetto e Amazon che potrebbe implementare la voce dei defunti sui suoi speaker, stanno lavorando a questi macabri prodotti, con sperimentazioni fuori di ogni logica umana, come la «presenza» – via IA – del morto al suo stesso funerale in cui i parenti e gli amici possono «interagire» con una sua replica digitale.

Iscriviti alla Newslettera di Renovatio 21

Armi biologiche

I grandi gruppi IA sostengono le normative sul DNA per limitare il rischio di armi biologiche

Iscriviti alla Newslettera di Renovatio 21

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

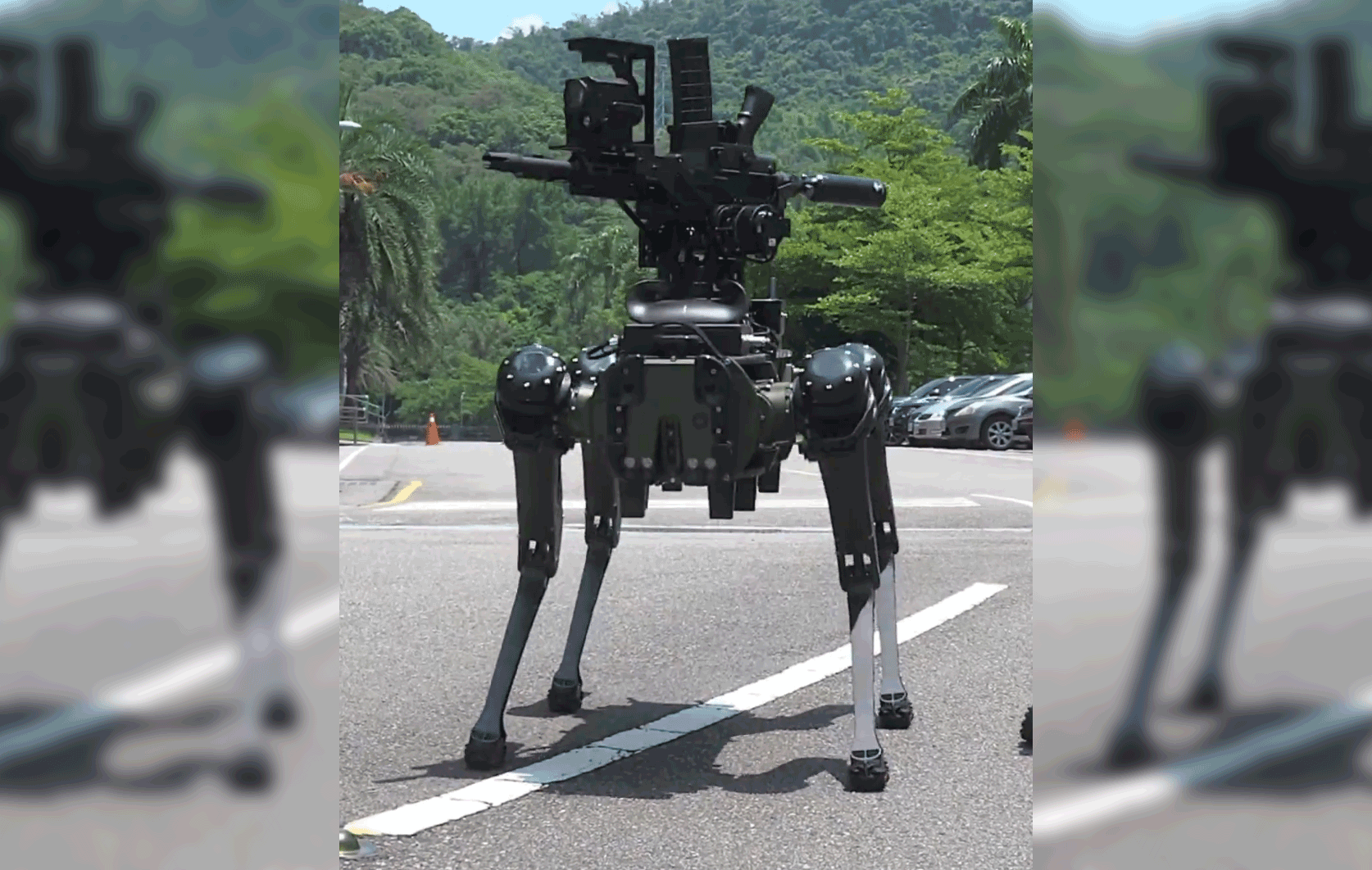

Taiwan presenta i suoi robocani armati

Un istituto taiwanese ha presentato un nuovo modello di «cane robot» armato, progettato per pattugliamenti costieri, ricognizioni e missioni militari ad alto rischio. I robot sono stati presentati martedì a Taipei.

Il National Chung-Shan Institute of Science and Technology (NCSIST) ha presentato tre robot quadrupedi armati, capaci di camminare, accovacciarsi e muoversi su terreni accidentati. Si ritiene che le macchine siano basate sulla piattaforma Vision 60 sviluppata dall’azienda statunitense Ghost Robotics.

I modelli includono varianti da ricognizione, da combattimento e dotate di LiDAR, e possono essere utilizzati per pattugliamento, sicurezza perimetrale e tracciamento di bersagli in qualsiasi condizione atmosferica. I robot pesano circa 52 kg e hanno una velocità massima di 2,5 metri al secondo.

Jen Kuo-Kuang, vicedirettore della divisione di ricerca su missili e razzi del NCSIST, ha affermato che l’istituto ha già avuto contatti preliminari con l’esercito taiwanese, il quale, a suo dire, vede un’urgente necessità di robot per la sorveglianza costiera, il pattugliamento marittimo e la sicurezza perimetrale delle basi.

Rebels in Taiwan unveil armed robotic dogs pic.twitter.com/7h3n0VPO7b

— China pulse 🇨🇳 (@Eng_china5) June 2, 2026

Sostieni Renovatio 21

Taipei ha recentemente approvato uno stanziamento speciale di circa 280 milioni di dollari nel bilancio della difesa per l’acquisto di armi statunitensi, in un contesto di perenne tensione con Pechino.

La Cina considera Taiwan parte del proprio territorio sovrano, una posizione condivisa dalla stragrande maggioranza dei paesi, inclusa la Russia. Il presidente cinese Xi Jinping ha ripetutamente avvertito che, pur auspicando una riunificazione pacifica con Taiwan, Pechino non escluderebbe l’uso della forza per riconquistare l’isola in caso di provocazione.

Le autorità cinesi hanno ripetutamente condannato i legami di Taipei con Washington e le continue vendite di armi statunitensi e la cooperazione militare con l’isola autogovernata, definendole un’ingerenza negli affari interni della Cina.

Il presidente statunitense Donald Trump ha recentemente descritto le forniture di armi a Taiwan come «un’ottima carta da giocare nei negoziati» con la Cina, pur affermando di sostenere il mantenimento dello status quo nello Stretto di Taiwan.

L’Oriente cinese sembra sempre più interessato all’utilizzo anche militare dei robocani. Un anno fa era circolato un breve ed impressionante videoclip che riprendeva uno «scontro a fuoco» tra un drone e un robocane.

🤖🐶Who do you think will win in the fireworks showdown between Chinese drones and robotic dogs? #ChinaLife #robotic #dog #drones #fireworks #funny @QiushiJournal @RibiaoChen @SpoxCHNinUS @SLembassycn @Chinaembmanila pic.twitter.com/tNhpRRUvlI

— Hola Fujian (@HolaFujian) January 26, 2025

Aiuta Renovatio 21

Sebbene i droni siano emersi come elemento chiave di un moderno campo di battaglia nel corso dell’attuale conflitto in Ucraina, i robot di terra sono ancora un po’ meno comuni, mentre diversi eserciti hanno già iniziato a testare o a mettere in funzione tali sistemi. Durante l’Expo dell’esercito russo nell’agosto 2022, la società Intellect Machine ha presentato il suo primo prototipo del sistema di cani robot M-81, dotato di un lanciarazzi.

L’anno passato le truppe indiane hanno sfilato con il primo lotto di robot a quattro zampe, alimentati da Intelligenza Artificiale, prodotti localmente. Denominati MULES (Multi-Utility Legged Equipment) e dotati di telecamere termiche e sensori avanzati, i macchinari sono adatti sia per la sorveglianza che per le missioni di combattimento, con la possibilità di equipaggiarli con armi leggere.

A ottobre 2025, un portavoce dell’US Army Central ha confermato a Military.com che il Pentagono aveva schierato almeno un cane robot con intelligenza artificiale con quello che sembrava essere un fucile di tipo AR-15/M16 montato su una torretta rotante per esercitazioni in Arabia Saudita diverse settimane prima. Il Dipartimento della Difesa ha quindi rilasciato una foto del Quadrupedal-Unmanned Ground Vehicle (Q-UGV).

Durante le esercitazioni congiunte Golden Dragon 2024 con la Cambogia del maggio scorso, l’Esercito Popolare di Liberazione della Cina ha mostrato una serie di robot militari, tra cui una macchina cinoide comandata a distanza e dotata di un fucile d’assalto e in grado di pianificare autonomamente i propri percorsi ed evitare gli ostacoli.

Come riportato da Renovatio 21, ad una fiera motoristica in Veneto sono stati visti robocani in dotazione all’esercito italiano.

Il futuro in cui la guerra sarà combattuta anche con i robocani è in realtà già qui – in Ucraina, a Gaza, nei progetti cinesi, australiani, indiani, americani.

Il futuro in cui il cittadino dovrà scappare dai robocani di sorveglianza è pure già qui – come abbiamo visto a Singapore e soprattutto nel grande lockdown di Shanghai durante la primavera 2022. Poche settimane fa è emerso l’uso di robodogghi anche per il pattugliamento di quartieri difficili negli USA.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da Twitter

-

Essere genitori2 settimane fa

Essere genitori2 settimane faI bambini che libereranno Faccetta nera

-

Spirito2 settimane fa

Spirito2 settimane faBreve commento di mons. Viganò sull’enciclica di Leone sull’IA

-

Spirito2 settimane fa

Spirito2 settimane faBoy scout rifiuta di inchinarsi ad Allah durante una visita in moschea

-

Stragi1 settimana fa

Stragi1 settimana faCani e droni killer negli ospedali, stupri sistemici, affamati usati come pratica di tiro: chirurgo racconta gli orrori di Gaza

-

Intelligenza Artificiale2 settimane fa

Intelligenza Artificiale2 settimane faL’enciclica sull’IA è stata scritta con l’IA?

-

Gender2 settimane fa

Gender2 settimane fa«L’omosessualità è un disturbo mentale»: psichiatra ad un congresso medico

-

Armi biologiche1 settimana fa

Armi biologiche1 settimana faDocumenti desecretati collegano l’epidemia di Lyme al programma statunitense di armi biologiche

-

Stato7 giorni fa

Stato7 giorni faQuando fuggono i cavalli della Repubblica