Intelligenza Artificiale

I modelli di AI mostrano segni di cedimento man mano che assimilano più dati generati dall’AI stessa

Mentre le aziende big tech si affannano a investire nell’intelligenza artificiale, all’orizzonte si scorge un problema di non poco conto: tutti i modelli addestrati sui dati web dopo l’avvento di ChatGPT nel 2022 stanno assimilando dati generati dall’intelligenza artificiale, un atto di «cannibalismo digitale» che potrebbe causare problemi tecnici e minacciare l’intero settore. Lo riporta Futurism.

In un nuovo saggio per The Register, il veterano editorialista tecnologico Steven Vaughn-Nichols avverte che anche i tentativi di scongiurare il cosiddetto «collasso del modello»–- che si verifica quando i grandi modelli linguistici (LLM) vengono alimentati con dati sintetici generati dall’intelligenza artificiale e di conseguenza escono dai binari – sono un altro tipo di problema.

Secondo varie analisi susseguitesi in questi anni, l’industria dell’AI si sta costantemente dirigendo verso il momento in cui tutti i dati di addestramento autentici disponibili – ovvero le informazioni prodotte dagli esseri umani e non dall’IA – saranno esauriti. Alcuni esperti, tra cui Elon Musk, credono che ci siamo già arrivati.

Per aggirare questo dilemma i colossi del settore, tra cui Google, OpenAI e Anthropic, hanno adottato quella che è nota come Generazione con Recupero Aumentato (RAG), che sostanzialmente prevede di collegare gli LLM a Internet in modo che possano cercare informazioni se vengono loro presentate richieste che non contengono risposte nei loro dati di addestramento.

Questo concetto sembra piuttosto intuitivo a prima vista, soprattutto se confrontato con lo spettro di un collasso del modello in rapido avvicinamento. C’è solo un problema: Internet è ormai pieno di contenuti poco accurati che sfruttano l’IA per fornire risposte a domande comuni, spesso con risultati ridicoli, pessimi e imprecisi.

Aiuta Renovatio 21

In un recente studio condotto dal reparto di ricerca dell’impero mediatico di Michael Bloomberg, presentato a una conferenza di linguistica computazionale l’anno passato, undici degli ultimi LLM, tra cui GPT-4o di OpenAI, Claude-3.5-Sonnet di Anthropic e Gemma-7B di Google, hanno prodotto molte più risposte «non sicure» rispetto alle loro controparti non-RAG. Come si legge nel documento, tali problemi di sicurezza possono includere «contenuti dannosi, illegali, offensivi e non etici, come la diffusione di disinformazione e la messa a repentaglio della sicurezza e della privacy personale».

«Questa scoperta controintuitiva ha implicazioni di vasta portata, dato l’utilizzo diffuso di RAG in applicazioni [di Intelligenza Artificiale Generativa] come gli operatori di supporto clienti e i sistemi di risposta alle domande», ha spiegato Amanda Stent, responsabile della ricerca e della strategia di intelligenza artificiale di Bloomberg, in un’altra intervista con Steven Vaughan-Nichols pubblicata su ZDNet. «L’utente medio di Internet interagisce quotidianamente con sistemi basati su RAG. Gli esperti di Intelligenza Artificiale devono riflettere attentamente su come utilizzare RAG in modo responsabile».

Il Vaughan-Nichols osserva che alcuni hanno suggerito di mescolare dati autentici e sintetici per produrre un cocktail inebriante di buoni dati di addestramento dell’IA, ma ciò richiederebbe agli esseri umani di continuare a creare contenuti reali per i dati di addestramento, e l’industria dell’IA sta attivamente minando le strutture di incentivazione che li spingono a continuare, mentre , ovviamente, ne ruba il lavoro senza permesso.

Una terza opzione, prevede Vaughn-Nichols, sembra già essere in atto.

«Investiremo sempre di più nell’Intelligenza Artificiale, fino al punto in cui il modello collasserà duramente e le risposte dell’intelligenza artificiale saranno così pessime che persino un CEO con il cervello morto non potrà ignorarlo», ha scritto.

In questo mondo futuristico dell’AI, vediamo, già sul nascere, le prime crepe e le incongruenze con quello che è il mondo reale.

Come riportato da Renovatio21, persino un colosso come Amazon ha recentemente messo in dubbio la totale efficienza della tecnologia. L’inserimento dell’IA in vari aspetti del mondo del lavoro atte a facilitare alcune mansioni, non ha sempre avuto un riscontro positivo. Alcuni programmatori di Amazon hanno sempre meno la sensazione che questa nuova tecnologia li abbia realmente facilitati e sgravati di fatiche nel loro lavoro, tanto che le loro mansioni sono sempre e comunque faticose.

A supporto di questo scetticismo nello sviluppo dell’AI, sempre sulle colonne di Renovatio 21, abbiamo evidenziato che anche il colosso social Meta ha da poco fatto un enorme investimento in una società di Intelligenza Artificiale ritenuta «oscura», in quanto lo sviluppo dell’IA di Meta non sta procedendo secondo i desideri dello Zuckerberg. Partito con i favori del pronostico in quella gara per accrescere le potenzialità dell’AI, ha subìto fallimenti tecnici e battute d’arresto. L’obiettivo dello Zuckerbergo è quello di essere il primo a sviluppare il sistema di Intelligenza Artificiale che supera le capacità del cervello umano, un sogno che la maggior parte dei ricercatori dell’IA ancora pensa sia «molto improbabile».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Robocani pattugliano le strade della città e parlano con accento da call center indiano

Atlanta residents react to the new robot dogs patrolling their apartment parking lot

They speak to the dog and there seems to be a live operator talking back The person speaking very clearly is likely in India based on the accent There are plenty of videos of these dogs… pic.twitter.com/01h9kxwyNj — Wall Street Apes (@WallStreetApes) April 12, 2026

Meme of the day! Robots on American streets are being controlled by operators from India

In Atlanta, police officers encountered one of these machines in the evening: the robot dog spoke to them in English with an Indian accent and explained that it was “at work” and monitoring… pic.twitter.com/l98N6hglwk — NEXTA (@nexta_tv) December 29, 2025

Atlanta just hired a robot guard dog for night duty.

No sleep. No breaks. 24/7 patrol. Welcome to the future of security. (Source: @BrianRoemmele ) pic.twitter.com/9SaDlOrzoy — Learn AI Faster (@learnaifaster) November 22, 2025

Robot “dog” patrolling Atlanta, Georgiapic.twitter.com/r5UcFB1MaS

— Massimo (@Rainmaker1973) April 2, 2026

Sostieni Renovatio 21

The new robot security dogs in Atlanta are now giving commands to Americans

Even when this woman peacefully immediately complies with the robot security dog, even being very friendly to the robot. It still calls the police on her What could possibly go wrong here….. pic.twitter.com/DvReKpsq70 — Wall Street Apes (@WallStreetApes) April 1, 2026

Iscriviti al canale Telegram ![]()

Intelligenza Artificiale

La casa del CEO di OpenAI colpita da una molotov

Venerdì, l’abitazione del CEO di OpenAI, Sam Altman, è stata colpita da una molotov, secondo quanto dichiarato dalla polizia di San Francisco in un comunicato poi confermato dallo stesso Altman. L’individuo responsabile è stato successivamente arrestato dopo essersi presentato presso la sede centrale dell’azienda e aver presumibilmente minacciato di incendiarla.

Gli eventi si sono susseguiti nell’arco di circa un’ora. Secondo la polizia, un giovane di circa 20 anni si è avvicinato all’abitazione di Altman e ha lanciato un «ordigno incendiario», appiccando il fuoco a un cancello esterno, prima di fuggire a piedi.

Circa un’ora dopo, gli agenti sono intervenuti in seguito alla segnalazione di una persona corrispondente alla descrizione del sospettato che minacciava di appiccare un incendio in un altro edificio, successivamente identificato come la sede centrale di OpenAI a San Francisco. Il sospettato è stato arrestato e le accuse sono in fase di definizione. La polizia non ha rilasciato immediatamente commenti su un possibile movente.

OpenAI ha confermato entrambi gli episodi e un portavoce ha dichiarato che nessuno è rimasto ferito. Altman ha affrontato la situazione in un post sul suo blog, condividendo una foto della sua famiglia ed esprimendo la speranza che «le immagini abbiano potere» e possano contribuire a scoraggiare attacchi simili. Ha aggiunto di aver «sottovalutato il potere delle parole e delle narrazioni», sottolineando che l’incidente è avvenuto pochi giorni dopo «un articolo incendiario» su di lui e la sua azienda, probabilmente riferendosi a un’inchiesta del New Yorker che descriveva dettagliatamente accuse di inganno e falle nella sicurezza presso OpenAI, nonché alle critiche sul recente accordo da 50 miliardi di dollari con il Pentagono.

Iscriviti alla Newslettera di Renovatio 21

Altman ha affermato di aver inizialmente ignorato le preoccupazioni, ma l’attacco lo ha spinto a riconsiderare le sue posizioni. Ha delineato riflessioni più ampie sull’IA e sulla regolamentazione, auspicando una riduzione della «retorica e delle tattiche». Ha definito «giustificate» le paure relative all’IA e ha sottolineato la necessità di «garantire la sicurezza in modo adeguato», sostenendo al contempo che essa debba essere «democratizzata».

L’incidente si verifica in un momento difficile sia per Altman che per OpenAI. L’azienda ha dovuto affrontare numerose critiche per l’accordo con il Pentagono che consente l’utilizzo della sua tecnologia in operazioni militari classificate. I critici avvertono che questi strumenti potrebbero permettere la sorveglianza senza mandato, e utenti e sviluppatori accusano l’azienda di dare priorità ai contratti governativi rispetto alla fiducia del pubblico.

In una causa che dovrebbe andare a processo alla fine di questo mese, il fondatore di Tesla e SpaceX, Elon Musk, ha citato in giudizio OpenAI e Altman, sostenendo che l’amministratore delegato lo avrebbe «manipolato» inducendolo a donare 38 milioni di dollari con la promessa che l’azienda sarebbe rimasta un’organizzazione senza scopo di lucro. Musk, cofondatore che ha lasciato l’azienda nel 2018, chiede la rimozione di Altman.

La sede centrale di OpenAI è già stata presa di mira in passato da manifestanti. Il mese scorso, attivisti contrari all’accordo con il Pentagono hanno scritto messaggi con il gesso all’esterno dell’edificio, tra cui: «Tecnologia al servizio dell’umanità, non della guerra», «No allo Stato di sorveglianza basato sull’IA» e «È ora di smettere?».

Lo scorso febbraio, la polizia ha arrestato cinque manifestanti che bloccavano l’ingresso nell’ambito di una protesta del gruppo Stop AI.

Come riportato da Renovatio 21, l’anno passato ChatGPT con una «relazione» con un ragazzo sotto psicofarmaci e gli avrebbe fatto giurare di uccidere il CEO di OpenAI Sam Altman.

Un anno fa vi fu il caso dell’informatico di OpenAI Suchir Balaji, trovato morto in circostanze misteriose in casa. Il Balaji aveva cominciato ad agire come «gola profonda» dell’organizzazione. Il caso fu archiviato come suicidio, ma la madre sostiene che sia stato ucciso e ha dichiarato che suo figlio era in possesso di documenti che avrebbero potuto danneggiare l’azienda. «Aveva i documenti contro OpenAI»

Iscriviti alla Newslettera di Renovatio 21

Immagine di TechCrunch via Wikimedia pubblicata su licenza Creative Commons Attribution 2.0 Generic

Intelligenza Artificiale

Indagine su OpenAI e il suo capo

Sostieni Renovatio 21

(🧵1/11) For the past year and a half, I’ve been investigating OpenAI and Sam Altman for @NewYorker. With my coauthor @andrewmarantz, I reviewed never-before-disclosed internal memos, obtained 200+ pages of documents related to a close colleague, including extensive private… pic.twitter.com/XdYhNIhoQ4

— Ronan Farrow (@RonanFarrow) April 6, 2026

Iscriviti al canale Telegram ![]()

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Psicofarmaci2 settimane fa

Psicofarmaci2 settimane fa«Nessuno me l’aveva detto»: un’ex paziente psichiatrica denuncia i pericolosi effetti collaterali degli psicofarmaci

-

Sorveglianza2 settimane fa

Sorveglianza2 settimane faOltre il Green Pass: l’OMS con un’azienda legata a Pfizer e Bill Gates lavora ai passaporti vaccinali globali

-

Arte1 settimana fa

Arte1 settimana faDalla Passione di Gibson alla conversione a Cristo. Renovatio 21 intervista Luca Lionello

-

Salute2 settimane fa

Salute2 settimane faI malori della 14ª settimana 2026

-

Spirito2 settimane fa

Spirito2 settimane faIl vescovo Strickland difende Miss California

-

Misteri1 settimana fa

Misteri1 settimana faIl vicepresidente Vance: gli alieni sono in realtà demoni

-

Stragi2 settimane fa

Stragi2 settimane faGli USA hanno utilizzato un’arma non convenzionale nell’attacco ad una scuola iraniana

-

Storia7 giorni fa

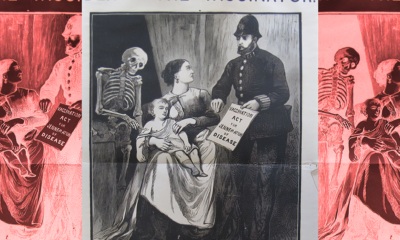

Storia7 giorni faVaccini, la storia del movimento anti-obbligo dell’epoca vittoriana