Intelligenza Artificiale

Verifica dell’età tramite riconoscimento facciale: ecco gli effetti della nuova legge britannica sulla sicurezza online

A gennaio Ofcom, l’ente regolatore delle comunicazioni del Regno Unito, pubblicherà i requisiti che le piattaforme online dovranno soddisfare per rendere effettiva la verifica dell’età, che si prevede saranno «altamente accurati». Lo riporta il sito Reclaim The Net.

A giudicare dalle dichiarazioni rilasciate ora dal direttore delle politiche di sicurezza online dell’Ofcom, Jon Higham, il metodo impiegherà un qualche tipo di riconoscimento facciale.

Il risultato potrebbe essere il blocco di «milioni» di minori, mentre ciò avviene come conseguenza della controversa legge nazionale sulla censura online, l’Online Safety Act.

In precedenza, il Segretario di Stato per la scienza, l’innovazione e la tecnologia Peter Kyle aveva affermato che, a meno che le aziende tecnologiche non «migliorassero» la verifica dell’età, il Regno Unito avrebbe potuto decidere di vietare l’uso dei social media agli utenti di età inferiore ai 16 anni.

Higham ha affermato in un’intervista che le aziende dietro le piattaforme dovranno implementare una tecnologia altamente accurata ed efficace e ha menzionato la stima dell’età facciale come «abbastanza buona» per indovinare se un utente è un bambino o un adulto.

Il rapporto non spiega come funzionerebbero i controlli dell’età pianificati, ma aziende come Yoti che vendono questo tipo di servizio chiedono agli utenti di scattarsi dei selfie: ciò può essere fatto in tempo reale con lo strumento dell’azienda oppure l’immagine può essere inviata alla sua API.

Da lì in poi, l’Intelligenza Artificiale viene utilizzata per analizzare un volto, valutare l’età ed eseguire un controllo di vitalità. Questo viene pubblicizzato per qualche ragione come un modo meno invasivo della privacy per accertare l’età di un utente rispetto al dover presentare un documento d’identità rilasciato dal governo ai siti social.

Tuttavia, gli utenti devono fidarsi di chi effettua la stima dell’età basata sui dati biometrici: non memorizzeranno le immagini dei loro volti, ma le cancelleranno immediatamente.

Le aziende tecnologiche che violano le norme dell’Online Safety Act pagheranno multe ingenti, fino al 10% del fatturato globale, e se tali infrazioni dovessero continuare, i loro dirigenti potrebbero trascorrere fino a due anni in prigione.

Come riportato da Renovatio 21, uno studio condotto dall’autorità governativa di regolamentazione delle comunicazioni nel Regno Unito ha rilevato che un quarto dei bambini di soli 3-4 anni possiede uno smartphone.

Il commissario governativo per l’infanzia britannico, Rachel de Souza, aveva commentato all’epoca che «l’uso dei social media e delle piattaforme di messaggistica da parte dei minorenni è molto diffuso. Le tutele previste dall’Online Safety Act devono essere implementate in modo rapido e deciso, con efficaci garanzie sull’età».

La presenza in rete di bambini piccoli, e casi conclamati di predatori pedofili che si muovono in rete (talvolta con una strana libertà concessa dalle grandi piattaforme) hanno portato nel Regno Unito ad una stretta sulla sorveglianza di internet.

Le tecnologie di riconoscimento facciale, già attive ovunque (dalla Cina all’Europa, dal Sudamerica a Israele ai Paesi Arabi) nel contesto delle telecamere di sorveglianza, ora verranno implementate sempre più dagli smartphone, come già evidente nel caso degli iPhone, dove il tasto di sblocco è stato sostituito dalla face recognition via telecamera.

Iscriviti al canale Telegram ![]()

Come riportato da Renovatio 21, in Gran Bretagna la face recognition era stata proposta per escludere dai locali pubblici i non vaccinati.

Negli USA si è già avuto un caso di cittadino arrestato ingiustamente perché riconosciuto dalle telecamere in uno Stato mai visitato. Il Regno di Spagna già utilizza il sistema di identificazione biometrica automatica ABIS da anni.

Anche nell’Ucraina in guerra la tecnologia è abbondantemente utilizzata per fini militari, come l’identificazione dei soldati russi deceduti.

Curiosamente, le grandi aziende tecnologiche americane rifiutarono l’uso del riconoscimento facciale durante le rivolte razziali americane di Black Lives Matter del 2020.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Donna fa causa a OpenAI: ChatGPT le avrebbe scatenato contro uno stalker spietato

Sostieni Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Google sigla un accordo con il Pentagono sull’Intelligenza Artificiale

Google ha raggiunto un accordo per fornire al Pentagono i suoi modelli di Intelligenza Artificiale destinati a uso secretato. Lo riporta il New York Times.

L’intesa è stata siglata nonostante le proteste interne all’azienda e le persistenti controversie sulle applicazioni militari della tecnologia. A partire dallo scorso anno, il Pentagono ha rapidamente ottenuto l’accesso all’intelligenza artificiale avanzata tramite accordi analoghi con i principali sviluppatori del settore.

Secondo le informazioni diffuse, l’accordo amplia un contratto da 200 milioni di dollari firmato nel 2025, che consente all’IA Gemini di Google di funzionare su reti classificate. Il colosso tecnologico ha confermato l’intesa, senza però fornire ulteriori dettagli.

«Siamo orgogliosi di far parte di un ampio consorzio… che fornisce servizi di AI a supporto della sicurezza nazionale», ha dichiarato la portavoce dell’azienda, Jenn Crider, aggiungendo che Google resta impegnata a garantire che l’IA non venga utilizzata per la sorveglianza di massa interna o per armi autonome senza supervisione umana.

Secondo quanto riportato per primo dalla testata della Silicon Valley The Information, il Pentagono potrà ora impiegare l’intelligenza artificiale di Google per «qualsiasi scopo governativo lecito», termini che ricalcano gli accordi stipulati con altri sviluppatori di IA.

Funzionari statunitensi sostengono che il nuovo contratto mira a garantire alle forze armate maggiore flessibilità ed evitare la dipendenza da un unico fornitore, integrando l’IA in operazioni sensibili come la pianificazione delle missioni e il puntamento delle armi. Tuttavia, l’accordo consentirebbe al Pentagono di richiedere modifiche ai filtri di sicurezza di Google, pur specificando che l’azienda non può porre il veto a decisioni «legittime per il governo», clausola che ha destato preoccupazione tra i critici.

Sostieni Renovatio 21

L’intesa ha scatenato polemiche interne a Google. In una lettera aperta pubblicata questa settimana, oltre 600 dipendenti, tra cui dirigenti di alto livello, hanno esortato l’amministratore delegato Sundar Pichai a interrompere l’utilizzo dell’AI dell’azienda in ambito militare, avvertendo che potrebbe essere impiegata in «modi disumani o estremamente dannosi». Hanno chiesto una moratoria su tali contratti, maggiore trasparenza e la creazione di un comitato etico per supervisionare le collaborazioni con le forze armate.

L’accordo arriva dopo la controversia tra il Pentagono e la startup Anthropic, che all’inizio di quest’anno si era rifiutata di allentare le misure di sicurezza relative alla sorveglianza e alle armi autonome. Il dipartimento della Difesa l’aveva definita un «rischio per la catena di approvvigionamento», escludendola di fatto da futuri contratti. Da allora Anthropic ha impugnato la decisione in tribunale.

Altre aziende hanno scelto un approccio diverso. OpenAI ha recentemente concluso un accordo per implementare i suoi modelli su reti classificate del Pentagono, mentre xAI di Musk ha integrato i suoi sistemi nella piattaforma interna di IA delle forze armate, GenAI.mil, utilizzata da milioni di persone.

La spinta del Pentagono verso l’IA ha provocato proteste da parte di lavoratori del settore tecnologico e attivisti, che mettono in guardia contro l’impiego della tecnologia in ambito militare senza adeguati controlli. Il mese scorso manifestanti si sono radunati davanti agli uffici di OpenAI con slogan come «No allo stato di sorveglianza basato sull’IA» e «Orwell ci aveva avvertito».

Il Pentagono ribadisce di non avere intenzione di utilizzare l’AI per la sorveglianza di massa sul territorio nazionale o per armi completamente autonome, ma continua a promuovere un ampio accesso ai sistemi avanzati per «qualsiasi uso lecito».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

La Florida indaga su OpenAI per le stragi suggerite dai chatbot

Sostieni Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Spirito2 settimane fa

Spirito2 settimane faMons. Viganò sullo scontro tra Trump e Leone

-

Bizzarria2 settimane fa

Bizzarria2 settimane faL’uomo nudo continua a terrorizzare l’Italia: l’anarconudismo figlio dell’anarcotirannia

-

Spirito2 settimane fa

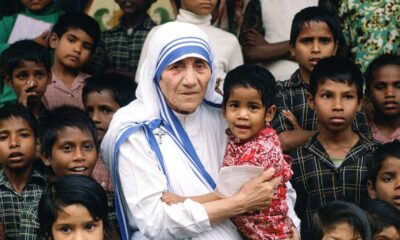

Spirito2 settimane faMadre Teresa disse a un sacerdote: la Comunione sulla mano era «il peggior male» mai visto

-

Misteri1 settimana fa

Misteri1 settimana faEsperto di UFO trovato morto suicida. Aveva ripetuto che mai lo avrebbe fatto

-

Pensiero1 settimana fa

Pensiero1 settimana faIl manifesto di Palantir in sintesi

-

Militaria2 settimane fa

Militaria2 settimane faPrigionieri palestinesi stuprati dai cani addestrati dell’esercito israeliano

-

Persecuzioni2 settimane fa

Persecuzioni2 settimane faLa foto del soldato israeliano che distrugge la statua di Nostro Signore è autentica: l’esercito degli ebrei ammette

-

Spirito5 giorni fa

Spirito5 giorni faLeone e l’arcivescovessa, mons. Viganò: Roma sta con gli eretici e nega le cresime ai tradizionisti