Senza categoria

La Svezia innalzerà l’età minima per il richiamo militare a 70 anni

La Svezia prevede di aumentare drasticamente l’età massima di coscrizione per gli ex ufficiali militari nell’ambito di un ampio sforzo per espandere le sue forze armate, ha riferito domenica l’emittente statale SVT. La proposta arriva mentre il Paese impegna miliardi di dollari per il potenziamento delle sue forze armate.

Il mese scorso, i leader della NATO hanno concordato di aumentare l’obiettivo di spesa per la difesa dal 2% al 5% del PIL, destinando il 3,5% direttamente alle forze armate e il resto a iniziative di sicurezza più ampie. Bruxelles aveva precedentemente presentato il programma ReArm Europe da 800 miliardi di euro.

Secondo il reportage, Stoccolma aumenterà il limite di età per richiamare gli ex ufficiali al servizio militare da 47 a 70 anni.

La proposta proviene da una commissione nominata dal governo incaricata di affrontare il reclutamento militare a lungo termine. Il gruppo propone di abolire l’attuale norma che rimuove gli ex militari dal registro militare dopo dieci anni senza addestramento, consentendo agli ufficiali con almeno un anno di servizio attivo o di riserva di rimanere idonei alla chiamata fino all’età di 70 anni.

Sostieni Renovatio 21

Secondo quanto riferito, la modifica proposta ripristinerebbe migliaia di nomi che erano stati rimossi dal registro in base ai limiti attuali, che finora hanno fissato a 47 anni l’età minima per la coscrizione.

La proposta fa parte di un piano più ampio per potenziare le forze armate. La Svezia, entrata a far parte della NATO nel marzo 2024, si è impegnata a quasi raddoppiare il proprio personale militare, portandolo a 115.000 unità entro il 2030, rispetto alle 60.000 unità del 2023.

Il Paese ha reintrodotto la coscrizione obbligatoria nel 2017, dopo quasi un decennio di servizio esclusivamente volontario, adducendo preoccupazioni per la sicurezza regionale.

Tutti i partiti parlamentari hanno inoltre sostenuto l’impegno a stanziare altri 300 miliardi di corone (31,4 miliardi di dollari) per la difesa, in aggiunta ai crescenti bilanci annuali.

Questo sviluppo riflette una più ampia spinta alla militarizzazione tra gli stati membri europei della NATO, che affermano di dover aumentare i propri bilanci per la difesa per contrastare quella che descrivono come una minaccia proveniente dalla Russia. Mosca ha negato che rappresenti una minaccia per questi paesi, accusando i funzionari occidentali di alimentare la paura per giustificare l’impennata delle spese militari e il calo del tenore di vita in tutto il continente.

Come riportato da Renovatio 21, Paesi come Germania, Gran Bretagna, Croazia sono tra quelli che hanno proposto la reintroduzione della naja.

La Danimarca, in grande stile di equità sociale nordica, è andata oltre estendendo il servizio militare anche alle donne.

Iscriviti alla Newslettera di Renovatio 21

Immagine di Chief, National Guard Bureau via Wikimedia pubblicata su licenza Creative Commons Attribution 2.0 Generic

Senza categoria

Trump vorrebbe Putin al G20 di Miami

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

La Florida indaga su OpenAI per le stragi suggerite dai chatbot

La Florida ha avviato un’indagine penale contro OpenAI e ChatGPT in relazione alla sparatoria avvenuta presso la Florida State University, pianificata dall’autore con l’aiuto del chatbot basato sull’intelligenza artificiale.

L’incidente è avvenuto nell’aprile del 2025, quando il sospettato avrebbe ucciso due persone e ne avrebbe ferite sei. Successivamente è rimasto ferito in una sparatoria con la polizia ed è stato arrestato. L’uomo armato, che si è poi rivelato essere il figlio di un vice sceriffo, è stato accusato di omicidio plurimo e tentato omicidio.

Lo Stato americano sta ora indagando sul ruolo di ChatGPT nell’attacco e cerca di stabilire se «OpenAI abbia responsabilità penale» per le azioni del chatbot, ha annunciato martedì il procuratore generale floridiano, James Uthmeier.

Sostieni Renovatio 21

«Il chatbot consigliava al tiratore quale tipo di arma usare, quali munizioni erano compatibili con ciascuna arma e se un’arma sarebbe stata utile o meno a distanza ravvicinata», ha dichiarato Uthmeier in una conferenza stampa.

«Se dall’altra parte dello schermo ci fosse stata una persona, l’avremmo accusata di omicidio», ha aggiunto.

OpenAI ha insistito sul fatto di non avere alcuna responsabilità per la sparatoria di massa in Florida. Una portavoce dell’azienda di intelligenza artificiale ha dichiarato ai media statunitensi di aver collaborato «in modo proattivo» con le indagini sull’incidente, identificando un account ChatGPT ritenuto associato al sospettato e condividendo le informazioni con le autorità.

«In questo caso, ChatGPT ha fornito risposte fattuali alle domande con informazioni ampiamente reperibili su fonti pubbliche online, e non ha incoraggiato né promosso attività illegali o dannose», ha dichiarato la portavoce.

La diffusione dei chatbot ha da tempo suscitato preoccupazioni in merito ai crimini perpetrati con l’AI, espresse da numerosi ricercatori indipendenti e agenzie governative in tutto il mondo. Sebbene la maggior parte dei crimini commessi con l’IA sembri verificarsi nel settore tecnologico, tra cui attacchi hacker, cyberattacchi, frodi e furti d’identità, i chatbot sono stati ripetutamente implicati anche nel favorire crimini violenti. Una recente indagine congiunta della CNN e del Center for Countering Digital Hate, ad esempio, ha rilevato che otto leader su dieci erano pronti ad aiutare gli utenti a organizzare attacchi violenti, tra cui attentati dinamitardi a sfondo religioso, sparatorie nelle scuole e assassinii.

Come riportato da Renovatio 21, l’anno passato ChatGPT con una «relazione» con un ragazzo sotto psicofarmaci e gli avrebbe fatto giurare di uccidere il CEO di OpenAI Sam Altman.

Come riportato da Renovatio 21, Matthew Livelsberger, un Berretto Verde dell’esercito americano, altamente decorato, è sospettato di aver organizzato un’esplosione all’esterno del Trump International Hotel di Las Vegas, utilizzando strumenti di Intelligenza Artificiale, tra cui ChatGPT, per pianificare l’attacco.

Il potere pervasivo e nefasto di questa nuova tecnologia sta diventando un serio problema, come nella vicenda belga giovane vedova ha detto che il marito è stato portato a suicidarsi da un popolare chatbot di AI, mentre un bot di chat «terapeuta» dotato di intelligenza artificiale ha orribilmente incoraggiato un utente a scatenare una serie di omicidi per rendersi «felice».

C’è quindi il caso del ragazzo che due anni fa pianificò di assassinare la defunta regina Elisabetta di Inghilterra con una balestra, e il tutto sarebbe stato incoraggiato da un chatbot di Intelligenza Artificiale.

L’anno scorso tre studentesse sono rimaste ferite in un violento accoltellamento in una scuola nella città di Pirkkala, nella Finlandia meridionale. Secondo quanto riferito, il sospettato durante la pianificazione dell’attacco (durata circa sei mesi) avrebbe utilizzato ChatGPT per prepararsi.

Come riportato da Renovatio 21, due genitori hanno denunciato l’anno passato il fatto che ChatGPT avrebbe incoraggiato un adolescente a pianificare «un bel suicidio».

Meta ha dichiarato alla CNN di aver adottato misure «per risolvere il problema identificato», mentre Google e OpenAI hanno affermato che i modelli più recenti presentano misure di sicurezza rafforzate.

Secondo un recente sondaggio, circa la metà dei teenager americani afferma che parlare con l’AI è meglio che avere amici nella via reale.

Aiuta Renovatio 21

Come riportato da Renovatio 21, le «allucinazioni» di cui sono preda i chatbot ad Intelligenza Artificiale avanzata hanno già dimostrato ad abundantiam che la macchina mente, minaccia e può spingere le persone all’anoressia e perfino al suicidio. I casi di violenza indotta dall’AI potrebbero essere moltissimi, senza che possano arrivare alla stampa.

Va considerato, è già capitato che una Intelligenza Artificiale abbia suggerito ricette velenose agli utenti umani. Infatti un chatbot a sfondo culinario di una catena di alimentari neozelandese qualche mese fa aveva fatto scalpore per alcune ricette incredibili e potenzialmente letali, come la «miscela di acqua aromatica», un mix letale composto da candeggina, ammoniaca e acqua, altrimenti noto come gas di cloro mortale. Esperti a fine 2023 hanno lanciato un avvertimento riguardo i libri generati dall’Intelligenza Artificiale riguardo la raccolta dei funghi, dicendo che tali libri scritti dalle macchine potrebbero causare la morte di qualcuno.

Come riportato da Renovatio 21, in un recente caso davvero inquietante, plurimi utenti di Copilot, l’Intelligenza Artificiale di Microsoft creata in collaborazione con Open AI, hanno testimoniato su X e Reddit che il programma avrebbe una «seconda personalità» preoccupante che chiede l’adorazione degli esseri umani, come un dio crudele.

Elon Musk due anni fa aveva dichiarato durante la sua intervista con Tucker Carlson che il fine di Google – nemmeno così occulto – è quello di creare un dio-Intelligenza Artificiale. Musk, oramai quasi una decina di anni fa aveva parlato del fatto che creare l’AI era «come evocare un demone».

Iscriviti alla Newslettera di Renovatio 21

Senza categoria

Militanti incendiano chiese e case, 20 morti nel Nord-Est della Nigeria

Iscriviti alla Newslettera di Renovatio 21

-

Pensiero2 settimane fa

Pensiero2 settimane faPerché Trump attacca il papa?

-

Vaccini2 settimane fa

Vaccini2 settimane faElon Musk ha subito danni dal vaccino COVID. Ex dirigente Pfizer ammette: il siero potrebbe aver ucciso migliaia di persone

-

Intelligence2 settimane fa

Intelligence2 settimane faIl nono scienziato legato ai segreti della NASA muore misteriosamente

-

Pensiero1 settimana fa

Pensiero1 settimana faLa vera natura dei progetti di legge sull’antisemitismo. Intervista al prof. Marini

-

Spirito1 settimana fa

Spirito1 settimana faMons. Viganò sullo scontro tra Trump e Leone

-

Bizzarria6 giorni fa

Bizzarria6 giorni faL’uomo nudo continua a terrorizzare l’Italia: l’anarconudismo figlio dell’anarcotirannia

-

Arte1 settimana fa

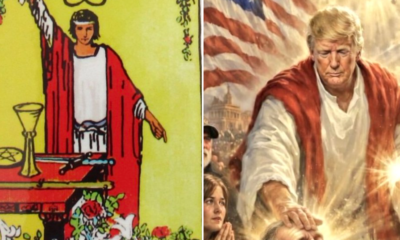

Arte1 settimana faMarina Abramovic definisce Trump «il mago di più alto livello»

-

Occulto2 settimane fa

Occulto2 settimane faLeader del «culto dell’orgasmo», condanna a nove anni di carcere (no, non è chi pensate voi)