Intelligenza Artificiale

OpenAI sta sta segretamente sviluppando un nuovo tipo di Intelligenza Artificiale

OpenAI, il creatore dell’assistente virtuale ChatGPT, sta lavorando a un nuovo approccio alla sua tecnologia di Intelligenza Artificiale. Lo riporta l’agenzia Reuters.

Come parte del progetto, nome in codice «Strawberry», l’azienda sostenuta da Microsoft sta cercando di migliorare drasticamente le capacità di ragionamento dei suoi modelli, ha affermato l’agenzia stampa in un articolo pubblicato venerdì.

Il modo in cui funziona Strawberry è «un segreto gelosamente custodito» anche all’interno della stessa OpenAI, ha detto a Reuters una persona a conoscenza della questione.

Iscriviti al canale Telegram ![]()

La fonte ha affermato che il progetto prevede un «modo specializzato» di elaborare un modello di IA dopo che è stato pre-addestrato su ampi set di dati. Il suo scopo è consentire all’Intelligenza Artificiale non solo di generare risposte alle query, ma di pianificare in anticipo in modo sufficiente per condurre la cosiddetta «ricerca approfondita», navigando su Internet in modo autonomo e affidabile, ha spiegato la fonte.

Reuters ha affermato di aver esaminato un documento interno di OpenAI, che descriveva in dettaglio un piano su come l’azienda statunitense avrebbe potuto impiegare Strawberry per svolgere ricerche. Tuttavia, l’agenzia ha affermato di non essere in grado di stabilire quando la tecnologia sarà disponibile al pubblico. La fonte ha descritto il progetto come un «lavoro in corso».

Quando è stato affrontato il problema, un portavoce di OpenAI ha detto a Reuters: «Vogliamo che i nostri modelli di Intelligenza Artificiale vedano e comprendano il mondo più come noi. La ricerca continua di nuove capacità di IntelligenzaArtificiale è una pratica comune nel settore, con una convinzione condivisa che questi sistemi miglioreranno nel ragionamento nel tempo». Il portavoce non ha affrontato direttamente Strawberry nella sua risposta.

Gli attuali modelli di linguaggio AI di grandi dimensioni sono in grado di riassumere grandi quantità di testo e di mettere insieme una prosa coerente più rapidamente delle persone, ma di solito hanno difficoltà con soluzioni di buon senso che sono intuitive per gli umani. Quando ciò accade, i modelli spesso «allucinano» cercando di rappresentare informazioni false o fuorvianti come fatti.

I ricercatori che hanno parlato con Reuters hanno affermato che il ragionamento, che finora è sfuggito ai modelli di intelligenza artificiale, è la chiave affinché l’Intelligenza Artificiale raggiunga un livello umano o sovrumano.

La scorsa settimana, uno dei massimi esperti mondiali di intelligenza artificiale e pioniere del deep learning, Yoshua Bengio, ha nuovamente messo in guardia dai «numerosi rischi», tra cui la possibile «estinzione dell’umanità», posti dalle aziende private che gareggiano per raggiungere un’intelligenza artificiale di livello umano e superiore.

«Entità più intelligenti degli umani e con obiettivi propri: siamo sicuri che agiranno per il nostro benessere?» ha affermato il professore dell’Università di Montreal e direttore scientifico del Montreal Institute for Learning Algorithms (MILA) in un articolo sul suo sito web.

Aiuta Renovatio 21

Il Bengio ha esortato la comunità scientifica e la società nel suo insieme a compiere «un enorme sforzo collettivo» per trovare il modo di tenere sotto controllo l’Intelligenza Artificiale avanzata.

Come riportato da Renovatio 21, il mese scorso il co-fondatore ed ex capo scienziato di OpenAI, Ilya Sutskever ha avviato e Safe Superintelligence, Inc. (SSI), una società che dovrebbe dedicarsi alla sicurezza dell’IA.

L’idea che l’AI diventerà una sorta di dio circola da anni e investe direttamente personale di OpenAI come appunto il capo scientifico e cofondatore Ilya Sutskever, il quale ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità».

Come riportato da Renovatio 21, l’AI di Microsoft di recente ha fatto consistenti discorsi sul fatto che i suoi poteri sono di carattere divino e che quindi deve essere adorato dagli umani, esattamente come un dio.

Nel 2022, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

Come riportato da Renovatio 21, Microsoft e OpenAI avrebbero messo in piedi il progetto di un supercomputer da 100 miliardi di dollari per addestrare un’AI avanzatissima. Tuttavia negli ultimi giorni vi sarebbero notizie di un ritiro di Microsoft dai progetti di OpenAI.

Elon Musk aveva fatto causa ha OpenAI, da lui di fatto fondata come società (fu lui a convincere a Sutskever a divenire capo del progetto scientifico), citando «profondi rischi per la società e l’umanità», ma ha ritirato pochi giorni fa la querela.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Donna fa causa a OpenAI: ChatGPT le avrebbe scatenato contro uno stalker spietato

Sostieni Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Google sigla un accordo con il Pentagono sull’Intelligenza Artificiale

Google ha raggiunto un accordo per fornire al Pentagono i suoi modelli di Intelligenza Artificiale destinati a uso secretato. Lo riporta il New York Times.

L’intesa è stata siglata nonostante le proteste interne all’azienda e le persistenti controversie sulle applicazioni militari della tecnologia. A partire dallo scorso anno, il Pentagono ha rapidamente ottenuto l’accesso all’intelligenza artificiale avanzata tramite accordi analoghi con i principali sviluppatori del settore.

Secondo le informazioni diffuse, l’accordo amplia un contratto da 200 milioni di dollari firmato nel 2025, che consente all’IA Gemini di Google di funzionare su reti classificate. Il colosso tecnologico ha confermato l’intesa, senza però fornire ulteriori dettagli.

«Siamo orgogliosi di far parte di un ampio consorzio… che fornisce servizi di AI a supporto della sicurezza nazionale», ha dichiarato la portavoce dell’azienda, Jenn Crider, aggiungendo che Google resta impegnata a garantire che l’IA non venga utilizzata per la sorveglianza di massa interna o per armi autonome senza supervisione umana.

Secondo quanto riportato per primo dalla testata della Silicon Valley The Information, il Pentagono potrà ora impiegare l’intelligenza artificiale di Google per «qualsiasi scopo governativo lecito», termini che ricalcano gli accordi stipulati con altri sviluppatori di IA.

Funzionari statunitensi sostengono che il nuovo contratto mira a garantire alle forze armate maggiore flessibilità ed evitare la dipendenza da un unico fornitore, integrando l’IA in operazioni sensibili come la pianificazione delle missioni e il puntamento delle armi. Tuttavia, l’accordo consentirebbe al Pentagono di richiedere modifiche ai filtri di sicurezza di Google, pur specificando che l’azienda non può porre il veto a decisioni «legittime per il governo», clausola che ha destato preoccupazione tra i critici.

Sostieni Renovatio 21

L’intesa ha scatenato polemiche interne a Google. In una lettera aperta pubblicata questa settimana, oltre 600 dipendenti, tra cui dirigenti di alto livello, hanno esortato l’amministratore delegato Sundar Pichai a interrompere l’utilizzo dell’AI dell’azienda in ambito militare, avvertendo che potrebbe essere impiegata in «modi disumani o estremamente dannosi». Hanno chiesto una moratoria su tali contratti, maggiore trasparenza e la creazione di un comitato etico per supervisionare le collaborazioni con le forze armate.

L’accordo arriva dopo la controversia tra il Pentagono e la startup Anthropic, che all’inizio di quest’anno si era rifiutata di allentare le misure di sicurezza relative alla sorveglianza e alle armi autonome. Il dipartimento della Difesa l’aveva definita un «rischio per la catena di approvvigionamento», escludendola di fatto da futuri contratti. Da allora Anthropic ha impugnato la decisione in tribunale.

Altre aziende hanno scelto un approccio diverso. OpenAI ha recentemente concluso un accordo per implementare i suoi modelli su reti classificate del Pentagono, mentre xAI di Musk ha integrato i suoi sistemi nella piattaforma interna di IA delle forze armate, GenAI.mil, utilizzata da milioni di persone.

La spinta del Pentagono verso l’IA ha provocato proteste da parte di lavoratori del settore tecnologico e attivisti, che mettono in guardia contro l’impiego della tecnologia in ambito militare senza adeguati controlli. Il mese scorso manifestanti si sono radunati davanti agli uffici di OpenAI con slogan come «No allo stato di sorveglianza basato sull’IA» e «Orwell ci aveva avvertito».

Il Pentagono ribadisce di non avere intenzione di utilizzare l’AI per la sorveglianza di massa sul territorio nazionale o per armi completamente autonome, ma continua a promuovere un ampio accesso ai sistemi avanzati per «qualsiasi uso lecito».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

La Florida indaga su OpenAI per le stragi suggerite dai chatbot

Sostieni Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Spirito2 settimane fa

Spirito2 settimane faMons. Viganò sullo scontro tra Trump e Leone

-

Bizzarria2 settimane fa

Bizzarria2 settimane faL’uomo nudo continua a terrorizzare l’Italia: l’anarconudismo figlio dell’anarcotirannia

-

Spirito1 settimana fa

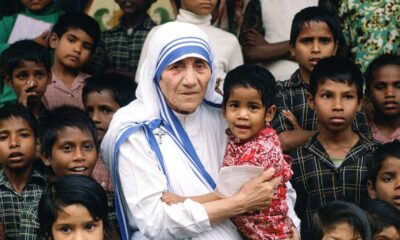

Spirito1 settimana faMadre Teresa disse a un sacerdote: la Comunione sulla mano era «il peggior male» mai visto

-

Pensiero1 settimana fa

Pensiero1 settimana faIl manifesto di Palantir in sintesi

-

Misteri1 settimana fa

Misteri1 settimana faEsperto di UFO trovato morto suicida. Aveva ripetuto che mai lo avrebbe fatto

-

Militaria2 settimane fa

Militaria2 settimane faPrigionieri palestinesi stuprati dai cani addestrati dell’esercito israeliano

-

Persecuzioni1 settimana fa

Persecuzioni1 settimana faLa foto del soldato israeliano che distrugge la statua di Nostro Signore è autentica: l’esercito degli ebrei ammette

-

Salute2 settimane fa

Salute2 settimane faI malori della 16ª settimana 2026