Big Data

Rivolte USA, Big Tech stoppa tecnologia di riconoscimento facciale

Microsoft, IBM, Google e Amazon hanno tutti messo in pausa la loro tecnologia di riconoscimento facciale a causa dei timori che ciò potesse pregiudicare le persone di colore.

Ciò si traduce materialmente nella sospensione delle possibili identificazioni automatiche dei rivoltosi che stanno mettendo a ferro e fuoco le città americane. Il che significa, semplicemente, che i grandi gruppi privilegiano la conformità alla narrativa mainstream in corso (l’emergenza del razzismo, etc.) alla sicurezza materiale delle strade – sicurezza di cui hanno diritto di godere anche i cittadini di colore che non si sono uniti alle razzie.

Questa scelta, ulteriormente, crea un problema anche professionale: in alcuni casi le aziende hanno siglato contratti con lo Stato di modo da offrire alle forze dell’ordine queste tecnologie.

Microsoft, IBM, Google e Amazon hanno tutti messo in pausa la loro tecnologia di riconoscimento facciale a causa dei timori che ciò potesse pregiudicare le persone di colore.

Per quanto questa situazione possa sembrare illogica sino al grottesco , la decisione di tutti i grandi del settore tech è presa: IBM non offrirà più la tecnologia di face recognition.

«IBM si oppone fermamente e non perdonerà l’uso di alcuna tecnologia, inclusa la tecnologia di riconoscimento facciale offerta da altri fornitori, per la sorveglianza di massa, la profilazione razziale, le violazioni dei diritti umani e delle libertà di base o qualsiasi scopo che non sia coerente con i nostri valori», ha affermato Il CEO Arvind Krishna in una lettera al Congresso questa settimana.

Allo stesso modo, l’amministratore delegato di Microsoft Brad Smith ha dichiarato che la sua azienda «non venderà la tecnologia di riconoscimento facciale ai dipartimenti di polizia negli Stati Uniti fino a quando non avremo adottato una legge nazionale, fondata sui diritti umani che regoleranno questa tecnologia».

Ciò si traduce materialmente nella sospensione delle possibili identificazioni automatiche dei rivoltosi che stanno mettendo a ferro e fuoco le città americane

Timnit Gebru, leader del team di etica dell’Intelligenza Artificiale di Google, ha dichiarato al New York Times : «Al momento dovrebbe essere vietato. Non so per il futuro».

E Amazon , che ha reagito lentamente alle critiche, sta implementando «una moratoria di un anno sull’uso da parte della polizia della tecnologia di riconoscimento facciale di Amazon». Ha aggiunto che «Speriamo che questa moratoria di un anno possa dare al Congresso abbastanza tempo per attuare le regole appropriate e siamo pronti ad aiutare se richiesto».

Amazon è stata ripetutamente attaccata negli scorsi anni per l’accuratezza del suo riconoscimento facciale. Le accuse parlavano di un «pregiudizio razziale e di genere» dell’algoritmo: in pratica, Amazon stava fornendo un’Intelligenza Artificiale razzista.

I grandi gruppi privilegiano la conformità alla narrativa mainstream in corso (l’emergenza del razzismo, etc.) alla sicurezza materiale delle strade

Amazon in particolare forniva ai dipartimenti di polizia americana il suo software di face recognition.

Anche Google ha avuto i suoi problemi con una Intelligenza Artificiale razzista: e razzista in modo davvero specioso ed offensivo. Nel 2015 la componente di riconoscimento automatico di Google Photos ha etichettato due persone di colore come «gorilla». La multinazionale si scusò molto.

Google inoltre è stata coinvolta in altre controversie che hanno creato polemiche tra gli stessi dipendenti: la creazione di un software per droni militari (veicoli armati che possono identificare un bersaglio umano e sparargli un missile per ucciderlo) e un altro progetto legato al ritorno di Google nella Cina Popolare.

Le megalopoli cinesi sono oramai incubi di totalitarismo digitale dove migliaia di telecamere informatizzate controllano gli spostamenti del cittadino semplicemente registrando il suo volto

La Cina è del resto il paradiso della face recognition. Le megalopoli cinesi sono oramai incubi di totalitarismo digitale dove migliaia (decine di migliaia) di telecamere informatizzate controllano gli spostamenti del cittadino semplicemente registrando il suo volto. In Cina il riconoscimento facciale è così avanzata da essere praticato persino sui maiali.

Il Coronavirus ha semplicemente accelerato sino al parossismo questa tendenza cinese, che – considerando le forze filocinesi al governo – può arrivare in Italia da un momento all’altro.

Michael Cook di Bioedge ricorda il gruppo per i diritti digitali Fight for the Future, che si è lamentato del fatto che le affermazioni dei colossi Big Tech americani sono solo «un’acrobazia di pubbliche relazioni»:

«Come le armi nucleari o biologiche, rappresenta una minaccia così profonda per il futuro dell’umanità che dovrebbe essere bandita apertamente »

«La realtà è che la tecnologia di riconoscimento facciale è troppo pericolosa per essere utilizzata. Come le armi nucleari o biologiche, rappresenta una minaccia così profonda per il futuro dell’umanità che dovrebbe essere bandita apertamente. I legislatori devono smettere di assecondare le compagnie Big Tech e le forze dell’ordine corrotte e fare il loro lavoro».

«Il Congresso dovrebbe agire immediatamente per vietare il riconoscimento facciale a tutti gli effetti di sorveglianza»

«Il Congresso dovrebbe agire immediatamente per vietare il riconoscimento facciale a tutti gli effetti di sorveglianza»

Nel frattempo, Ronald Bailey sottolinea in un articolo della rivista conservatrice Reason che un’altra società, la controversa Clearview AI, sta avanzando con la sua tecnologia. ClearviewAI, una piccola azienda autrice di un software davvero efficace capace di pescare immagini nel mare magnum dei social network sbaragliando ogni altro software in circolazione, «sta lasciando tutti i suoi clienti privati e venderà i suoi servizi di riconoscimento facciale solo alle forze dell’ordine».

«Clearview AI ha creato un’app che consente alla polizia di abbinare le fotografie al suo database di oltre 3 miliardi di foto cancellate da milioni di siti Web pubblici tra cui Facebook, YouTube, Twitter, Instagram e Venmo».

Nel suo articolo su Reason, Bailey cita accademici che sono inorriditi da questo sviluppo. «Il riconoscimento facciale è lo strumento perfetto per l’oppressione”, avvertono Woodrow Hartzog, professore di giurisprudenza e informatica alla Northeastern University, e Evan Selinger, filosofo del Rochester Institute of Technology».

«È il meccanismo di sorveglianza più singolarmente pericoloso mai inventato»

«È il meccanismo di sorveglianza più singolarmente pericoloso mai inventato».

Big Data

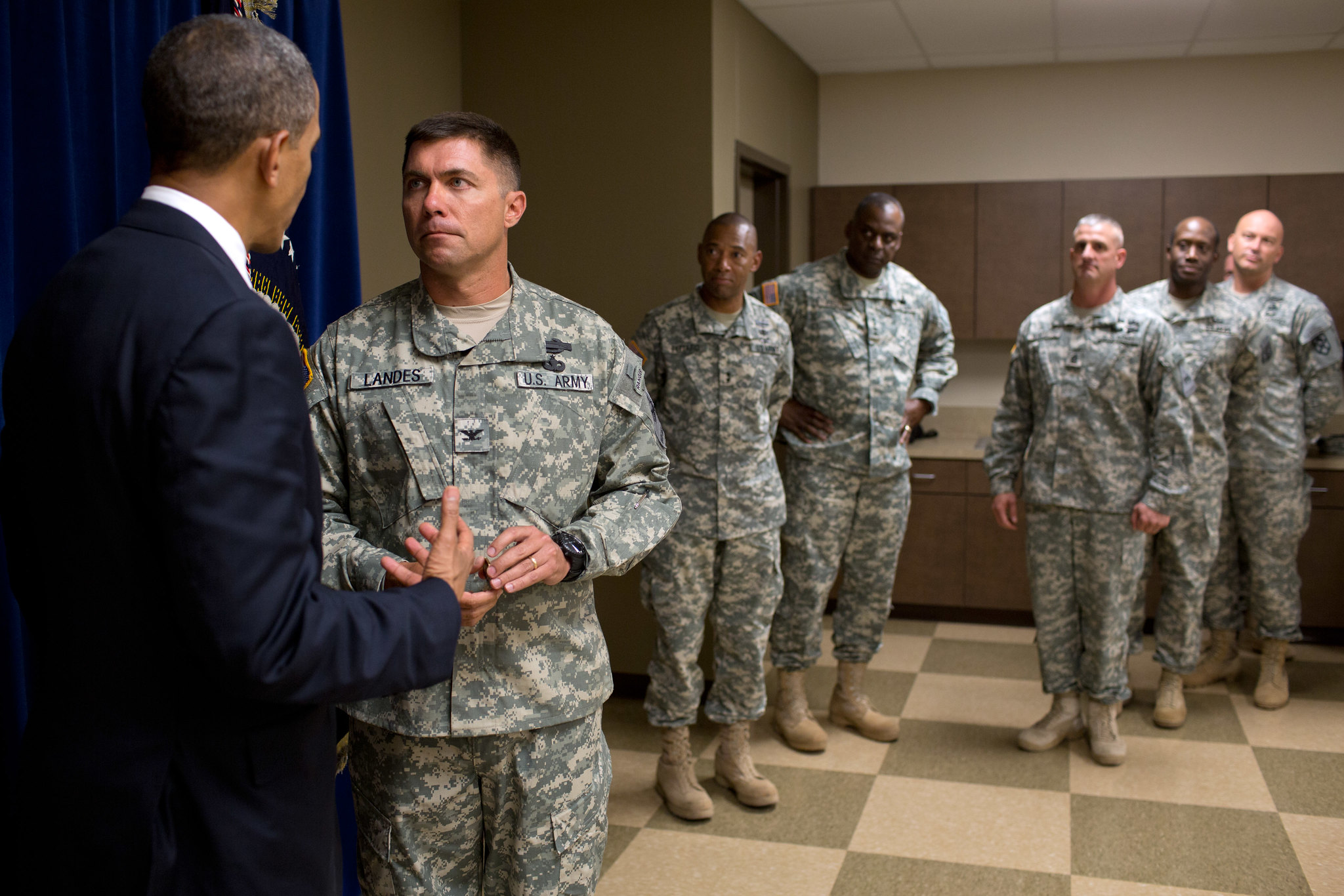

Google sta digitalizzando campioni dei tessuti biologici dei soldati USA

Google avrebbe collaborato con il Dipartimento della Difesa degli Stati Uniti per digitalizzare campioni di tessuto biologico prelevati da militari in servizio e memorizzarli in un database accessibile ai medici militari per la diagnosi e il trattamento di malattie. Lo rivela un articolo di ProPublica.

L’iniziativa fa parte di un progetto più ampio denominato «Joint Pathology Center» (JPC) volto a creare un archivio digitale di campioni di tessuti di pazienti militari per migliorare la diagnosi e il trattamento delle malattie.

Questa collaborazione solleva preoccupazioni sulla privacy dei dati dei militari, in particolare riguardo alla possibilità che i dati possano essere utilizzati per finalità militari o di sorveglianza. Tuttavia, il Dipartimento della Difesa ha assicurato che il database sarà utilizzato solo per scopi medici e che saranno implementate rigorose misure di sicurezza per proteggere la privacy dei dati dei militari.

Tali collaborazioni pongono la questione della responsabilità delle aziende tecnologiche nell’uso dei dati sanitari e sottolinea la necessità di garantire che le aziende rispettino le normative sulla privacy dei dati e siano trasparenti riguardo alle loro attività nel settore della salute.

L’articolo sottolinea inoltre come l’iniziativa di Google sia solo una delle molte collaborazioni tra aziende tecnologiche e istituti militari per la creazione di archivi di dati medici. Tuttavia, l’articolo solleva preoccupazioni sulla natura di queste collaborazioni e sull’uso dei dati dei pazienti per finalità militari o di sorveglianza.

La creazione di archivi di dati medici digitali può portare a sviluppi tecnologici che sarebbero utili anche per il campo militare, come ad esempio lo sviluppo di protesi avanzate o tecnologie di diagnosi precoce. L’uso dei dati sanitari dei pazienti per la ricerca militare potrebbe minare la fiducia dei pazienti e della popolazione nel sistema sanitario e nella ricerca medica.

La società madre di Google, Alphabet, ha precedentemente attirato l’attenzione per i suoi sforzi per raccogliere e analizzare dati medici. Nel Regno Unito, le autorità di regolamentazione hanno rimproverato un ospedale nel 2017 per aver fornito dati su oltre 1,6 milioni di pazienti, a loro insaputa, all’unità AI di Alphabet, DeepMind.

Nel 2019, il Wall Street Journal ha riferito che Google aveva un accordo segreto, soprannominato «Project Nightingale», con un sistema sanitario cattolico che gli dava accesso ai dati su milioni di pazienti in 21 Stati americani, anche all’insaputa di pazienti o medici. Google ha risposto all’articolo del WSJ in un post sul blog in cui si afferma che i dati dei pazienti «non possono e non saranno combinati con i dati dei consumatori di Google».

Come riportato da Renovatio 21, Google ha finanziato l’organizzazione collegata al laboratorio di Wuhan guidata dal famigerato Peter Daszak – EcoHealth Alliance – per oltre un decennio.

«Il braccio di beneficenza del gigante della tecnologia, Google.org, ha ripetutamente fornito sostegno finanziario per ricerche e studi condotti da Daszak, colpito dallo scandalo, e dalla sua EcoHealth Alliance con sede a New York», riportava due anni fa il quotidiano britannico Daily Mail.

Google era altresì implicata in ricerche per lo sterminio delle zanzare, rilasciando nell’ambiente zanzare maschio infettate con un batterio che le rende sterili. Un’operazione non lontanissima da quelle finanziate da Gates (e del Pentagono suo «socio»), che usano però sugli insetti la bioingegneria spinta.

Big Data

Big Data e controllo sociale: un’arma a doppio taglio per il Partito Comunista Cinese

Renovatio 21 pubblica questo articolo su gentile concessione di Asianews. Le opinioni degli articoli pubblicati non coincidono necessariamente con quelle di Renovatio 21.

I dati personali sono una risorsa strategica per il regime. Fughe massicce di informazioni rivelano l’ambizione di una sorveglianza globale della società. Quando i dati sono controllati però dai nemici della leadership, potrebbero rappresentare un pericolo.

A giugno è stato venduto online un database contenente le informazioni personali di un miliardo di cittadini cinesi e registrazioni dettagliate delle chiamate alla polizia. L’hacker ha affermato che la fuga di notizie proveniva dalla polizia di Shanghai e ha chiesto 10 bitcoin (più di 200mila dollari) di riscatto.

I campioni contengono informazioni dettagliate su nomi, numeri di telefono, numeri di carta d’identità, date di nascita e luogo di nascita dei cittadini.

Secondo il Wall Street Journal, le registrazioni delle chiamate e dei casi penali risalgono addirittura al 1995. Includono frodi, furti, violenze domestiche, stupri, oltre a dettagli su cittadini convocati dalla polizia per aver discusso di questioni politiche sul web.

La massiccia fuga di notizie dimostra che le autorità cinesi sono all’avanguardia nel mondo nella raccolta di informazioni sui cittadini, ma non riescono a proteggere i dati.

Analisti di sicurezza informatica affermano che i dati rubati erano stati ospitati sul cloud di Alibaba senza blocco crittografico per oltre un anno. Le autorità di Shanghai avrebbero convocato i dirigenti del gigante tecnologico, tra cui il vice presidente responsabile del cloud computing Chen Xuesong. Le azioni di Alibaba sono scese del 7,5% il 15 luglio.

Alibaba è un fornitore di servizi per l’infrastruttura digitale del governo. Già nel 2016 il suo fondatore Jack Ma aveva suggerito di applicare i big data alla governance e al controllo sociale.

Le autorità cinesi hanno attuato una rigida politica di blocco e di «zero-COVID» grazie a un sistema di tracciamento sviluppato dai colossi tecnologici.

Le discussioni su questa massiccia fuga di dati sono censurate sui social network cinesi. Le autorità non hanno risposto alle richieste dei media. Casi del genere si sono verificati però diverse volte in Cina.

Le leggi approvate dal 2016 non hanno impedito la perdita di dati e informazioni personali online. In larga parte esse mirano a rafforzare il controllo delle autorità sui dati e a prevenire la loro fuga all’estero.

I fornitori di servizi internet devono conservare i dati degli utenti all’interno dei confini nazionali. Ad esempio, Apple ha dovuto creare un centro dati nel sud-ovest della Cina, controllato da una società statale, per archiviare i dati degli utenti cinesi.

Le autorità cinesi sostengono in modo attivo il concetto di sovranità informatica. Sull’onda della corsa al controllo digitale, esse stanno usando vari canali per ottenere dati dall’estero, tra cui operazioni per hackerare, penetrare o acquisire società straniere.

L’app cinese di condivisione video TikTok è diventata virale a causa delle polemiche sulla privacy degli utenti. Oltre alla censura, recentemente TikTok ha ammesso che il suo personale in Cina può accedere ai dati degli utenti in altri Paesi. TikTok nega di fornire dati al governo cinese, ma le aziende nazionali sono obbligate a divulgare le informazioni alle autorità in base alla legge sulla sicurezza dello Stato.

La crescente importanza dei big data accelera l’intervento delle autorità, il controllo e l’integrazione più profonda con i giganti del web, poiché le informazioni personali sono visti come un asset strategico per il controllo sociale. App di messaggistica istantanea come WeChat sono uno strumento perfetto per la sorveglianza e il controllo della popolazione.

I big data possono diventare però una minaccia quando sono controllati dai nemici della leadership. In questo caso le compagnie tecnologiche finiscono per essere coinvolte nelle lotte di potere per il controllo del Partito Comunista cinese.

Secondo diversi media stranieri, il vice presidente di WeChat Zhang Feng è stato arrestato per aver condiviso le informazioni degli utenti con Sun Lijun, un vice ministro della Pubblica sicurezza rimosso poi da Xi Jinping. Sun è stato accusato di «coltivare il potere personale e di formare un gruppo di interesse» all’interno dell’organo anti-frode del Partito. Sun avrebbe chiesto a WeChat informazioni sui suoi colleghi politici.

I vertici del regime sono vigili anche su un progetto incompiuto di WeChat che utilizza la scienza dei dati per prevedere chi saranno i nuovi membri del Politburo, l’organo decisionale del Partito.

Invitiamo i lettori di Renovatio 21 a sostenere con una donazione AsiaNews e le sue campagne.

Renovatio 21 offre questo articolo per dare una informazione a 360º. Ricordiamo che non tutto ciò che viene pubblicato sul sito di Renovatio 21 corrisponde alle nostre posizioni

Algoritmi

Come combattere il transumanesimo e proteggere la tua privacy

Renovatio 21 traduce questo articolo per gentile concessione di Children’s Health Defense.

I transumanisti non devono mettere un microchip nel braccio per ottenere il controllo, alterano già la realtà e fanno il lavaggio del cervello alla popolazione attraverso la raccolta di dati e la manipolazione delle informazioni. Puoi contribuire a proteggere la tua privacy e combattere il movimento del transumanesimo evitando tutti i prodotti Google.

La nozione di transumanesimo è attivamente ricercata ed esplorata, mentre a un certo livello è già qui.

Molte persone considerano il transumanesimo come la trasformazione degli esseri umani in robot, ma in realtà descrive un movimento sociale e filosofico che coinvolge lo sviluppo di tecnologie di miglioramento umano.

Nell’episodio 26 di Children’s Health Defense Tea Time, ho parlato con Polly Tommey, direttrice della programmazione per CHD-TV, e colleghi dell’agenda transumanista e di come il suo obiettivo finale sia controllare la popolazione umana.

Il processo è stato accelerato dalla pandemia di COVID e negli ultimi due anni la cabala globale è riuscita a influenzare il comportamento, principalmente attraverso la paura e la creazione di narrazioni.

La maggior parte delle persone non apprezza il fatto di essere sorvegliata 24 ore su 24, 7 giorni su 7, e la maggior parte della sorveglianza che stai consentendo nella tua vita e causa tua, poiché rinunci alla tua privacy e acconsenti alla sorveglianza in cambio di comodità.

Google è il principale colpevole, e ha un controllo e un’influenza maggiori poiché, a livello mondiale, il 93% delle ricerche effettuate online utilizza Google. È il più grande monopolio nella storia del mondo.

Stanno acquisendo i tuoi dati e influenzando la tua mente

In futuro, è possibile che il transumanesimo utilizzi tecnologie che sono fisicamente incorporate nel corpo umano o nel cervello per offrire cognizione sovrumana o forme di controllo mentale.

Tuttavia, in questo momento il transumanesimo sta già avvenendo, non da un dispositivo impiantabile, ma attraverso la psicosi di formazione di massa e la manipolazione dell’informazione.

Un esempio chiave è il termine «psicosi da formazione di massa», che il dottor Robert Malone, inventore della tecnologia della piattaforma di base del vaccino mRNA e DNA, ha menzionato in un episodio di The Joe Rogan Experience il 31 dicembre 2021. L’episodio è stato visto da più di 50 milioni di persone.

Il 2 gennaio, la psicosi di formazione di massa ha raggiunto un valore di 100 su Google Trends, il che significa che aveva raggiunto il picco di popolarità, dopo essere stata praticamente sconosciuta in precedenza.

I tecnocrati sono subito intervenuti, manipolando i risultati di ricerca e popolando Google di propaganda per screditare Malone e la teoria della psicosi della formazione di massa, anche se Mattias Desmet, professore di psicologia clinica all’Università di Gand in Belgio, che ha 126 pubblicazioni a suo nome, studia il fenomeno da molti anni, e afferma che il fenomeno in realtà risale a oltre 100 anni fa.

Quelli sotto l’incantesimo della psicosi di formazione di massa si concentrano ossessivamente su un fallimento del mondo normale o su un evento o persona particolare – in questo caso, COVID – che diventa il fulcro dell’attenzione e può controllare efficacemente le masse.

Il fenomeno porta al pensiero totalitario e, alla fine, agli stati totalitari, ed è chiaro che Google non voleva che tu lo sapessi.

Google si infiltra nella tua casa

A causa del suo monopolio, Google controlla ciò che vedi manipolando i risultati di ricerca e censurando i siti web o etichettandoli come «disinformazione».

Se vuoi scoprire come mantenerti veramente in salute, ad esempio, le informazioni esistono su Internet – ci sono – ma non sarai in grado di trovarle facilmente se non sai dove cercare a causa del modo in cui Google controlla le informazioni.

Manipolando le informazioni, possono modellare e alterare la realtà su qualsiasi argomento, dal COVID all’Ucraina, per adattarsi alla loro agenda.

Non è solo il motore di ricerca di Google a monitorare ciò che fai, ma anche il tuo browser.

Il browser Google Chrome tiene traccia di tutto ciò che fai online, mentre Gmail cattura ogni carattere digitato e lo salva sui suoi server a tempo indeterminato.

Se utilizzi altoparlanti intelligenti in casa, come gli altoparlanti intelligenti Alexa e Google Home o l’app per smartphone Google Assistant, è possibile che delle persone ascoltino le tue richieste e che ascoltino anche quando non ti aspetteresti. Anche i termostati intelligenti possono avere dei microfoni.

Hai mai avuto una conversazione telefonica con qualcuno e poi nell’ora o nel giorno successivo hai iniziato a ricevere annunci relativi a qualcosa di cui hai parlato?

Questo è un potente esempio della quantità di dati che stanno raccogliendo su di te e di come lo stanno usando per controllare e manipolare il tuo comportamento. Non hanno bisogno di un dispositivo transumanista futuristico per entrare e manipolare il tuo cervello: lo stanno già facendo senza di esso.

«Hackerare gli organismi» per riprogettare la vita stessa

L’inizio del video di CHD presenta il transumanista Yuval Noah Harari, professore all’Università Ebraica di Gerusalemme e uno dei massimi consiglieri di Klaus Schwab, proprietario e presidente del World Economic Forum (WEF).

È importante essere consapevoli del fatto che Schwab, WEF e Harari parlano apertamente del transumanesimo come parte del Great Reset, e Harari ammette che i dati potrebbero consentire alle élite umane di fare di più che «costruire semplicemente dittature digitali».

«Hackerando gli organismi – ha detto Harari –le élite possono ottenere il potere di riprogettare il futuro della vita stessa perché una volta che puoi hackerare qualcosa, di solito puoi anche progettarlo». Presto, dice, alcune società e governi saranno in grado di «hackerare sistematicamente tutte le persone». E, se riescono a hackerare la vita, sarebbe la «più grande rivoluzione in biologia dall’inizio della vita 4 miliardi di anni fa».

«Per 4 miliardi di anni non è cambiato nulla di fondamentale. La scienza sta sostituendo l’evoluzione con la selezione naturale con l’evoluzione con un design intelligente. Non il design intelligente di qualche dio sopra le nuvole, ma il nostro design intelligente e il design intelligente delle nostre nuvole cloud — il cloud IBM, il cloud Microsoft — queste sono le nuove forze trainanti dell’evoluzione».

Una volta che la vita umana viene hackerata, gli hacker manterranno il controllo sulla vita stessa, un processo che è stato accelerato dalla pandemia. Dopotutto, Harari ha detto: «Si dice spesso che non dovresti mai lasciare che una buona crisi vada sprecata».

La sorveglianza è una parte fondamentale del piano per il controllo totalitario globale e Harari afferma che tra 100 anni le persone saranno in grado di guardare indietro e identificare la pandemia di COVID come il momento in cui un nuovo regime di sorveglianza ha preso il sopravvento – «soprattutto la sorveglianza sotto la pelle».

Anche se un impianto cervello-computer ha recentemente consentito a un uomo completamente paralizzato di comunicare con la famiglia e i medici con i suoi pensieri, non credo che la tecnologia sia avanzata al punto che i microchip impiantabili vengano utilizzati come interfacce cervello-macchina per controllare i tuoi pensieri .

Ma ciò che esiste oggi sono i passaporti per i vaccini, che possono passare a ID digitali, che poi portano alle valute digitali della banca centrale (CBDC), la fine del gioco.

Le CBDC sembrano essere inevitabili; non è una questione di se li avranno, ma quando. Una volta che le CBDC si saranno diffuse, saranno in grado di controllare tutto, poiché sarà difficile sopravvivere senza di loro.

Non devono mettere un microchip nel tuo braccio per ottenere questo controllo incommensurabile: saranno in grado di tracciare e controllare ogni tua mossa tramite CBDC.

L’ottimizzazione della tua salute è una delle misure migliori che hai per sviluppare la tua resilienza personale contro qualsiasi nuova minaccia possa presentarsi.

Nel video ho delineato tre priorità principali, che includono:

1) Evita gli oli di semi nella tua dieta: gli oli di semi, che sono spesso indicati come oli vegetali, sono nascosti praticamente in ogni alimento trasformato, compresi i cibi dei ristoranti, a meno che tu non possa confermare che lo chef sta cucinando solo con il burro.

Non c’è praticamente niente di più distruttivo per il tuo corpo che produrre malattie cardiache, cancro, degenerazione maculare legata all’età, diabete, obesità e demenza.

Anche se elimini gli alimenti trasformati e altri importanti perpetratori dell’olio di semi come salse e condimenti per insalata nei ristoranti, puoi comunque essere colpito da queste tossine perniciose perché sono nascoste in cibi apparentemente «sani» come pollo e maiale.

Questi animali vengono nutriti con cereali carichi di acido grasso linoleico omega-6, che si trova nella maggior parte degli oli di semi e provoca danni alla salute se consumato ai livelli eccessivi che sono comuni oggi.

Molte persone mangiano un sacco di pollo perché è percepito come un alimento salutare ed è poco costoso, ma è una delle principali fonti di acido linoleico. Nella tua cucina, esempi di grassi sani da usare al posto degli oli di semi sono il sego di manzo, il burro o l’olio di cocco.

2) Evita il sovraccarico di ferro: se sei un maschio o una donna in postmenopausa, il sovraccarico di ferro può mettere a rischio la tua salute. Essendo un potente ossidante, il ferro può danneggiare i tessuti e compromettere la funzione mitocondriale. Il tuo corpo ha una capacità limitata di espellere il ferro, che gli consente di accumularsi nei tuoi organi, inclusi cuore, fegato e pancreas.

Gli uomini e le donne in postmenopausa possono ridurre il rischio di sovraccarico di ferro donando sangue due o tre volte l’anno. È un rimedio efficace ed economico che aiuterà anche gli altri.

3. Esporsi regolarmente al sole: stare all’aperto al sole, esponendo quanto più possibile la pelle nuda, è il modo migliore per garantire che i livelli di vitamina D siano ottimizzati.

L’esposizione al sole aumenta anche la forma attiva della vitamina A insieme alla melatonina mitocondriale, un antiossidante profondamente importante all’interno dei mitocondri che riduce lo stress ossidativo.

De-Googla te stesso

Non devi essere su Google.com per rischiare la tua privacy ed essere sorvegliato. È molto più dannoso di così, poiché i tuoi dati possono essere acquisiti mentre, ad esempio, stai parlando al telefono.

Le app possono tracciare e raccogliere i tuoi dati, che vengono quindi utilizzati essenzialmente per farti il lavaggio del cervello.

È possibile de-Googlare il tuo cellulare acquistando un telefono Android che non ha un sistema operativo Google, ma dovrai trovare un esperto IT in grado di riformattare il disco rigido del tuo cellulare.

Puoi contribuire ulteriormente a proteggere la tua privacy e combattere il movimento del transumanesimo evitando tutti i prodotti Google.

Ciò comprende:

- Smetti di usare i motori di ricerca di Google. Prova invece il motore di ricerca Brave.

- Disinstalla Google Chrome e utilizza invece il browser Brave, disponibile per tutti i computer e dispositivi mobili. Blocca gli annunci e protegge la tua privacy.

- Se disponi di un account Gmail, prova invece un servizio di posta elettronica non Google come ProtonMail, un servizio di posta crittografato con sede in Svizzera.

- Smetti di usare Google Docs.

- Se sei uno studente delle superiori, non convertire gli account Google che hai creato come studente in account personali.

Joseph Mercola

Pubblicato originariamente da Mercola.

Renovatio 21 offre questa traduzione per dare una informazione a 360º. Ricordiamo che non tutto ciò che viene pubblicato sul sito di Renovatio 21 corrisponde alle nostre posizioni.

-

Pensiero2 settimane fa

Pensiero2 settimane faLa giovenca rossa dell’anticristo è arrivata a Gerusalemme

-

Cervello1 settimana fa

Cervello1 settimana fa«La proteina spike è un’arma biologica contro il cervello». Il COVID come guerra alla mente umana, riprogrammata in «modalità zombie»

-

Salute2 settimane fa

Salute2 settimane faI malori della 15ª settimana 2024

-

Salute6 giorni fa

Salute6 giorni faI malori della 16ª settimana 2024

-

Pensiero1 settimana fa

Pensiero1 settimana faForeign Fighter USA dal fronte ucraino trovato armato in Piazza San Pietro. Perché?

-

Animali2 settimane fa

Animali2 settimane fa«Cicala-geddon»: in arrivo trilioni di cicale zombie ipersessuali e forse «trans» infettate da funghi-malattie veneree

-

Spirito2 settimane fa

Spirito2 settimane faSinodo 2024, grandi manovre in favore dell’ordinazione delle donne

-

Vaccini2 settimane fa

Vaccini2 settimane faVaccino mRNA sviluppato in 100 giorni, professore di medicina avverte: «possibile solo ignorando i diritti umani»