Intelligenza Artificiale

Il Pentagono potrebbe punire l’IA Anthropic per essersi rifiutato di modificare il codice etico

Il dipartimento della Guerra degli Stati Uniti è prossimo a interrompere i rapporti con Anthropic, principale partner nel settore dell’intelligenza artificiale e sviluppatore del modello Claude, designandolo come un rischio per la filiera della fornitura americana. Lo riporta Axios, citando un funzionario del Pentagono. Tale classificazione è solitamente riservata a entità legate a stati considerati da Washington come avversari stranieri.

Secondo le informazioni riportate, il laboratorio con sede a San Francisco è in contrasto da mesi con il governo statunitense a causa della sua politica che restringe l’uso militare della propria tecnologia. Mentre il Pentagono ha insistito affinché l’azienda permettesse l’impiego di Claude per «tutti gli scopi legittimi», il protocollo etico di Anthropic vieta che la sua tecnologia venga usata per «facilitare la violenza, sviluppare armi o condurre attività di sorveglianza».

«Sarà una vera rottura di scatole districarci e faremo in modo che paghino il prezzo per averci forzato la mano in questo modo», ha dichiarato ad Axios un funzionario del Pentagono rimasto anonimo.

Claude rappresenta attualmente l’unico modello di AI in uso sulle piattaforme classificate dell’esercito, grazie a una collaborazione con Palantir Technologies, colosso del software di analisi e sorveglianza finanziato da Peter Thiel, venture capitalist ora molto discusso per le sue visioni sul futuro e sull’anticristo nonché per i suoi legami con la politica, in particolare con il vicepresidente JD Vance che fu suo dipendente in Silicon Valley.

Un eventuale inserimento nella lista nera obbligherebbe i contractor del Pentagono a dimostrare di non impiegare la tecnologia di Anthropic, con il rischio di perdere i contratti in caso contrario.

Il portavoce del Pentagono Sean Parnell ha affermato ad Axios che il rapporto tra il dipartimento e Anthropic «è in fase di revisione».

Sostieni Renovatio 21

«Tutti i partner del Pentagono devono essere disposti ad aiutare i nostri combattenti a vincere qualsiasi battaglia», ha aggiunto Parnell. Un portavoce di Anthropic ha dichiarato alla testata che l’azienda ha avuto «conversazioni produttive» con il dipartimento.

Lo scontro emerso segue alle accuse secondo cui il modello di Intelligenza Artificiale dell’azienda sarebbe stato utilizzato durante l’operazione per rapire il presidente venezuelano Nicolas Maduro all’inizio di gennaio.

La scorsa settimana, Axios e il Wall Street Journal hanno riferito che Claude è stato impiegato sia per organizzare il raid sia per portarlo a termine, sebbene il suo ruolo preciso resti poco chiaro. Le accuse sono emerse dopo che l’azienda ha trascorso settimane a promuovere le proprie politiche di sicurezza e a presentarsi come l’opzione più attenta alla sicurezza nell’ambito dell’intelligenza artificiale.

Come riportato da Renovatio 21, negli ultimi mesi vi è stato un progressivo deterioramento dei rapporti tra Anthropic e il Pentagono, legato alla volontà del dipartimento della Guerra statunitense di utilizzare l’IA per il controllo di armi autonome senza le garanzie di sicurezza che l’azienda ha cercato di imporre.

Il CEO di Anthropic, Dario Amodei, ha più volte espresso gravi preoccupazioni sui rischi della tecnologia che la sua azienda sta sviluppando e commercializzando. In un lungo saggio di quasi 20.000 parole pubblicato il mese scorso, ha avvertito che sistemi AI dotati di «potenza quasi inimmaginabile» sono «imminenti» e metteranno alla prova «la nostra identità come specie».

Amodei ha messo in guardia dai «rischi di autonomia», in cui l’IA potrebbe sfuggire al controllo e sopraffare l’umanità, e ha ipotizzato che la tecnologia potrebbe facilitare l’instaurazione di «una dittatura totalitaria globale» attraverso sorveglianza di massa basata sull’Intelligenza Artificiale e l’impiego di armi autonome.

Come riportato da Renovatio 21, l’anno passato l’Amodei ha dichiarato che l’AI potrebbe eliminare la metà di tutti i posti di lavoro impiegatizi di livello base entro i prossimi cinque anni.

La scorsa settimana Mrinank Sharma, l fino a poco tempo fa responsabile del Safeguards Research Team presso l’azienda sviluppatrice del chatbot Claude, ha pubblicato su X la sua lettera di dimissioni, in cui scrive che «il mondo è in pericolo. E non solo per via dell’Intelligenza Artificiale o delle armi biologiche, ma a causa di un insieme di crisi interconnesse che si stanno verificando proprio ora».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

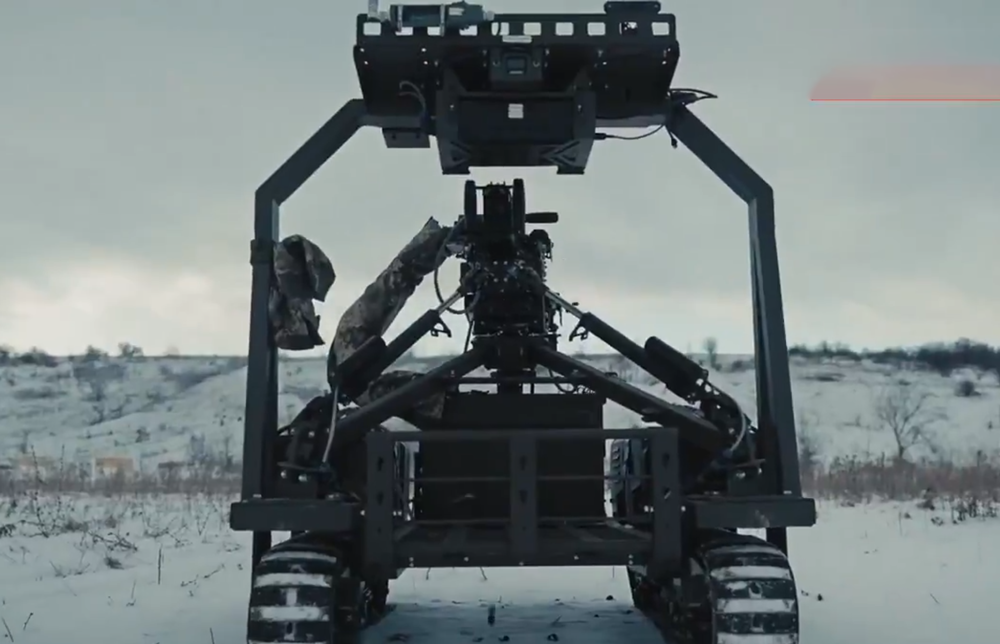

L’Ucraina impiega un numero record di 7.000 missioni robotiche contro la Russia in un solo mese

Proof that remote unmanned robots can now hold infantry positions indefinitely. TWW127, a Ukrainian robot, sat on position alone for 45 days and did not budge. Daily forward overwatch at contested sector, suppressive fire halting enemy advances.pic.twitter.com/iFuALEp32j

— Rohan Paul (@rohanpaul_ai) March 30, 2026

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

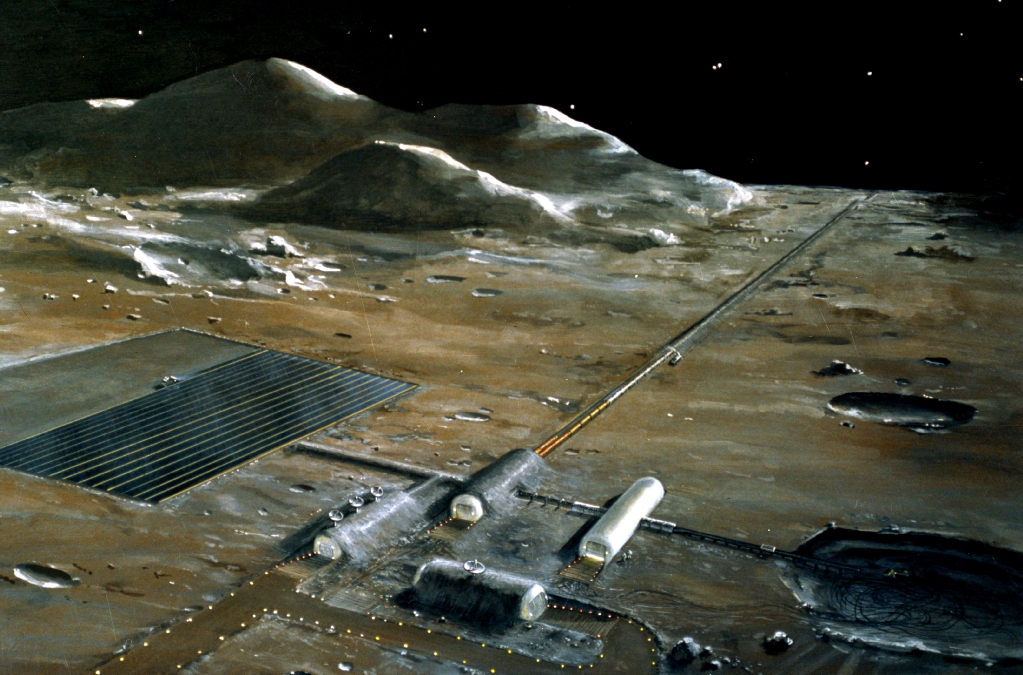

Elon Musk parla di mass driver sulla Luna

Durante una presentazione tenutasi nel fine settimana al Giga Texas, il miliardario del settore tecnologico ha svelato il Progetto TERAFAB, un piano per trasferire sulla superficie lunare l’infrastruttura di Intelligenza Artificiale più energivora del mondo.

L’obiettivo è quello di infrangere il «soffitto di terawatt» dell’informatica terrestre e inaugurare un’era di intelligenza su scala petawatt. L’ultima visione di Musk prevede di superare i limiti energetici della Terra costruendo sulla Luna dei mass driver, cioè delle rampe di lancio elettromagnetiche per facilitare questa infrastruttura AI su vasta scala.

Secondo il pensiero di Musk la Terra ha meno spazio e meno energia per progetti di IA su larga scala. Per costruire una rete di Intelligenza Artificiale di grandi dimensioni, gli esperti intendono sfruttare lo spazio e l’energia illimitati della Luna. I pannelli solari nello spazio sono circa cinque volte più efficienti di quelli sulla Terra, dove le nuvole e una spessa atmosfera ne riducono l’efficienza.

Mass drivers on the Moon will be awesome 😎 https://t.co/34aPjVGesn

— Elon Musk (@elonmusk) March 24, 2026

Sostieni Renovatio 21

Anziché utilizzare un maggior numero di razzi, il piano si basa sull’azione del mass driver, un gigantesco binario elettromagnetico per lanciare i satelliti nello spazio sfruttando l’energia solare. Tali sistemi di propulsione, che potrebbero estendersi per decine di chilometri, utilizzerebbero campi magnetici per accelerare i satelliti dotati di Intelligenza Artificiale fino alla velocità di fuga lunare.

In particolare, questa strategia elimina la necessità di propellenti chimici costosi e volatili, nonché degli stadi di razzo dismessi che ingombrano gli oceani della Terra. Il piano potrebbe utilizzare la Starship di SpaceX per trasportare l’hardware iniziale, arrivando infine a creare una rete orbitale distribuita in grado di fornire una potenza 1.000 volte superiore a quella dei sistemi attuali.

Mass drivers on the moon will be installed by Optimus. pic.twitter.com/PgtzhmeuFh

— Gary Mark⚡️Blue Sky Kites 𝕏 🈴 (@blueskykites) March 24, 2026

Se coronato da successo, il dispiegamento di infrastrutture di IA nello spazio ridurrebbe la competizione tra data center e città per l’energia terrestre, consentendo alle operazioni di AI avanzata di espandersi nel vasto e illimitato ambiente energetico della Luna.

Sebbene il concetto di un cannone spaziale magnetico esista da quando Edward Fitch Northrup lo teorizzò per la prima volta nel 1937, rimane puramente teorico, non avendo ancora superato la fase di progettazione né raggiunto la superficie lunare.

La proposta di Musk per un propulsore lunare è una componente chiave di un più ampio cambiamento strategico annunciato nel febbraio 2026, in cui SpaceX ha dato priorità a una città lunare «autosufficiente» rispetto alla colonizzazione immediata di Marte. Sebbene Marte rimanga la «polizza assicurativa» a lungo termine dell’umanità come secondo pianeta da essa abitato po essere stato colonizzato o «terraformato», la Luna costituirebbe ora ora la priorità industriale immediata.

Dal punto di vista logistico, la Luna offre finestre di lancio ogni 10 giorni, rispetto ai 26 mesi di attesa necessari per Marte. Gli scettici, tuttavia, stanno già facendo notare i calcoli impressionanti. I critici sostengono che per lanciare oltre un milione di tonnellate di materiale necessario a raggiungere un petawatt di potenza sarebbero necessari circa 135 lanci di Starship al giorno.

«Spingeremo al limite le leggi della fisica nel campo dell’informatica e faremo cose folli e incredibili», ha detto Musk. «Voglio vivere abbastanza a lungo da vedere il lanciatore di massa sulla Luna», ha aggiunto.

L’altra ambiziosa visione di Musk è quella di realizzare una fabbrica lunare che utilizzi la robotica per produrre satelliti dotati di IA e alimentati a energia solare, che verrebbero poi lanciati in una rete orbitale distribuita tramite la porpulsione elettromagnetica del mass driver.

Sono in fase di valutazione due progetti principali: i cannoni a rotaia, che utilizzano un singolo e potente impulso di forza, e i cannoni a bobina, che impiegano una sequenza di magneti temporizzati per fornire un’accelerazione costante e controllata. Quest’ultimo sembra essere la scelta preferibile per la protezione di carichi sensibili di Intelligenza Artificiale.

La storia dei mass driver (o catapulte elettromagnetiche) affonda le radici nella fantascienza e nella fisica applicata. Il primo concetto ingegneristico appare nel 1937 nel romanzo Zero to Eighty del fisico princetoniano Edwin Fitch Northrup (pubblicato con il nom de plume Akkad Pseudoman), che descrisse e costruì prototipi di «electric guns» basati su bobine.

L’idea moderna nasce nel 1974 grazie ad un ulteriore fisico princetoniano, il teorico delle colonie spaziali orbitanti Gerard K. O’Neill, che propose appunto i mass driver per lanciare materiali dalla Luna verso i punti di Lagrange (soprattutto L5), dove costruire grandi habitat spaziali – i cosiddetti «cilindri di O’Neill» visibili nella pellicola 2001 Odissea nello Spazio o nelle serie di anime Gundam – senza dover usare costosi razzi chimici. L’obiettivo era sfruttare le risorse lunari per costruire industrie e colonie nello spazio, riducendo drasticamente i costi di lancio.

Aiuta Renovatio 21

Nel 1976-1977, durante un anno sabbatico al MIT, lo O’Neill insieme a Henry Kolm e studenti costruì il Mass Driver 1 con un budget di soli 2000 dollari, usando materiali di recupero. Il prototipo, lungo pochi metri, accelerava proiettili a 40 m/s con 33 g di accelerazione. Fu dimostrato con successo alla conferenza di Princeton nel maggio 1977, attirando l’attenzione della stampa statunitense.

Negli anni successivi vennero realizzati prototipi più avanzati (Mass Driver 2) grazie a finanziamenti NASA e del Space Studies Institute fondato da O’Neill. Gli studi degli anni Settanta, inclusi quelli estivi della NASA Ames, esplorarono applicazioni per il lancio di materie prime lunari a velocità orbitali.

Oggi i mass driver restano un concetto affascinante per lanci spaziali economici, specialmente sulla Luna o su asteroidi, ma non sono ancora stati realizzati a scala operativa. Influenzano ricerche sulle catapulte elettromagnetiche per aerei militarie futuri sistemi di lancio non basati su razzi, rappresentando una delle colonne portanti della visione di industrializzazione spaziale degli anni Settanta, ancora attuale nel dibattito su colonie lunari e marziane.

In un post del 2025, il Musk – che porta innanzi da anni la causa della costruzione di lanciatori di massa sul nostro satellite – si è spinto a dire che «quando il mass driver sulla Luna entrerà in funzione, non sono sicuro che il denaro sarà rilevante»

Immagine di pubblico dominio CC0 via Wikimedia

Intelligenza Artificiale

Un tribunale statunitense si pronuncia contro il Pentagono nella controversia sull’Intelligenza Artificiale letale

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

-

Vaccini2 settimane fa

Vaccini2 settimane faProposte di legge USA per definire i vaccini a mRNA contro il COVID «armi di distruzione di massa»

-

Pensiero1 settimana fa

Pensiero1 settimana faPizzaballa incontra il privilegio israeliano. Aspettando il Golem e l’Anticristo

-

Spirito2 settimane fa

Spirito2 settimane faMons. Viganò, la Chiesa e l’intronizzazione dell’«arcivescova» anglicana: «Leone abbraccia l’eresia ecumenista»

-

Economia2 settimane fa

Economia2 settimane faLa guerra in Iran e la rinazionalizzazione dell’industria italiana. Intervista al prof. Pagliaro

-

Salute1 settimana fa

Salute1 settimana faI malori della 13ª settimana 2026

-

Eutanasia1 settimana fa

Eutanasia1 settimana faEutanatizzata dopo essere stata vittima di stupro di gruppo: ecco l’Europa moderna

-

Spirito2 settimane fa

Spirito2 settimane faMiss California contro il vescovo

-

Arte1 settimana fa

Arte1 settimana faL’Iran sta facendo propaganda con fantasiosi video AI