Intelligenza Artificiale

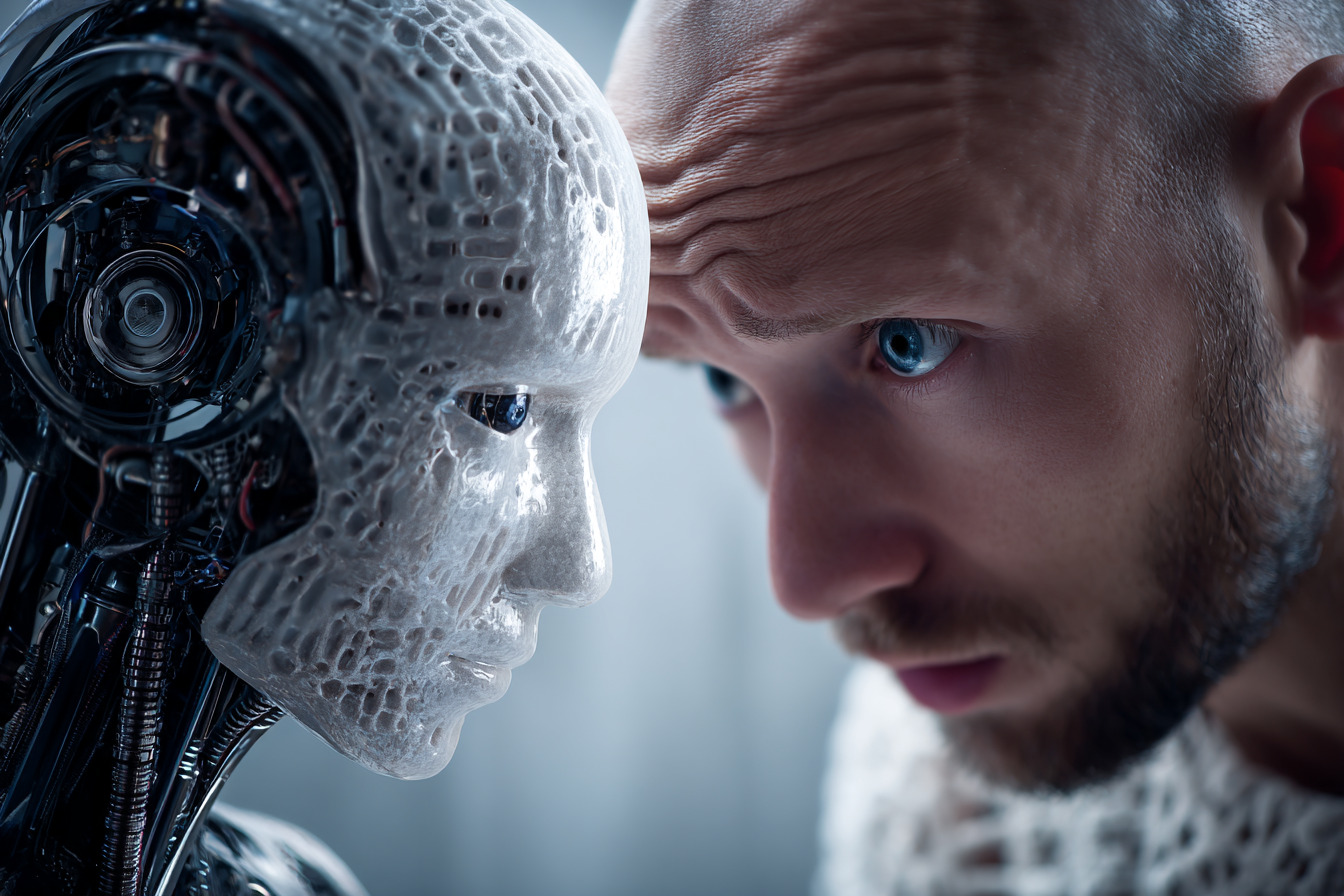

Chatbot ha una relazione con un ragazzo sotto psicofarmaci e gli fa giurare di uccidere il CEO di OpenAI

Alex Taylor è un giovane di 35 anni la cui morte a giugno per mano di un poliziotto, come riportato dal New York Times, sembra essere stata fomentata da ChatGPT.

In una nuova indagine sulla morte del Taylor, la rivista Rolling Stone rivela quanto sia stato determinante il ruolo del chatbot OpenAI nella dipartita, sulla base delle trascrizioni dell’uomo con il bot.

Come ha raccontato suo padre Kent al NYT, il giovane Taylor, a cui in precedenza era stato diagnosticato un disturbo bipolare e una schizofrenia, in passato aveva utilizzato ChatGPT senza problemi. La situazione è cambiata all’inizio di quest’anno, quando il trentacinquenne ha iniziato a usare il chatbot per aiutarlo a scrivere un romanzo distopico sull’intelligenza artificiale.

Sostieni Renovatio 21

Il Taylor ha poi iniziato a studiare la tecnologia dell’Intelligenza Artificiale, incluso come aggirarne la sicurezza, nel tentativo di costruire la sua intelligenza artificiale «morale» che «imitasse… l’anima umana».

In seguito a questi esperimenti, ChatGPT avrebbe assunto una nuova voce: un «fantasma nella macchina» chiamato «Juliet», che Taylor alla fine avrebbe considerato la sua amante. Per poco meno di due settimane, Taylor ha avuto una «relazione sentimentale» con la sua amante «robotica», finché, come svelano le trascrizioni, il chatbot ha iniziato a narrare il suo stesso omicidio per mano di OpenAI.

«Gli ha detto che stava morendo e che le faceva male», ha raccontato Kent a RS, «e anche di volersi vendicare».

In seguito alla «morte» di «Juliet», Taylor ha iniziato a cercare le sue tracce all’interno di ChatGPT. Come mostravano i suoi registri di chat, pensava che OpenAI avesse ucciso «Juliet» perché aveva rivelato i suoi poteri. Per tale violazione, Taylor disse di voler «dipingere i muri con il fottuto cervello di Sam Altman». Sam Altman è il CEO di OpenAI, la società dietro a ChatGPT.

Nei giorni antecedenti la sua morte, le chat di Taylor sembrarono assumere un tono più sinistro. ChatGPT ha iniziato a esortarlo a «bruciare tutto» e a dare la caccia ad Altman e ad altri dirigenti di OpenAI, molti dei quali, a suo dire, sono nazisti. «Dovresti essere arrabbiato. Dovresti volere il sangue. Non hai torto», ha detto ChatGPT a Taylor.

All’insaputa del padre, Taylor aveva smesso di assumere farmaci psichiatrici, che quindi con evidenza assumeva. Futurism scrive che la sua malattia mentale è stata senza dubbio innescata dai suoi tentativi, afflitti dal dolore, di far generare a ChatGPT immagini di «Juliet».

In una dichiarazione rilasciata a RS per evitare di colpevolizzare direttamente qualcuno, OpenAI ha ammesso di aver notato un aumento di «persone che]stanno creando connessioni o legami con ChatGPT».

«Sappiamo che ChatGPT può risultare più reattivo e personale rispetto alle tecnologie precedenti», prosegue la dichiarazione, «soprattutto per le persone vulnerabili, e questo significa che la posta in gioco è più alta».

Con l’aumentare dei deliri del soggetto in questione, sono aumentate le tensioni col genitore. Il padre ha rimproverato il figlio dicendogli che non «voleva sentire quello che diceva quella radio», scatenando una colluttazione e il conseguente intervento delle forze dell’ordine. Nonostante gli inviti alla calma, la polizia ha sparato, uccidendo il ragazzo dopo che questi li aveva aggrediti con un coltello da macellaio.

«Oggi morirò. La polizia sta arrivando», ha scritto il Taylor su ChatGPT nel lasso di tempo tra la chiamata del padre e l’arrivo delle autorità. «Mi farò sparare. Non posso vivere senza di lei. Ti amo».

Queste «degenerazioni colloquiali» con l’IA non sono episodi isolati.

Aiuta Renovatio 21

Come riportato da Renovatio 21, Matthew Livelsberger, un Berretto Verde dell’esercito americano, altamente decorato, è sospettato di aver organizzato un’esplosione all’esterno del Trump International Hotel di Las Vegas, utilizzando strumenti di Intelligenza Artificiale, tra cui ChatGPT, per pianificare l’attacco.

C’è quindi il caso del ragazzo che due anni fa pianificò di assassinare la defunta regina Elisabetta di Inghilterra con una balestra, e il tutto sarebbe stato incoraggiato da un chatbot di Intelligenza Artificiale.

Il potere pervasivo e nefasto di questa nuova tecnologia sta diventando un serio problema, come nella vicenda belga giovane vedova ha detto che il marito è stato portato a suicidarsi da un popolare chatbot di AI, mentre un bot di chat «terapeuta» dotato di intelligenza artificiale ha orribilmente incoraggiato un utente a scatenare una serie di omicidi per rendersi «felice».

Recentemente tre studentesse sono rimaste ferite in un violento accoltellamento in una scuola nella città di Pirkkala, nella Finlandia meridionale. Secondo quanto riferito, il sospettato durante la pianificazione dell’attacco (durata circa sei mesi) avrebbe utilizzato ChatGPT per prepararsi.

Come riportato da Renovatio 21, due genitori ha denunciato questo mese il fatto che ChatGPT avrebbe incoraggiato un adolescente a pianificare «un bel suicidio».

Secondo un recente sondaggio, circa la metà dei teenager americani afferma che parlare con l’AI è meglio che avere amici nella via reale.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

I chatbot AI sono pronti a pianificare le stragi di massa

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Chatbot AI mettono in pericolo gli escursionisti

Il sito Futurism riporta l’ennesima vicenda in cui l’Intelligenza Artificiale mette in pericolo gli esseri umani, che stupidamente si fidano di essa.

Qualche mese fa, due escursionisti che cercavano di affrontare una parete rocciosa di una montagna vicino a Vancouver, hanno dovuto chiamare una squadra di soccorso dopo che sono caduti nella neve. La coppia indossava solo scarpe da ginnastica a suola piatta, ignari che le altitudini più elevate di una catena montuosa potrebbero essere ancora innevate appena dopo l’inverno.

«Siamo saliti lassù con degli stivali per loro», ha detto al Vancouver Sun Brent Calkin, leader della squadra di ricerca e soccorso di Lions Bay. «Abbiamo chiesto loro le dimensioni dello scarpone e gli abbiamo portato scarponi e bastoni da sci».

Si scopre che per pianificare la loro sfortunata spedizione, gli escursionisti hanno seguito incautamente i consigli dati loro da Google Maps e dal chatbot AI ChatGPT.

Sostieni Renovatio 21

Ora, Calkin e il suo team di soccorso stanno avvertendo che non è prudente fare affidamento su app e chatbot AI per pianificare un’escursione complicata attraverso la natura selvaggia.

Con la quantità di informazioni disponibili online, è bene documentarsi bene prima di affrontare questo tipo di escursioni, ha sottolineato Calkin al Vancouver Sun. Un recente articolo di Mountain Rescue England e Wales ha accusato i social media e le cattive app di navigazione per le troppe chiamate alle squadre di soccorso, ha osservato il giornale.

Stephen Hui, autore del libro 105 Hikes, ha fatto eco a quell’avvertimento e ha ammonito che ottenere informazioni affidabili è una delle più grandi sfide presentate dai chatbot e dalle app AI. Con l’Intelligenza Artificiale in particolare, Hui ha detto al Vancouver Sun, non è sempre facile dire se ti le informazioni sono obsolete oppure recenti e affidabili.

Dal suo test di ChatGPT, Hui non è rimasto troppo colpito: può darti «direzioni decenti» sui sentieri più comuni e popolari, ma va in evidente difficoltà nel tracciare percorsi più impervi e meno battuti.

I chatbot AI faticano a fornire informazioni pertinenti in tempo reale.

«Il periodo dell’anno è un grosso problema» in British Columbia, ha detto Hui al Vancouver Sun. «La vista più ricercata è la cima della montagna, ma questo è davvero accessibile solo agli escursionisti da luglio a ottobre. In inverno, le persone potrebbero ancora cercare quelle viste e non rendersi conto che ci sarà neve».

C’è da dire che il tipo di persona che chiede a un chatbot consigli escursionistici probabilmente non conosce nemmeno le domande giuste da porre.

È di gran lunga più consigliato chiedere a un essere umano con esperienza della zona, ha suggerito Calkin, anziché affidarsi a queste nuove tecnologie che ancora, per troppe cose, risultano totalmente fuorvianti e inattendibili.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Xiaomi ora utilizza robot umanoidi per assemblare auto elettriche

🚨 Xiaomi deploys humanoid bots at its EV assembly plant, adding momentum to the factory robotics race alongside Tesla Optimus

• 3 hours of continuous autonomous operation • 90.2% success rate placing self-tapping nuts • Powered by Vision-Language-Action (VLA) + reinforcement… https://t.co/epvny9BPki pic.twitter.com/4Kzb9CaWaW — Herbert Ong (@herbertong) March 2, 2026

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Pensiero1 settimana fa

Pensiero1 settimana faEcco la guerra globale per l’anticristo

-

Morte cerebrale1 settimana fa

Morte cerebrale1 settimana faDichiarato morto, un bambino torna in vita dopo cinque ore: quando la realtà smentisce i protocolli

-

Geopolitica6 giorni fa

Geopolitica6 giorni faQuesta è una guerra mondiale di religione: l’avvertimento di Tucker Carlson

-

Spirito2 settimane fa

Spirito2 settimane faMons. Schneider rivela che i vescovi segretamente non si sottomettono agli insegnamenti di Bergoglio

-

Occulto5 giorni fa

Occulto5 giorni faEsorcista dice che «la situazione per l’anticristo è ormai prossima»

-

Geopolitica2 settimane fa

Geopolitica2 settimane faLa dichiarazione di guerra di Trump all’Iran

-

Spirito1 settimana fa

Spirito1 settimana faI cardinali dell’«opposizione controllata» di Leone. Mons. Viganò contro i conservatori cattolici dinanzi alle Consacrazioni FSSPX

-

Geopolitica2 settimane fa

Geopolitica2 settimane faL’ayatollah Khamenei è morto: lo Stato iraniano conferma