Intelligenza Artificiale

Facebook sta sviluppando segretamente una nuova, potente Intelligenza Artificiale?

Mark Zuckerberg non starebbe perdendo il treno dell’Intelligenza Artificiale.

Secondo un articolo del Wall Street Journal, Meta – la società padrona di Facebook, Instagram, Whatsapp – sta sviluppando segretamente un potente modello di Intelligenza artificiale progettato per competere con GPT-4 di OpenAI.

Si sa molto poco di questo modello di IA e, come riporta il WSJ, i dettagli riguardo a questa Intelligenza Artificiale, che per ora è destinata ad «aiutare altre aziende a creare servizi che producono testi sofisticati, analisi e altri output», potrebbero essere soggetti a modifiche.

Vale anche la pena notare che questa non è la prima incursione di Meta nel territorio dei Large Language Model (LLM): LLAMA-2, l’atteso modello linguistico dell’azienda, è stato rilasciato solo pochi mesi fa.

Tuttavia secondo le fonti del WSJ, Meta spera che la sua nuova Intelligenza Artificiale sarà «molte volte più potente» di LLAMA-2 – un segno, forse, che LLAMA-2 non lo sta del tutto tagliando come alternativa GPT-4, e che Meta sa che dovrà alzare seriamente la posta se vuole tenere il passo con i suoi concorrenti.

Secondo l’articolo della testata economica neoeboracena, il modello è stato costruito da un team che inizialmente aveva il compito di accelerare gli sforzi dell’azienda per costruire un sistema di Intelligenza Artificiale Generativa in grado di «produrre forme simili a quelle umane».

Sostieni Renovatio 21

L’equipe di esperti prevede di iniziare ad addestrare questa nuova AI entro l’inizio del 2024 nel tentativo di espandere la propria infrastruttura di supporto all’AI. Secondo quanto riporta Futurism, Meta sarebbe apparentemente impegnata ad acquisire gli ambiti chip informatici Nvidia H100.

L’articolo del WSJ rileva inoltre che Zuckerberg sta spingendo per rendere open source la nuova Intelligenza Artificiale dell’azienda: una decisione che secondo quanto riferito ha turbato gli avvocati dell’azienda, che si vocifera abbiano sollevato alcune valide preoccupazioni su minacce come la potenziale violazione del copyright favorita e riguardo l’uso dell’intelligenza artificiale per generare disinformazione.

Per quanto poco reclamizzato, Facebook nel tempo ha eseguito ricerche molto avveniristiche, come quella per creare dispositivi in grado di leggere il pensiero degli utenti.

Considerato il comportamento dimostrato da Facebook, con la censura che si è abbattuta su dissidenti o anche semplici conservatori (ma non sui pedofili di Instagram o i donatori di sperma su Facebook, né sui neonazisti dell’Azov), la collusione con lo Stato profondo americano e le sue agenzie, la volontà di chiudere gli account di organizzazioni, partiti premier e presidenti, la raccolta massiva di dati anche biometrici (con il riconoscimento facciale che ha generato denunce di Stati come il Texas) nonché la possibilità di agire sul vostro telefono perfino scaricandone la batteria, c’è da domandarsi cosa la sua potente Intelligenza Artificiale possa fare alla vostra vita.

Facebook siede su una quantità immane di dati che vi riguardano. L’ammasso dei vostri Big Data personali è necessario per far funzionare l’IA, che impara ed evolve solo a fronte di quantità sterminate di informazioni.

«L’Intelligenza Artificiale ha bisogno di enormi quantità di dati aggiornati al minuto affinché il sistema di controllo funzioni» ha scritto Joseph Mercola, «quindi “affamare la bestia” deve essere in cima alla tua lista».

Vale sempre l’avvertimento dato da Elon Musk oramai tre anni fa: abbandonate Whatsapp e Facebook.

Uscire dai social, e dai programmi di messaggistica dei grandi gruppi americani, è l’unico modo affamare la bestia apocalittica, una mossa che esprime tutta la responsabilità che avete in questo orrendo processo verso la schiavitù inflittaci dalla macchina.

Intelligenza Artificiale

Google e azienda AI risolvono la causa secondo cui un chatbot avrebbe spinto un adolescente al suicidio

Aiuta Renovatio 21

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

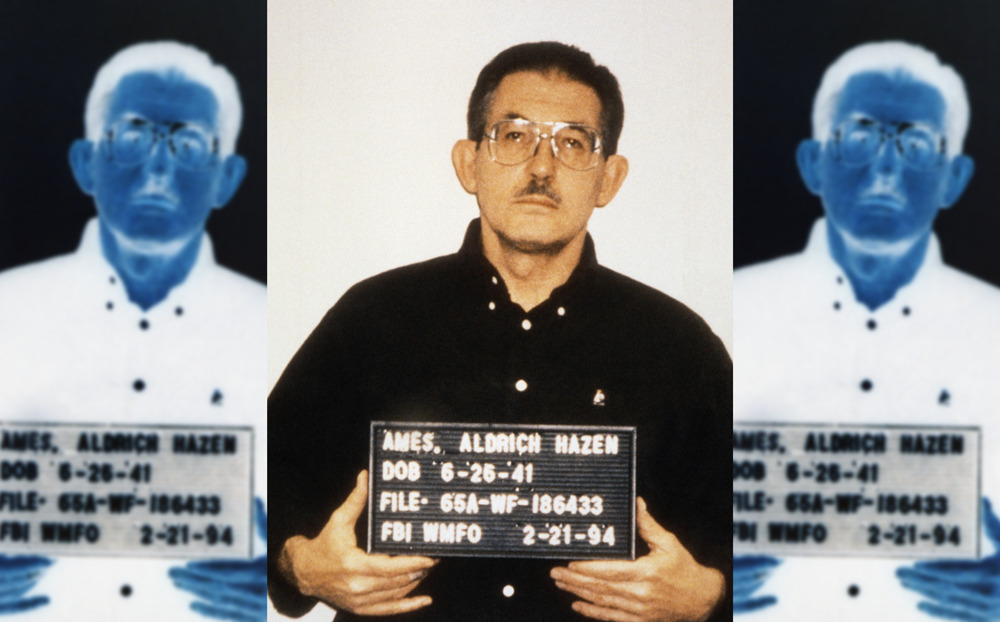

Muore in una prigione americana un agente della CIA diventato spia sovietica

L’ex agente della CIA Aldrich Ames, il cui spionaggio per l’Unione Sovietica e in seguito per la Russia ebbe conseguenze di vasta portata per l’intelligence statunitense, è morto all’età di 84 anni mentre scontava l’ergastolo in una prigione americana.

Secondo i registri del Federal Bureau of Prisons (BOP), Ames è deceduto il 5 gennaio.

Ames è stato «l’agente più prezioso» della Russia alla fine del XX secolo, le cui azioni hanno portato a significativi successi operativi per la sicurezza dello Stato sovietico e russo, ha scritto il giornalista e storico dei servizi segreti Nikolaj Dolgopolov in un articolo pubblicato mercoledì sulla Rossijskaja Gazeta.

Ames fu reclutato dall’Unione Sovietica nel 1985, dopo essersi rivolto volontariamente all’ambasciata sovietica a Washington. All’epoca, ricopriva la posizione critica di capo della sezione sovietica della Divisione Controspionaggio della CIA. Gli viene attribuito il merito di aver smascherato tra i 12 e i 25 agenti della CIA operanti in URSS e Russia, portando all’arresto e all’esecuzione di alcuni di loro.

Uno di essi era il colonnello KGB Valery Martynov, agente doppio che ricevette la pena di morte nel 1987 – la moglie e la figlia si trasferirono negli USA. Il nipote di Martynov, nato in America, è il giovane genio informatico Edward Coristine, noto per essere entrato nel DOGE di Elon Musk ad inizio dell’amministrazione Trump, e conosciutissimo più che altro per il suo soprannome «Big Balls».

Sostieni Renovatio 21

I motivi del suo tradimento sono controversi. Mentre le narrazioni occidentali hanno a lungo dipinto Ames come un uomo motivato da interessi economici – lo stile di vita lussuoso che lui e la sua nuova moglie conducevano finì per attirare l’attenzione dell’FBI – fonti russe presentano una visione diversa.

Secondo l’ex diplomatico sovietico Sergej Divilkovskij, che conosceva personalmente Ames, la decisione della spia era radicata in una profonda disillusione nei confronti delle politiche antisovietiche dell’amministrazione del presidente Ronald Reagan. In un’intervista del 2001, Divilkovskij descrisse Ames come un «agente di grande moralità» e un intellettuale che aveva imparato a odiare la CIA.

I servizi segreti sovietici e, in seguito, russi adottarono ampie misure per proteggere e proteggere Ames, distogliendo i sospetti da lui. Dopo il suo arresto e la sua dichiarazione di colpevolezza per spionaggio nel 1994, l’allora direttore del Servizio di Intelligence Estero russo, Evgeny Primakov, espresse la speranza di un potenziale futuro scambio di prigionieri.

Il caso di Ames ha messo in luce le profonde carenze della sicurezza interna della CIA, innescando ampie riforme nel controspionaggio statunitense.

Iscriviti alla Newslettera di Renovatio 21

Immagine di pubblico dominio CC0 via Wikimedia

Intelligenza Artificiale

I modelli di AI mostrano segni di cedimento man mano che assimilano più dati generati dall’AI stessa

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Pensiero7 giorni fa

Pensiero7 giorni faGli uomini invisibili di Crans-Montana

-

Geopolitica1 settimana fa

Geopolitica1 settimana faFAFO Maduro, dottrina Donroe e grandi giochi di prestigio – Europa compresa

-

Cancro2 settimane fa

Cancro2 settimane faVaccini COVID-19 e cancro: l’argomento tabù

-

Immigrazione2 settimane fa

Immigrazione2 settimane faUn altro capodanno nell’anarco-tirannia migratoria

-

Stragi2 settimane fa

Stragi2 settimane faDisco-inferno: strage di Capodanno nella prestigiosa stazione sciistica svizzera – video

-

Spirito5 giorni fa

Spirito5 giorni faConcilio Vaticano II, mons. Viganò contro papa Leone

-

Alimentazione4 giorni fa

Alimentazione4 giorni faRFK Jr. capovolge la piramide alimentare

-

Animali1 settimana fa

Animali1 settimana faAgricoltore assalito dai lupi, anarco-tirannia animale in azione