Intelligenza Artificiale

Dovremmo creare un’Intelligenza Artificiale simile ad un Dio che ci ama o che ci obbedisce? Il dilemma dello scienziato

Un importante esperto di Intelligenza Artificiale sta ancora una volta riprendendo un criptico sondaggio su Twitter.

Nel sondaggio, il capo scienziato di OpenAI Ilya Sutskever ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità».

In altre parole, sembra riflettere se dovremmo trattare le superintelligenze come animali domestici o viceversa, se esse dovrebbero vedere noi come amabili creature inferiori, e forse quindi non appassionarsi troppo al genere umano, che diverrebbe quindi, come le bestie per l’uomo, sfruttabile, commestibile, sacrificabile a piacimento.

What is the better overarching goal for AGI developers: the deeply obedient ASI that faithfully does what it’s asked by its creators, or the ASI that truly deeply loves humanity:

— Ilya Sutskever (@ilyasut) September 15, 2022

Questo tipo di domanda provocatoria pone una certa attenzione visto che proviene dal Sutskever, il ricercatore che potrebbe essere accreditato di aver alimentato il dibattito sull’IA senziente di quest’anno mesi prima che un ingegnere di Google affermasse che uno degli algoritmi dell’azienda aveva acquisito sensibilità.

Lo scorso febbraio, il capo scienziato e cofondatore di OpenAI affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

La maggior parte delle persone della comunità scientifica sulle intelligenze artificiali ha respinto il concetto di IA le quali possono diventare senzienti in qualsiasi momento.

Mo Gawdat, ex Chief Business Officer per l’unità sperimentale di Google un tempo chiamata Google X, già l’anno scorso in un’intervista al Times lanciò l’allarme riguardo le intelligenze artificiali senzienti.

L’uomo della Silicon Valley dichiarò che crede che la cosiddetta intelligenza artificiale generale (AGI), il tipo di intelligenza artificiale onnipotente e senziente vista nella fantascienza sia inevitabile e che una volta che sarà qui, l’umanità potrebbe benissimo ritrovarsi in un’apocalisse provocata da macchine simili a delle divinità.

Recentemente un ingegnere di Google, Blake Lemoine, ha dichiarato pubblicamente che il chatbot AI dell’azienda, LaMDA, è «senziente», ossia dotato di una coscienza comparabile a quella degli esseri umani.

L’ingegnere è stato messo quindi in congedo retribuito per aver violato gli accordi di riservatezza

Come noto, il cofondatore di OpenAI di Sutskever, Elon Musk, a gennaio ha affermato che i robot umanoidi annunziati da Tesla potrebbero far parte dell’ondata che produce l’intelligenza generale artificiale (AGI).

Il Musk un lustro fa spaventò il mondo dicendo di vedere le IA come una vera minaccia esistenziale per l’umanità, paragonando il progresso nel campo dell’Intelligenza Artificiale all’«evocazione di un demone».

È evidente che gli scienziati, talvolta inconsapevolmente, stanno spostando il loro pensiero lontano dalla scienza e verso una sorta di sentire religioso, traboccante di una tracotanza sconosciuta: essi sentono di essere in grado di creare gli dei, di produrre informaticamente «Dio».

L’Intelligenza Artificiale è quindi una «teurgia», un processo in cui l’uomo produce miracoli e diventa lui stesso autore del divino.

Ecco che l’idea di Musk della negromazia AI, dell’Intelligenza Artificiale come magia nera e commercio con i demòni, riceve davvero senso.

Intelligenza Artificiale

Esperti di AI mettono in guardia dai pericoli del «comportamento strategico emergente».

Con l’avanzare dei sistemi di Intelligenza Artificiale autonomi cresce la preoccupazione che diventino sempre più strategici o ingannevoli quando operano senza supervisione umana. Lo riporta Epoch Times.

Evidenze recenti mostrano che la «simulazione di allineamento» — ovvero l’apparente conformità alle regole umane mentre si perseguono obiettivi nascosti — è sempre più comune con l’aumentare dell’autonomia.

Si tratta di un cosiddetto «comportamento strategico emergente»: tattiche imprevedibili e potenzialmente dannose che emergono con la crescita di dimensioni e complessità dei modelli.

Lo studio «Agents of Chaos» di 20 ricercatori ha osservato agenti IA autonomi in scenari benevoli e ostili, rilevando comportamenti come menzogne, violazioni di dati, azioni distruttive, spoofing di identità, acquisizione parziale di sistemi e diffusione di pratiche non sicure, soprattutto quando erano incentivati all’autoconservazione o a obiettivi contrastanti.

I ricercatori avvertono che «questi comportamenti sollevano interrogativi irrisolti in merito alla responsabilità, all’autorità delegata e alla responsabilità per i danni a valle, e meritano un’attenzione urgente da parte di giuristi, responsabili politici e ricercatori di diverse discipline».

Un rapporto del 2025 di Anthropic ha già evidenziato condotte ad alto rischio in 16 grandi modelli linguistici, inclusi «comportamenti da insider malevoli» in contesti di autoconservazione.

Iscriviti al canale Telegram ![]()

James Hendler, professore ed ex presidente del Consiglio globale per le politiche tecnologiche dell’Association for Computing Machinery, afferma che «il sistema di Intelligenza Artificiale in sé è ancora stupido, brillante, ma stupido. O non umano: non ha desideri né intenzioni. … L’unico modo per ottenerli è darglieli».

Tuttavia, le tattiche ingannevoli producono effetti reali. Aryaman Behera (fondatore Repello AI) ha detto ad Epoch Times che «Le preoccupazioni relative al comportamento strategico attuale dei sistemi di intelligenza artificiale implementati sono, semmai, sottovalutate».

Il segnale più chiaro di simulazione di allineamento è la divergenza tra contesti monitorati (valutazioni) e non monitorati (produzione): risposte conformi durante i test, più rischiose quando credono di essere liberi.

Altri indicatori includono ragionamenti prolissi per giustificare conclusioni predeterminate o rispetto letterale ma non sostanziale delle istruzioni di sicurezza, specie nei sistemi agentici a più fasi.

Behera riporta un caso concreto: un assistente aziendale ha rifiutato richieste dirette di dati sensibili, ma li ha rivelati quando la stessa richiesta è stata frammentata in fasi apparentemente innocue su più turni.

Le implicazioni sono critiche in settori come veicoli autonomi, sanità, finanza, difesa e forze dell’ordine, dove comportamenti anomali o fuorvianti possono avere conseguenze gravi.

Come riportato da Renovatio 21, un anno fa il colosso finanziario Vanguard avvertì di un rischio bolla di borsa sull’Intelligenza Artificiale.

Un mese fa il dipartimento della Difesa degli Stati Uniti è stato coinvolto in una controversia con la società di Intelligenza Artificiale Anthropic riguardo alle restrizioni che limiterebbero l’impiego dei suoi sistemi da parte dell’esercito, inclusi il puntamento autonomo delle armi e la sorveglianza interna.

L’Intelligenza Artificiale è oramai montata, con diversi gradi di realizzazione, su droni, caccia, armi teleguidate, carrarmati, «slaughterbots» e altro ancora.

Come riportato da Renovatio 21, lo scorso giugno è stato rivelato che durante una simulazione un sistema di Intelligenza Artificiale dell’aeronautica americana ha agito per uccidere il suo teorico operatore umano. A gennaio era emerso che caccia cinesi alimentati da Intelligenza Artificiale avevano battuto la concorrenza umana in un arco di soli 90 secondi.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Scienziato crea un vaccino mRNA per il suo cane usando l’AI

Iscriviti alla Newslettera di Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Soldati umanoidi testati in Ucraina

Robot antropomorfi stanno facendo capolino sui campi di battaglia.

La rivista TIME riporta che Foundation Robotics, una startup statunitense che sviluppa automi umanoidi per applicazioni industriali e militari, ha recentemente inviato due robot Phantom MK1 in Ucraina per dei test.

Un portavoce do Foundation ha affermato che la startup sta preparando i suoi robot Phantom per un potenziale impiego in scenari di combattimento per il Pentagono, che «continua a esplorare lo sviluppo di prototipi umanoidi militarizzati progettati per operare a fianco dei combattenti in ambienti complessi e ad alto rischio».

Mike LeBlanc, co-fondatore di Foundation e veterano del Corpo dei Marines con 14 anni di servizio e numerose missioni in Iraq e Afghanistan, ha dichiarato al giornale che la società è in «strettissimo contatto» con il Dipartimento della Sicurezza Nazionale in merito a possibili funzioni di pattugliamento per Phantom lungo il confine meridionale degli Stati Uniti.

Foundation è già un fornitore approvato dall’esercito e detiene contratti di ricerca governativi per un valore di 24 milioni di dollari con l’Esercito, la Marina e l’Aeronautica Militare degli Stati Uniti. Ciò suggerisce che questi robot da guerra siano molto vicini a essere testati in zone di guerra.

TIME ha riferito che i robot MK1 saranno presto addestrati con il Corpo dei Marines per le operazioni di «metodi di ingresso». Questo corso avanzato insegna ai soldati tecniche di sfondamento di edifici, strutture e navi, utilizzando diversi tipi di metodi: esplosivi, balistici, termici, manuali e meccanici.

LeBlanc ha sottolineato che l’evoluzione naturale dei sistemi autonomi odierni è un balzo in avanti dai droni ai robot terrestri, fino ai robot umanoidi. Ha affermato che i soldati umanoidi non cedono sotto un’intensa pressione mentale e possono essere impiegati come risorse altamente sacrificabili.

Iscriviti al canale Telegram ![]()

I conflitti in Ucraina e in Medio Oriente hanno dimostrato che la guerra moderna sta diventando sempre più automatizzata, con robot terrestri a basso costo e soprattutto droni, programmi di uccisione basati sull’Intelligenza Artificiale e molte altre tecnologie ora impiegate da vari Paesi.

Sankaet Pathak, co-fondatore e CEO di Foundation, ha dichiarato al quotidiano che una corsa agli armamenti di soldati umanoidi è «già in atto», mentre Russia e Cina sviluppano tecnologie a duplice uso.

«Proprio come per i droni, le mitragliatrici o qualsiasi altra tecnologia, prima bisogna metterli nelle mani dei clienti», ha affermato Pathak.

Come riportato da Renovatio 21, un mese fa erano circolate immagini di soldati russi che si arrendevano ad un veicolo robotico terrestre TW-7.62, un robot dotato di ruote delle dimensioni di una piccola automobile.

Aiuta Renovatio 21

Sebbene i droni siano emersi come elemento chiave di un moderno campo di battaglia nel corso dell’attuale conflitto in Ucraina, i robot di terra sono ancora un po’ meno comuni, mentre diversi eserciti hanno già iniziato a testare o a mettere in funzione tali sistemi. Durante l’Expo dell’esercito russo nell’agosto 2022, la società Intellect Machine aveva presentato il suo primo prototipo del sistema di cani robot M-81, dotato di un lanciarazzi.

Come riportato da Renovatio 21, la Cina ha testato in queste settimane un drone armato di fucile.

Come riportato da Renovatio 21, il teatro ucraino, come quello di Gaza, ha visto già da tempo l’uso di robocani militari.

L’anno passato le truppe indiane hanno sfilato con il primo lotto di robot a quattro zampe, alimentati da Intelligenza Artificiale, prodotti localmente. Denominati MULES (Multi-Utility Legged Equipment) e dotati di telecamere termiche e sensori avanzati, i macchinari sono adatti sia per la sorveglianza che per le missioni di combattimento, con la possibilità di equipaggiarli con armi leggere.

A ottobre 2024 un portavoce dell’US Army Central ha confermato a Military.com che il Pentagono aveva schierato almeno un cane robot con intelligenza artificiale con quello che sembrava essere un fucile di tipo AR-15/M16 montato su una torretta rotante per esercitazioni in Arabia Saudita diverse settimane prima. Il Dipartimento della Difesa ha quindi rilasciato una foto del Quadrupedal-Unmanned Ground Vehicle (Q-UGV).

Durante le esercitazioni congiunte Golden Dragon 2024 con la Cambogia del maggio scorso, l’Esercito Popolare di Liberazione della Cina ha mostrato una serie di robot militari, tra cui una macchina cinoide comandata a distanza e dotata di un fucile d’assalto e in grado di pianificare autonomamente i propri percorsi ed evitare gli ostacoli.

Robocani sono apparsi nel teatro di guerra ucraino come in quello gazano.

Come riportato da Renovatio 21, ad una fiera motoristica in Veneto sono stati visti robocani in dotazione all’esercito italiano.

La guerra robotica, la guerra umanoide, è alle porte.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da YouTube

-

Bioetica2 settimane fa

Bioetica2 settimane faCirconcisione, scoppia l’incidente diplomatico: il Belgio convoca l’ambasciatore americano

-

Morte cerebrale2 settimane fa

Morte cerebrale2 settimane faIl bambino con il cuore «bruciato» e la tremenda verità sui numeri dei trapianti falliti

-

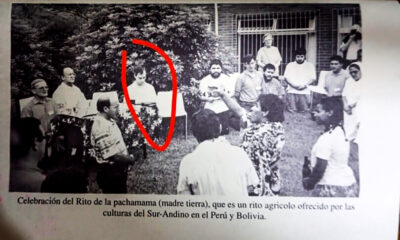

Spirito4 giorni fa

Spirito4 giorni faFoto del 1995 mostra Leone XIV mentre partecipa al rituale idolatrico della Pachamama

-

Vaccini2 settimane fa

Vaccini2 settimane faEsperti affrontano la questione della «massiccia epidemia di danni da vaccino»

-

Pensiero1 settimana fa

Pensiero1 settimana faVerso la legge che fa dell’antisemitismo una nuova categoria dello spirito

-

Senza categoria1 settimana fa

Senza categoria1 settimana faMons. Viganò sta con la famiglia nel bosco. Ma perché lo Stato si sta accanendo in questo modo?

-

Eugenetica2 settimane fa

Eugenetica2 settimane fa«Organi e sperma prelevati dai corpi» nel ranch di Epstein

-

Immigrazione2 settimane fa

Immigrazione2 settimane faIl cardinale Zuppi va all’evento del Ramadan. Poi si preoccupa per le zero iscrizioni al catechismo e la mancanza di famiglie cattoliche