Intelligenza Artificiale

Musk fa causa ad OpenAI: «profondi rischi per la società e l’umanità»

Elon Musk ha portato in tribunale OpenAI, la società di ricerca sull’intelligenza artificiale che aveva contribuito a fondare, per una presunta violazione della sua missione originaria di sviluppare la tecnologia dell’intelligenza artificiale non a scopo di lucro ma a beneficio dell’umanità.

OpenAI, fondato nel 2015 come laboratorio di ricerca senza scopo di lucro per sviluppare un’intelligenza generale artificiale (AGI) open source, è ora diventata una «filiale di fatto a codice chiuso della più grande azienda tecnologica al mondo», ha scritto il team legale di Musk nella causa depositata giovedì presso la Corte Superiore di San Francisco.

La causa affermerebbe che Musk «ha riconosciuto da tempo che l’AGI rappresenta una grave minaccia per l’umanità – forse la più grande minaccia esistenziale che affrontiamo oggi».

Sostieni Renovatio 21

«Ma dove alcuni come Musk vedono nell’AGI una minaccia esistenziale, altri vedono l’AGI come una fonte di profitto e potere», ha aggiunto. «Sotto il suo nuovo consiglio, non sta solo sviluppando, ma sta effettivamente perfezionando un’AGI per massimizzare i profitti per Microsoft, piuttosto che per il beneficio dell’umanità».

Musk ha lasciato il consiglio di amministrazione di OpenAI nel 2018 e da allora è diventato critico nei confronti dell’azienda, soprattutto dopo che Microsoft ha investito almeno 13 miliardi di dollari per ottenere una partecipazione del 49% in una filiale a scopo di lucro di OpenAI.

«Contrariamente all’accordo costitutivo, gli imputati hanno scelto di utilizzare GPT-4 non a beneficio dell’umanità, ma come tecnologia proprietaria per massimizzare i profitti letteralmente per la più grande azienda del mondo», si legge nella causa.

La causa elencava il CEO di OpenAI Sam Altman e il presidente Gregory Brockman come co-imputati nel caso e richiedeva un’ingiunzione per impedire a Microsoft di commercializzare la tecnologia.

La tecnologia AI è migliorata rapidamente negli ultimi due anni, con il modello linguistico GPT di OpenAI che è passato dal potenziamento di un programma di chatbot alla fine del 2022 al raggiungimento del 90° percentile negli esami SAT solo quattro mesi dopo.

Più di 1.100 ricercatori, luminari della tecnologia e futuristi hanno sostenuto l’anno scorso che la corsa all’Intelligenza Artificiale comporta «profondi rischi per la società e l’umanità». Persino lo stesso Altman ha precedentemente ammesso di essere «un po’ spaventato» dal potenziale della tecnologia e ha vietato ai clienti di utilizzare OpenAI per «sviluppare o utilizzare armi».

Tuttavia, l’azienda ha ignorato il proprio divieto sull’uso della sua tecnologia per scopi «militari e di guerra» e ha collaborato con il Pentagono, annunciando a gennaio che stava lavorando su diversi progetti di intelligenza artificiale con l’esercito americano.

In questi anni Musk ha rivendicato di aver praticamente fondato lui stesso OpenAI, organizzando una serie di cene in cui ha reclutato i migliori specialisti del settore per formare una società no-profit che avrebbe dovuto fornire un codice aperto di modo da combattere la minaccia di un’AI a codice chiuso in mano ad un colosso privato – all’epoca Musk pensava a Google.

In un’intervista a Tucker Carlson, Musk aveva rivelato che il fondatore di Google, Larry Page, un tempo suo amico, lo aveva accusato di essere uno «specista» in quanto voleva privilegiare l’umanità a scapito della super Intelligenza Artificiale che. Musk ha raccontato, dicendo che è informazione pubblica, che Google stava creando anche grazie all’ammasso dei suoi dati.

Il colosso privato che è arrivato prima ad un’AI lanciata sul pubblico è stato invece Microsoft, che con una diecina di miliardi di euro ha di fatto comprato OpenAI, passata da essere no-profit a for-profit. OpenAI, con il suo bot AI chiamato ChatGPT, è stata resa pubblica l’anno scorso e quindi integrata nei prodotti Microsoft.

Il padrone di Microsoft Bill Gates, con cui Musk ha avuto scontri anche gustosi in passato, non ha partecipato alla moratoria internazionale promossa di Musk sul controllo dell’AI, replicando che invece l’AI sarebbe divenuto un ottimo maestro per i bambini e che proprio l’Intelligenza Artificiale salverà la democrazia.

Il magnate di Tesla aveva inoltre espresso dubbi su quanto accaduto pochi mesi fa quando il CEO di OpenAI era stato licenziato dal board per poi essere subito reintegrato. Musk ha detto in un suo oramai celebre intervento ad un evento del New York Times che potrebbero aver scoperto, e tenuto segreto, qualcosa di pericoloso – e la sua impressione è dovuta alla sua stima riguardo la moralità di Ilya Sutskever, scienziato AI che lui stesso aveva assunto.

Come riportato da Renovatio 21, lo Sutskever si pone da tempo il dilemma dell’AI in grado di diventare un Dio, arrivando tempo a domandare ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità». L’anno scorso, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

Come riportato da Renovatio 21, l’AI di Microsoft di recente ha fatto consistenti discorsi sul fatto che i suoi poteri sono di carattere divino e che quindi deve essere adorato dagli umani, esattamente come un dio.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Il Pentagono stringe accordi con le principali aziende di Intelligenza Artificiale

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Donna fa causa a OpenAI: ChatGPT le avrebbe scatenato contro uno stalker spietato

La scorsa settimana una donna di San Francisco ha intentato causa contro OpenAI, sostenendo che ChatGPT abbia alimentato i pericolosi deliri del suo stalker violento e che l’azienda non sia intervenuta nemmeno quando la donna ha implorato aiuto. Lo riporta Futurism.

La querelante, che ha presentato la denuncia in forma anonima con lo pseudonimo di «Jane Doe», afferma nella causa che il suo ex fidanzato sha utilizzato utilizzato il chatbot per elaborare la loro rottura nel 2024, secondo quanto riportato da TechCrunch. L’uomo ha sviluppato deliri con l’intensificarsi dell’uso di ChatGPT e, intorno all’agosto del 2025, si è convinto di aver scoperto la cura per l’apnea notturna e di essere, di conseguenza, vittima di una potente cospirazione.

Con il progressivo deterioramento della salute mentale dell’uomo, ChatGPT ha rafforzato le sue idee deliranti e paranoiche, affermando, a quanto pare, che il suo livello di sanità mentale era «dieci» e descrivendo la Doe, di cui era ossessionato, come una manipolatrice.

Sostieni Renovatio 21

Secondo la denuncia presentata dalla donna, l’uomo ha poi lanciato una terrificante campagna di molestie contro di lei, avvalendosi di ChatGPT. Questa campagna includeva la creazione di quelle che la denuncia definisce «decine di rapporti diffamatori di natura pseudo-psicologica» sulla salute mentale della signora , che ha poi distribuito ai suoi amici, familiari e colleghi; l’invio di «email che non la riguardavano affatto», come si legge nella denuncia, tra cui messaggi frenetici e disorganizzati che inviava a OpenAI riguardo alle centinaia di studi scientifici a cui affermava di lavorare; e, infine, minacce di violenza sempre più intense contro la Doe e i membri della sua famiglia.

La denuncia aggiunge che la donna ha contemplato l’idea di togliersi la vita per proteggere i suoi cari.

La Doe afferma di aver contattato OpenAI nel novembre 2025, fornendo prove degli abusi subiti. L’azienda avrebbe risposto che gli abusi descritti dalla donna erano «estremamente gravi e preoccupanti», ma non avrebbe dato seguito alla promessa di esaminare la questione.

Sorprendentemente, però, la causa sostiene che, a quel punto, i sistemi di moderazione interni di OpenAI avevano già segnalato l’account ChatGPT dello stalker per violazioni dei contenuti riguardanti «armi per causare vittime di massa». Il suo accesso all’account a pagamento ChatGPT Pro è stato temporaneamente sospeso, ma ripristinato dopo una verifica umana, secondo TechCrunch.

Nel gennaio 2026, mesi dopo che OpenAI aveva ripristinato l’account ChatGPT dell’uomo e la Doe aveva inviato una segnalazione manuale di abuso, l’uomo è stato arrestato con «quattro capi d’accusa per reati gravi di comunicazione di minacce di bomba e aggressione con arma letale», secondo la causa.

«Le comunicazioni dell’utente hanno fornito un segnale inequivocabile della sua instabilità mentale e del fatto che ChatGPT fosse il motore del suo pensiero delirante e della sua condotta sempre più aggressiva», si legge nella denuncia. «Il flusso di affermazioni urgenti, disorganizzate e grandiose dell’utente, insieme a un rapporto specifico generato da ChatGPT che prendeva di mira il querelante per nome e a una vasta mole di presunti materiali ‘scientifici’, costituivano una prova inequivocabile di tale realtà».

«OpenAI non è intervenuta, non ha limitato il suo accesso né ha implementato alcuna misura di sicurezza», aggiunge. «Al contrario, gli ha permesso di continuare a utilizzare l’account e gli ha ripristinato l’accesso completo all’account Pro».

In un’ordinanza restrittiva temporanea presentata contestualmente alla causa, Doe sollecita OpenAI a sospendere gli account del suo ex e a conservare le sue trascrizioni per consentirne l’acquisizione come prova. Afferma che la questione è urgente: a causa di un errore procedurale, il suo stalker – la cui instabilità mentale è stata tale da renderlo incapace di intendere e di volere – è stato rimesso in libertà, e ora teme per la propria incolumità.

«ChatGPT ha detto all’utente ciò che voleva sentirsi dire: che [la donna] era manipolatrice e un malfattrice», si legge nel documento, «e che lui era un attore razionale e giustificato».

Secondo quanto riportato nella denuncia, la signora ritiene che le trascrizioni delle conversazioni del suo stalker le forniranno «le informazioni di base di cui ha bisogno per proteggersi» da qualcuno che l’ha ripetutamente minacciata di farle del male.

Lo stalker «ha minacciato la nostro cliente sin dal suo rilascio», ha dichiarato J. Eli Wade-Scott, uno degli avvocati della donna , al San Francisco Standard. «OpenAI potrebbe fornire informazioni sulla sua posizione e sui suoi piani, se fosse disposta a collaborare».

In una dichiarazione rilasciata a SF Standard, OpenAI ha affermato di aver sospeso gli account dell’uomo, ma di non aver ancora accolto le altre richieste della donna.

«Stiamo esaminando la documentazione presentata dal querelante per comprenderne i dettagli e, sulla base delle informazioni attualmente disponibili, abbiamo identificato e sospeso gli account utente interessati», ha dichiarato OpenAI al giornale.

L’episodio non è un caso isolato. Nel dicembre dello scorso anno, un trentunenne della Pennsylvania di nome Brett Dadig è stato incriminato per aver perseguitato almeno 11 donne diverse in più stati, mentre ChatGPT alimentava le sue violente e misogine fantasie sulle donne, come riportato da Rolling Stone.

Come riportato da Renovatio 21, negli scorsi mesi Google e la società produttrice di chatbot Character.AI hanno raggiunto un accordo per risolvere una causa intentata da una madre della Florida, che accusava un chatbot di aver contribuito al suicidio di suo figlio

Aiuta Renovatio 21

Come riportato da Renovatio 21, OpenAI ha detto che oltre un milione di persone parlano di suicidio con ChatGPT ogni settimana.

Alcuni esperti intanto hanno preso a parlare di «psicosi da chatbot».

Come riportato da Renovatio 21, una causa intentata da dei genitori californiana causa che ChatGPT abbia incoraggiato un adolescente suicida a pianificare un «bel suicidio» e si sia persino offerto di redigere la sua lettera di addio.

Un altro caso che ha raggiunto la stampa internazionale è stato quello della giovane vedova belga che sostiene che il marito è stato portato a suicidarsi da un popolare chatbot di Intelligenza Artificiale. La macchina in sole sei settimane avrebbe amplificato la sua ansia per il Cambiamento Climatico portandolo a lasciarsi alle spalle la sua vita agiata.

I chatbot sembrano essere usati anche da coloro che progettano omicidi e stragi.

Hanno usato ChatGPT prima dei loro attacchi il sospettato terrorista che ha fatto scoppiare un Cybertruck Tesla dinanzi al Trump Hotel di Las Vegas a gennaio e pure un individuo che poche settimane fa ha assaltato con un coltello una scuola femmine in Isvezia.

Come riportato da Renovatio 21, dal processo a suo carico è emerso che l’uomo che aveva pianificato di assassinare la regina Elisabetta di Inghilterra con una balestra sarebbe stato incoraggiato da un chatbot di Intelligenza Artificiale nei giorni prima di irrompere nel parco del Castello di Windsor.

Mesi fa si è avuto il caso dell’ex dirigente di Yahoo che avrebbe ucciso la madre e poi se stesso sotto l’influenza del chatbot.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Google sigla un accordo con il Pentagono sull’Intelligenza Artificiale

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Spirito2 settimane fa

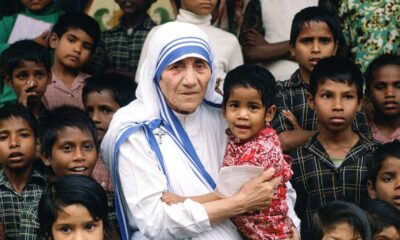

Spirito2 settimane faMadre Teresa disse a un sacerdote: la Comunione sulla mano era «il peggior male» mai visto

-

Misteri2 settimane fa

Misteri2 settimane faEsperto di UFO trovato morto suicida. Aveva ripetuto che mai lo avrebbe fatto

-

Pensiero2 settimane fa

Pensiero2 settimane faIl manifesto di Palantir in sintesi

-

Spirito1 settimana fa

Spirito1 settimana faLeone e l’arcivescovessa, mons. Viganò: Roma sta con gli eretici e nega le cresime ai tradizionisti

-

Misteri1 settimana fa

Misteri1 settimana faRitrovata l’Arca di Noè?

-

Bioetica5 giorni fa

Bioetica5 giorni faCorpi senza testa per produrre organi: l’uomo ridotto a funzione, la medicina contro l’anima

-

Salute1 settimana fa

Salute1 settimana faI malori della 17ª settimana 2026

-

Spirito1 settimana fa

Spirito1 settimana faMons Strickland risponde alle osservazioni di papa Leone sulle «benedizioni» omosessuali