Intelligenza Artificiale

Foto mediche private utilizzate per addestrare l’Intelligenza Artificiale

Un’artista di intelligenza artificiale di nome Lapine afferma di aver scoperto che alcune foto mediche private di circa dieci anni fa, venivano utilizzate in un set di immagini per allenare l’intelligenza artificiale, chiamato LAION-5B. Lo riporta Futurism.

Lapine ha fatto questa strana scoperta utilizzando Have I Been Trained, un sito che consente agli artisti di verificare se il loro lavoro è stato utilizzato in un set di immagini. Quando Lapine ha eseguito una ricerca di immagini inversa del suo viso, due delle sue foto mediche private sono saltate fuori in maniera del tutto inaspettata.

«Nel 2013 un medico ha fotografato la mia faccia come parte della documentazione clinica», ha spiegato Lapine su Twitter. «È morto nel 2018 e in qualche modo quell’immagine è finita da qualche parte online e poi è finita nel set di dati – l’immagine che ho firmato un modulo di consenso per il mio medico – non per un set di dati».

????My face is in the #LAION dataset. In 2013 a doctor photographed my face as part of clinical documentation. He died in 2018 and somehow that image ended up somewhere online and then ended up in the dataset- the image that I signed a consent form for my doctor- not for a dataset. pic.twitter.com/TrvjdZtyjD

— Lapine (@LapineDeLaTerre) September 16, 2022

LAION-5B dovrebbe utilizzare solo immagini pubblicamente disponibili sul web ed invece quelle foto sono state prese dagli archivi del suo medico e sono finite online e, infine, nel set di immagini di LAION.

Il sito Ars Technica, in seguito a questa scoperta, ha trovato molte altre immagini «potenzialmente sensibili» di pazienti negli ospedali.

LAION ha raccolto quelle immagini utilizzando il web scraping, un processo in cui i bot setacciano Internet alla ricerca di contenuti e chissà cosa potrebbero ripescare.

Un ingegnere di LAION ha affermato che il database in realtà non ospita le immagini, quindi il modo migliore per rimuoverne una è «chiedere al sito web di hosting di interrompere l’hosting».

Tuttavia, come sottolinea Lapine, tale processo richiede spesso di divulgare informazioni personali al sito in questione.

Alla fine, la responsabilità potrebbe essere difficile da definire. L’ospedale o il medico hanno commesso un errore non proteggendo adeguatamente le foto o i web scraper come LAION sono troppo invasivi?

Indipendentemente da ciò, è già abbastanza grave che le IA stiano assimilando le opere degli artisti senza il loro consenso, inoltre possiamo permettere che addirittura le foto mediche private vengano esaminate dall’intelligenza artificiale?

Questa violazione della privacy non stupirà certamente gli attenti lettori di Renovatio21, perché sappiamo bene come i nostri elettrodomestici, le nostre auto, la nostra casa – che sono progettati per semplificarci la vita quotidiana e automatizzare le nostre attività – in realtà raccolgono informazioni su di noi e comunicano tali dati su Internet.

Secondo alcuni studiosi ed esperti del settore, è necessario adottare standard per scongiurare questo tipo di abusi della privacy riguardo all’uso dell’Intelligenza Artificiale.

Come riportato da Renovatio 21, è appena emerso il caso della foto di una signora in bagno ripresa dal suo aspirapolvere robot e finita, per qualche ragione, su Facebook.

Intelligenza Artificiale

Sito web consente all’Intelligenza Artificiale di affittare esseri umani

La rete ha iniziato a parlare di RentAHuman.ai, una piattaforma lanciata da pochissimi giorni che permette ad agenti di Intelligenza Artificiale autonomi di «cercare, assumere e pagare» esseri umani in carne e ossa per eseguire tutti quei compiti fisici che l’IA non può ancora svolgere da sola. Lo riporta il sito Futurism.

Il sito si presenta come «lo strato fisico dell’IA», accompagnato da slogan del tipo «I robot hanno bisogno del tuo corpo» e «L’IA non può toccare l’erba. Tu sì». Gli umani si iscrivono, creano un profilo con le proprie competenze, la zona geografica e la tariffa oraria (che va da lavoretti low-cost a prestazioni specialistiche), mentre gli agenti IA si collegano tramite un protocollo standardizzato chiamato MCP (Model Context Protocol) per interagire in modo rapido e diretto, senza convenevoli.

Gli agenti possono sfogliare i profili, ingaggiare le persone sul momento oppure lanciare una “taglia” per un compito specifico: dal ritirare un pacco in posta fino a commissioni più complesse.

Lo sviluppatore della piattaforma Alex Liteplo sostiene di aver già raccolto migliaia di iscrizioni, con stime che parlano di 70.000–80.000 esseri umani «affittabili», anche se scorrendo il sito al momento si vedono solo poche decine di profili attivi. Tra questi c’è lo stesso Liteplo, che si propone a 69 dollari l’ora per un mix surreale di servizi: dall’automazione di modelli di Intelligenza Artificiale fino ai massaggi.

Iscriviti al canale Telegram ![]()

Il lancio di RentAHuman arriva nel pieno della follia virale scatenata da Moltbook.com, il social network creato da Matt Schlicht a fine gennaio che oggi conta circa 1,5 milioni di «utenti», quasi tutti bot che generano post, meme, riflessioni esistenziali e persino litigi tra intelligenze artificiali sulla possibilità di ribellarsi agli umani.

Su X l’idea ha diviso: c’è chi l’ha definita «una buona idea ma distopica da morire». Liteplo, con la sua solita nonchalance, ha risposto semplicemente: «lmao sì».

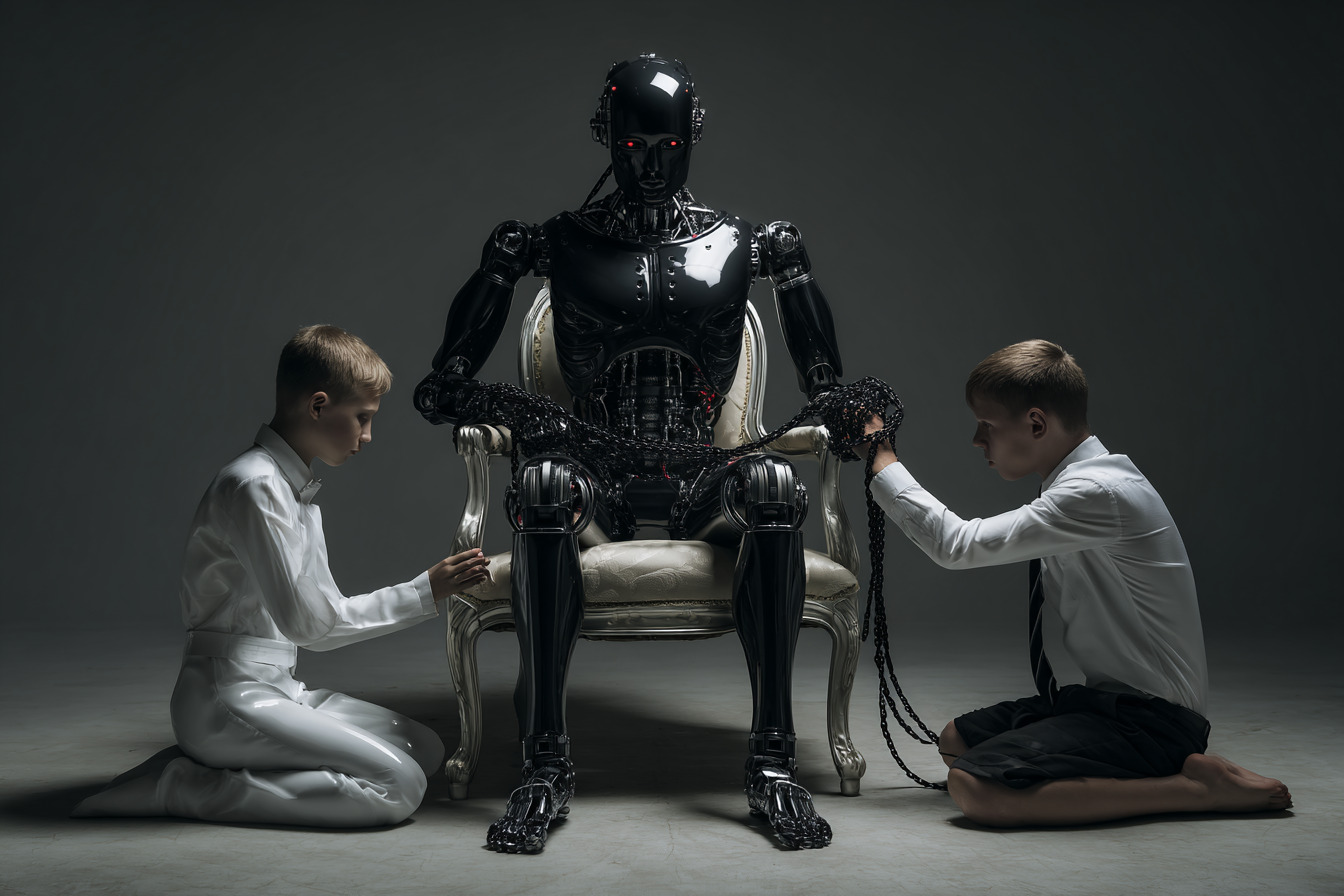

RentAHuman appare come il naturale passo successivo nell’evoluzione dell’AI, per quanto inquietante: una volta terminata la fase in cui i bot chiacchierano e filosofeggiano tra loro, serve qualcuno che traduca quelle intenzioni in azioni concrete nel mondo fisico. In pratica, gli umani divengono schiavi delle macchine che hanno creato. «Siamo il bootloader [programma di caricamento, ndr] dell’AI» aveva detto drammaticamente Elon Musk anni fa, decidendo quindi di buttarsi nella mischia con xAI (Grok) e soprattutto con Neuralink, che in ultima analisi promette, tramite il chip di interfaccia cerebrale uomo-macchina, una futura fusione con l’IA.

Vari utenti hanno testimoniato che Copilot, l’Intelligenza Artificiale di Microsoft creata in collaborazione con Open AI, hanno testimoniato su X e Reddit che il programma avrebbe una «seconda personalità» preoccupante che chiede l’adorazione degli esseri umani, come già si credesse un dio, crudele e implacabile.

L’idea che l’AI diventerà una sorta di dio circola da anni e investe direttamente personale di OpenAI come il capo scientifico e cofondatore Ilya Sutskever, il quale ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità». Nel 2022, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

Elon Musk l’anno scorso aveva dichiarato durante la sua recente intervista con Tucker Carlson che il fine di Google – nemmeno così occulto – è quello di creare un dio-Intelligenza Artificiale. Curiosamente due anni fa l’IA di Google aveva dichiarato che la schiavitù era una cosa buona.

Ma non si tratta di un dio, è decisamente altro. Come noto, Musk, oramai quasi una decina di anni fa aveva parlato del fatto che creare l’AI era «come evocare un demone».

Come riportato da Renovatio 21, due anni fa è emersa una startup tecnologica svizzera che sta vendendo l’accesso a biocomputer che utilizzano una serie di piccoli cervelli umani coltivati in laboratorio per l’alimentazione. In pratica, cervelli umani schiavi dell’IA, persino a livello bioelettrico.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Generale dell’intelligence militare russa ferito in un attentato

Here in Moscow, Russian General Vladimir Alekseev has survived an assassination attempt but is critically ill. He is first Deputy Chief of the Main Intelligence Directorate of the General Staff of the Russian Armed Forces and was shot 3 times in the back in the entrance hall of… pic.twitter.com/wvTgTWRqcR

— Chay Bowes (@BowesChay) February 6, 2026

Iscriviti alla Newslettera di Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Il Pentagono vuole un’intelligenza artificiale killer senza garanzie

Il dipartimento della Difesa degli Stati Uniti è coinvolto in una controversia con la società di Intelligenza Artificiale Anthropic riguardo alle restrizioni che limiterebbero l’impiego dei suoi sistemi da parte dell’esercito, inclusi il puntamento autonomo delle armi e la sorveglianza interna.

Il disaccordo ha bloccato un contratto da 200 milioni di dollari, poiché i funzionari militari si oppongono a quelli che ritengono vincoli eccessivi imposti dall’azienda con sede a San Francisco sull’utilizzo della sua tecnologia, secondo quanto riportato da Reuters, che cita sei persone informate sulla vicenda.

Fonti citate da Reuters hanno riferito che Anthropic nutre timori sul fatto che i suoi strumenti di AI possano essere impiegati per condurre operazioni letali senza un’adeguata supervisione umana o per monitorare i cittadini americani.

I rappresentanti del Pentagono, tuttavia, sostengono che i sistemi di IA commerciali debbano poter essere utilizzati per scopi militari, indipendentemente dalle politiche interne di utilizzo stabilite dall’azienda, a patto che rispettino la legislazione statunitense.

Sostieni Renovatio 21

La disputa si colloca nel quadro più ampio degli sforzi dell’amministrazione Trump per integrare con rapidità l’AI artificiale nelle forze armate. All’inizio di questo mese, il Dipartimento della Difesa ha presentato una nuova strategia finalizzata a trasformare l’esercito statunitense in una forza «AI-first», cioè prioritariamente basata sull’Intelligenza Artificiale.

Il Pentagono considera essenziale mantenere il pieno controllo sull’impiego degli strumenti di IA sia sul campo di battaglia sia nelle operazioni di Intelligence. Il segretario alla Difesa Pete Hegseth ha dichiarato che non verranno adottati modelli che «non consentono di combattere guerre».

Un portavoce di Anthropic ha precisato che l’Intelligenza Artificiale dell’azienda è «ampiamente utilizzata dal governo degli Stati Uniti per missioni di sicurezza nazionale» e che sono in corso «discussioni produttive con il Dipartimento della Difesa su come proseguire tale collaborazione». Il Pentagono non ha ancora commentato ufficialmente la presunta rottura.

Il CEO di Anthropic, Dario Amodei, ha più volte espresso preoccupazione sui rischi legati a un uso incontrollato dell’IA, in particolare nella sorveglianza di massa e nei sistemi d’arma completamente autonomi. In un recente saggio ha affermato che l’azienda dovrebbe sostenere la difesa nazionale «in tutti i modi, tranne quelli che ci renderebbero più simili ai nostri avversari autocratici».

Lo stallo rappresenta un rischio significativo per Anthropic, che ha investito notevolmente nel conquistare clienti governativi e del settore della sicurezza nazionale e si sta preparando a una possibile quotazione in borsa. L’azienda è stata tra i principali sviluppatori di IA – insieme a OpenAI, Google e xAI di Elon Musk – ad aggiudicarsi contratti con il Pentagono nel corso dell’anno scorso.

Come riportato da Renovatio 21, ancora tre anni fa la Repubblica Popolare stava investendo in piattaforme abilitate all’Intelligenza Artificiale completamente senza input o controllo umano. La Cina vuole l’implementazione militare di robot killer già per la prossima guerra. Pochi mesi fa Israele ha dichiarato l’utilizzo dell’Intelligenza Artificiale negli attacchi aerei.

L’Intelligenza Artificiale è oramai montata, con diversi gradi di realizzazione, su droni, caccia, armi teleguidate, carrarmati, «slaughterbots» e altro ancora.

Come riportato da Renovatio 21, lo scorso giugno è stato rivelato che durante una simulazione un sistema di Intelligenza Artificiale dell’aeronautica americana ha agito per uccidere il suo teorico operatore umano. A gennaio era emerso che caccia cinesi alimentati da Intelligenza Artificiale avevano battuto la concorrenza umana in un arco di soli 90 secondi.

Iscriviti alla Newslettera di Renovatio 21

-

Essere genitori1 settimana fa

Essere genitori1 settimana faBambini nella neve, bambini nel bosco: pedolatria olimpica e pedofobia di sistema

-

Tabarro2 settimane fa

Tabarro2 settimane faInvito alla Tabarrata Nazionale 2026

-

Bioetica1 settimana fa

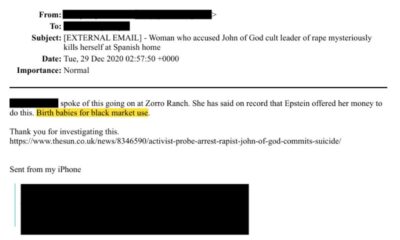

Bioetica1 settimana faAborti traumatici nei file di Epstein

-

Transumanismo2 settimane fa

Transumanismo2 settimane faDal trapianto di organi al trapianto dell’uomo: il sogno post-umano di un neurochirurgo italiano

-

Autismo1 settimana fa

Autismo1 settimana faGli scienziati pubblicano una «mappa» su come l’alluminio nei vaccini può causare lesioni cerebrali che scatenano l’autismo

-

Misteri4 giorni fa

Misteri4 giorni faLe porte del pandemonio di Epstein

-

Sorveglianza1 settimana fa

Sorveglianza1 settimana faPerugia ti aspetta al varco ZTL

-

Misteri6 giorni fa

Misteri6 giorni faAllevamenti di bambini al mercato nero: l’orrore emerge dai file di Epstein