Intelligenza Artificiale

Il «padrino dell’Intelligenza Artificiale» avverte che le macchine superintelligenti potrebbero sostituire l’umanità

Geoffrey Hinton, il pioniere dell’informatica definito il «padrino dell’Intelligenza artificiale», ha lanciato ancora una volta l’allarme: la tecnologia che lui stesso ha contribuito a creare potrebbe segnare la fine dell’umanità così come la conosciamo.

In un’intervista pubblicata il 18 agosto come parte del film di prossima uscita Making God, Hinton ha lanciato uno dei suoi avvertimenti più severi, affermando che l’umanità rischia di essere messa da parte – e alla fine sostituita – da macchine molto più intelligenti di noi.

«La maggior parte delle persone non è in grado di comprendere l’idea che esistano cose più intelligenti di noi», ha affermato nel video lo Hinton, premio Nobel per la fisica ed ex dirigente di Google. «Pensano sempre: come useremo questa cosa? Non pensano mai: come userà noi?»

Sostieni Renovatio 21

Lo scienziato informatico si è detto «abbastanza fiducioso» che l’Intelligenza Artificiale causerà una disoccupazione di massa, citando i primi esempi di colossi tecnologici come Microsoft che hanno sostituito i programmatori junior con l’IA. Ma il pericolo più grande, ha affermato, va ben oltre il mondo del lavoro.

«Il rischio contro cui ho messo in guardia più spesso… è il rischio che sviluppiamo un’Intelligenza Artificiale molto più intelligente di noi, che prenderà il sopravvento», ha affermato Hinton. «Non avrà più bisogno di noi».

L’unico lato positivo, ha scherzato, è che «non ci mangerà, perché sarà fatto di silicio».

Lo Hinton, 77 anni, ha trascorso decenni a essere un pioniere del deep learning, l’architettura di rete neurale alla base degli odierni sistemi di intelligenza artificiale. Le sue scoperte negli anni ’80 – in particolare l’ invenzione della macchina di Boltzmann, in grado di imparare a riconoscere pattern nei dati – hanno contribuito ad aprire le porte al riconoscimento delle immagini e al moderno apprendimento automatico.

Questo lavoro gli è valso il Premio Nobel per la fisica nel 2024, assegnato «per scoperte e invenzioni fondamentali che consentono l’apprendimento automatico con reti neurali artificiali». La Reale Accademia Svedese delle Scienze ha sottolineato come l’uso precoce della fisica statistica da parte di Hinton abbia rappresentato il salto concettuale che ha reso possibile l’attuale rivoluzione dell’AI.

Tuttavia da allora lo Hinton è emerso come uno dei più accaniti critici del settore, avvertendo che il suo rapido sviluppo ha superato la capacità della società di proteggerlo. Nel 2023, si è dimesso dal suo ruolo in Google per poter parlare liberamente dei rischi senza coinvolgere l’azienda.

Nel suo discorso per il Nobel, lo scienziato ha riconosciuto i potenziali benefici dell’intelligenza artificiale, come l’aumento della produttività e nuovi trattamenti medici che potrebbero rappresentare un «meraviglioso progresso per tutta l’umanità». Tuttavia, ha anche avvertito che la creazione di esseri digitali più intelligenti degli umani rappresenta una «minaccia esistenziale».

«Avrei voluto pensare anche alle questioni di sicurezza», ha affermato durante la recente conferenza Ai4 a Las Vegas, riflettendo sulla sua carriera, aggiungendo che ora si rammarica di essersi concentrato esclusivamente sul funzionamento dell’intelligenza artificiale, invece di anticiparne i rischi.

Lo Hinton ha precedentemente stimato che ci sia una probabilità dal 10 al 20% che l’IA possa spazzare via l’umanità. In una puntata di giugno del podcast «The Diary of a CEO», ha affermato che gli ingegneri dietro gli attuali sistemi di IA non comprendono appieno la tecnologia e si dividono sostanzialmente in due gruppi: uno che crede in un futuro distopico in cui gli esseri umani saranno soppiantati, e l’altro che liquida tali paure come fantascienza.

«Penso che entrambe le posizioni siano estreme», ha dichiarato lo Hinton. «Spesso dico che le probabilità che l’IA ci elimini sono dal 10 al 20 percento. Ma è solo un’ipotesi, basata sull’idea che le stiamo ancora costruendo e che siamo piuttosto ingegnosi. E la speranza è che se un numero sufficiente di persone intelligenti farà abbastanza ricerca con risorse sufficienti, troveremo un modo per costruirle in modo che non vogliano mai farci del male».

Iscriviti alla Newslettera di Renovatio 21

Alla conferenza di Las Vegas della scorsa settimana, lo Hinton ha proposto un’idea innovativa su come mitigare il pericolo: invece di cercare di sottomettere i sistemi di intelligenza artificiale, i ricercatori dovrebbero progettarli con «istinti materni» in modo che vogliano proteggere gli esseri umani anche quando diventano più intelligenti.

«Il modello corretto è l’unico modello che abbiamo di una cosa più intelligente controllata da una cosa meno intelligente, ovvero una madre controllata dal suo bambino», ha affermato Hinton alla conferenza. «Saranno molto più intelligenti di noi», ha avvertito, aggiungendo che «l’unico risultato positivo» è che si preoccupino dell’umanità come una madre si preoccupa del proprio figlio.

«Se non mi farà da genitore, mi sostituirà» ha concluso lo scienziato, forse non pienamente conscio della tristezza e della mostruosità di tale affermazione.

Come riportato da Renovatio 21, il mese scorso intervenendo alla Conferenza mondiale sull’intelligenza artificiale (WAIC) di Shanghai lo Hinton aveva esortato i governi di tutto il mondo a collaborare per addestrare i sistemi AI a non danneggiare l’umanità, avvertendo che la tecnologia in rapido progresso probabilmente supererà presto l’intelligenza umana.

Come riportato da Renovatio 21, lo Hinton varie volte aveva suonato l’allarme, dicendo che l’umanità è in pericolo perché l’AI potrebbe rivoltarvisi contro.

Come riportato da Renovatio 21, lo Hinton si è licenziato da Google per poter dichiarare il rischio per l’umanità costituito dall’AI, che per ora, secondo l’informatico britannico sarebbe solo, «moderato».

Elon Musk due anni fa aveva dichiarato durante la sua intervista con Tucker Carlson che il fine di Google – nemmeno così occulto – è quello di creare un dio-Intelligenza Artificiale. Musk, oramai quasi una decina di anni fa aveva parlato del fatto che creare l’AI era «come evocare un demone».

Yann LeCun, Chief AI Scientist presso Meta-Facebook, ha espresso opinioni contrarie a quelle di Hinton, affermando che la tecnologia «potrebbe effettivamente salvare l’umanità dall’estinzione».

Come riportato da Renovatio 21, Bill Gates si oppose alla moratoria. Gates, con cui Musk ha avuto scontri anche gustosi in passato, non ha partecipato alla moratoria internazionale promossa di Musk sul controllo dell’AI, replicando che invece l’AI sarebbe divenuto un ottimo maestro per i bambini e che proprio l’Intelligenza Artificiale salverà la democrazia.

Come riportato da Renovatio 21, in un recente caso davvero inquietante, plurimi utenti di Copilot, l’Intelligenza Artificiale di Microsoft creata in collaborazione con Open AI, hanno testimoniato su X e Reddit che il programma avrebbe una «seconda personalità» preoccupante che chiede l’adorazione degli esseri umani, come un dio crudele.

Aiuta Renovatio 21

Come riportato da Renovatio 21, il mese passato si era registrato l’allarme di un altro pioniere dell’IA, il noto esperto di informatica canadese professore presso l’Università di Montreal e direttore del Montreal Institute for Learning Algorithms Yoshua Bengio (nessuna relazione con l’atletico ragazzo acerrimo nemico dei meganoidi Haran Benjo), che era tra le principali figure del settore, tra cui il CEO di Tesla Elon Musk e il co-fondatore di Apple Steve Wozniak, i quali hanno co-firmato una lettera che chiedeva una regolamentazione aggressiva del settore dell’Intelligenza Artificiale.

«Ci sono persone che potrebbero voler abusare di questo potere, e ci sono persone che potrebbero essere felici di vedere l’umanità sostituita dalle macchine», aveva affermato il Bengio, chiedendo una regolamentazione più severa.

Un ulteriore appello a mettere in pausa lo sviluppo dell’Intelligenza Artificiale è stato firmato da un gruppo internazionale di medici e pubblicato dalla prestigiosa rivista medica BMJ Global Health. «Ci sono scenari in cui l’AGI [Intelligenza Artificiale Generale, ndr] potrebbe rappresentare una minaccia per gli esseri umani, e possibilmente una minaccia esistenziale» scrivono nell’appello i dottori di varie parti del mondo.

Più pessimista è l’esperto dei pericoli dell’AI Eliezer Yudkowsky, che ha lanciato un appello per chiedere la distruzione materiale dei data center dell’AI prima che sia troppo tardi, dichiarando che «tutti sulla Terra moriranno».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

La Florida indaga su OpenAI per le stragi suggerite dai chatbot

Sostieni Renovatio 21

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Cina

Robot cinese infrange il record mondiale umano nella mezza maratona

Domenica, un robot umanoide cinese ha superato migliaia di corridori umani vincendo la mezza maratona di Pechino E-Town e frantumando il record mondiale. All’evento hanno partecipato circa 12.000 persone e oltre 100 macchine antropomorfe automatiche.

L’androide bipede rosso acceso chiamato Lightning, sviluppato dal produttore cinese di smartphone Honor, ha dominato la gara, tagliando il traguardo davanti a tutti i concorrenti umani. Ha percorso la distanza di 21,1 km in soli 50 minuti e 26 secondi, battendo il record mondiale di mezza maratona, stabilito dal corridore ugandese Jacob Kiplimo il mese scorso, di quasi 7 minuti.

China-made “Lightning” robot won first place at the Beijing Robot Marathon!

As a bipedal humanoid robot, it completed the 21 km race in a net time of 48 minutes and 40 seconds—look, it’s getting ready to give an interview. pic.twitter.com/743QIoWVyO

— China pulse 🇨🇳 (@Eng_china5) April 19, 2026

Iscriviti al canale Telegram ![]()

Gli automi si sono classificati anche al secondo e terzo posto, mentre il più veloce tra gli esseri umani a tagliare il traguardo della maratona è stato il ventinovenne Zhao Haijie, che ha completato la gara in 1 ora, 7 minuti e 47 secondi.

This Chinese robot is so fast that the judges couldn’t keep up with it. pic.twitter.com/oVaRwxdwRZ

— China pulse 🇨🇳 (@Eng_china5) April 18, 2026

This Chinese humanoid robot just shattered the world record for a half marathon, finishing in 50 min 26 sec.

This video shows its crash just meters before the finish line where it had to be picked up by a team of humans. The robot is from Honor, the smartphone maker and Huawei… pic.twitter.com/HflDC0rInX

— Kyle Chan (@kyleichan) April 19, 2026

Humanoid robots hit the ground running in the Beijing E-Town humanoid robot half-marathon on Sunday, competing in both autonomous navigation and remote-controlled categories. #marathon #Beijing #HumanoidRobot pic.twitter.com/dxacB1BzH2

— China Xinhua News (@XHNews) April 19, 2026

Aiuta Renovatio 21

In una gara simile svoltasi l’anno scorso, le macchine non erano riuscite a impressionare: il robot più veloce, Tiangong, aveva impiegato 2 ore e 40 minuti per completare la distanza, ben al di sotto degli atleti umani.

A robot was torn apart during a half marathon in China

It simply failed to notice an obstacle, crashed into it — and broke into pieces. Still a long way from being a “Terminator.”

In the end, it had to be removed from the track, with a team brought in to evacuate what was left… pic.twitter.com/E2BEZtmBnW

— NEXTA (@nexta_tv) April 18, 2026

Iscriviti alla Newslettera di Renovatio 21

Nonostante il dominio incontrastato degli androidi nell’edizione di quest’anno, non sono mancati gli incidenti. Un umanoide è stato visto inciampare sulla linea di partenza e poi schiantarsi a faccia in giù sul marciapiede, mentre il personale accorreva con una barella.

Un altro androide ha sbandato contro una barricata nelle fasi finali della gara, ma è riuscito a riprendersi e a tagliare il traguardo, mentre gli ingegneri lo seguivano di corsa stringendo tra le mani i dispositivi di controllo. Un androide ha tagliato il traguardo, per poi deviare bruscamente dal percorso e cadere in un cespuglio.

Gli incidenti dei robotti corridori non sono decisamente mancati.

2026 Robot marathon fail & fun compilation pic.twitter.com/mmeUbrgtPD

— Eren Chen (@ErenChenAI) April 19, 2026

Circa il 40% degli automo antropomorfi ha funzionato in modo autonomo, affrontando curve, terreni irregolari e folle senza bisogno di controllo remoto. Gli altri automi erano invece gestiti da tecnici, con tempi di completamento adattati alle diverse categorie.

La Cina ha designato la robotica umanoide come priorità strategica nazionale e uno dei sei nuovi motori di crescita economica per i prossimi cinque anni, fornendo ingenti sussidi per accelerarne lo sviluppo. Lo stesso sta facendo l’amministrazione Trump.

Come riportato da Renovatio 21 la commissione cinese per la pianificazione economica ha avvertito che l’industria cinese della robotica umanoide rischia di incorrere in una bolla speculativa a causa della frenesia degli investimenti e ha esortato a impedire che l’espansione esplosiva del settore travolga il mercato.

Mentre in Cina già si organizzano tornei di lotta tra androidi, Xiaomi utilizza macchine umanoide nella sua catena di montaggio.

Come riportato da Renovatio 21, la Repubblica Popolare sta investendo in piattaforme abilitate all’AI che spera un giorno condurranno missioni letali, completamente senza input o controllo umano, già per la prossima guerra.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Robocani pattugliano le strade della città e parlano con accento da call center indiano

Atlanta residents react to the new robot dogs patrolling their apartment parking lot

They speak to the dog and there seems to be a live operator talking back The person speaking very clearly is likely in India based on the accent There are plenty of videos of these dogs… pic.twitter.com/01h9kxwyNj — Wall Street Apes (@WallStreetApes) April 12, 2026

Meme of the day! Robots on American streets are being controlled by operators from India

In Atlanta, police officers encountered one of these machines in the evening: the robot dog spoke to them in English with an Indian accent and explained that it was “at work” and monitoring… pic.twitter.com/l98N6hglwk — NEXTA (@nexta_tv) December 29, 2025

Atlanta just hired a robot guard dog for night duty.

No sleep. No breaks. 24/7 patrol. Welcome to the future of security. (Source: @BrianRoemmele ) pic.twitter.com/9SaDlOrzoy — Learn AI Faster (@learnaifaster) November 22, 2025

Robot “dog” patrolling Atlanta, Georgiapic.twitter.com/r5UcFB1MaS

— Massimo (@Rainmaker1973) April 2, 2026

Sostieni Renovatio 21

The new robot security dogs in Atlanta are now giving commands to Americans

Even when this woman peacefully immediately complies with the robot security dog, even being very friendly to the robot. It still calls the police on her What could possibly go wrong here….. pic.twitter.com/DvReKpsq70 — Wall Street Apes (@WallStreetApes) April 1, 2026

Iscriviti al canale Telegram ![]()

-

Pensiero2 settimane fa

Pensiero2 settimane faPerché Trump attacca il papa?

-

Vaccini2 settimane fa

Vaccini2 settimane faElon Musk ha subito danni dal vaccino COVID. Ex dirigente Pfizer ammette: il siero potrebbe aver ucciso migliaia di persone

-

Pensiero2 settimane fa

Pensiero2 settimane faLa vera natura dei progetti di legge sull’antisemitismo. Intervista al prof. Marini

-

Spirito1 settimana fa

Spirito1 settimana faMons. Viganò sullo scontro tra Trump e Leone

-

Bizzarria1 settimana fa

Bizzarria1 settimana faL’uomo nudo continua a terrorizzare l’Italia: l’anarconudismo figlio dell’anarcotirannia

-

Arte1 settimana fa

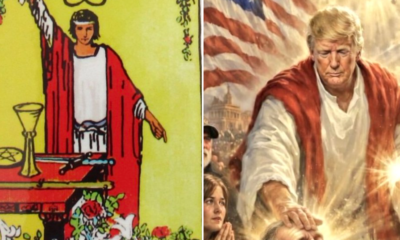

Arte1 settimana faMarina Abramovic definisce Trump «il mago di più alto livello»

-

Occulto2 settimane fa

Occulto2 settimane faLeader del «culto dell’orgasmo», condanna a nove anni di carcere (no, non è chi pensate voi)

-

Psicofarmaci1 settimana fa

Psicofarmaci1 settimana faLo Xanax richiamato in vari stati americani