Intelligenza Artificiale

Corsa verso l’AI atomica: anche Google alimenterà i data center con sette piccoli reattori nucleari

Un altro colosso dell’informatica si avvicina all’energia atomica. Il 14 ottobre Google ha firmato un contratto con Kairos Power per costruire sette reattori nucleari Small Modular Reactors (SMR), scrive il Wall Street Journal.

Il primo reattore dovrebbe essere operativo entro il 2030 e gli altri entro il 2035, ma non è stato rivelato se le centrali elettriche saranno tutte nella stessa struttura o in diverse località.

Questo è considerato tra i primi accordi di questo tipo al mondo per costruire una flotta di centrali elettriche e l’obiettivo è di fornire a Google un totale di 500 megawatt di energia.

Sostieni Renovatio 21

L’accordo necessita ancora dell’approvazione normativa, ma Kairos ha già ottenuto i permessi per il suo impianto dimostrativo nel Tennessee, che dovrebbe essere operativo nel 2027.

Il contratto dimostra fiducia in un sistema energetico costruito in una fabbrica per l’assemblaggio altrove. Ordinando diversi SMR, si ottiene un’economia di scala che riduce i costi rispetto all’acquisto di un solo impianto.

Il design di Kairos utilizza sali di fluoruro fusi come refrigerante al posto dell’acqua come negli impianti nucleari tradizionali. In una struttura di sviluppo ad Albuquerque, nel New Mexico, Kairos sta testando l’assemblaggio e le operazioni dei nuovi impianti, l’affidabilità dei componenti e persino la catena di fornitura necessaria per mantenere gli impianti in funzione.

La domanda di energia negli Stati Uniti sta esplodendo a causa di nuovi data center, Intelligenza Artificiale, cloud storage e veicoli elettrici. Attualmente l’energia nucleare fornisce circa il 20% della domanda elettrica degli Stati Uniti e questa cifra è stagnante da decenni.

La corsa all’energia nucleare di Google segue quella dell’altro colosso dell’informatica mondiale, Microsoft, come rivelato pochi giorni fa.

Come riportato da Renovatio 21, la multinazionale di Bill Gates sarebbe dietro l’inaspettata riapertura della centrale atomica di Three Miles Island, il luogo del peggior incidente ad un reattore nella storia degli Stati Uniti, che sembrava essere stata chiusa definitivamente nel 2019.

Non è chiaro se si tratterà in pratica di un reattore di fatto privato di Microsoft, e non è stato dichiarato nemmeno perché Microsoft ne abbia bisogno – a meno che non si ipotizzi una escalation nell’uso di elettricità dovuto a nuovo super-impianti informatici di Intelligenza Artificiale, che sono in genere estremamente energivori.

Aiuta Renovatio 21

Come riportato da Renovatio 21, Microsoft con OpenAI starebbero preparando segretamente un supercomputer che prevede un investimento di 100 miliardi di dollari per addestrare l’AI avanzata.

Nell’enantiodromia tra i titani tecnologici verso la supermacchina pensante definitiva, deve essere stato compreso dalle parti che l’egemonia AI non sarà possibile senza poter essere alimentata costantemente dalla forma più potente di energia a disposizione, il nucleare.

Pensiamo, a questo punto, quanto l’Italia e l’Europa dei «comuni denuclearizzati» resterà indietro, sottomessa nel mondo del futuro prossimo non solo agli USA ma pure alla loro Intelligenza Artificiale.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

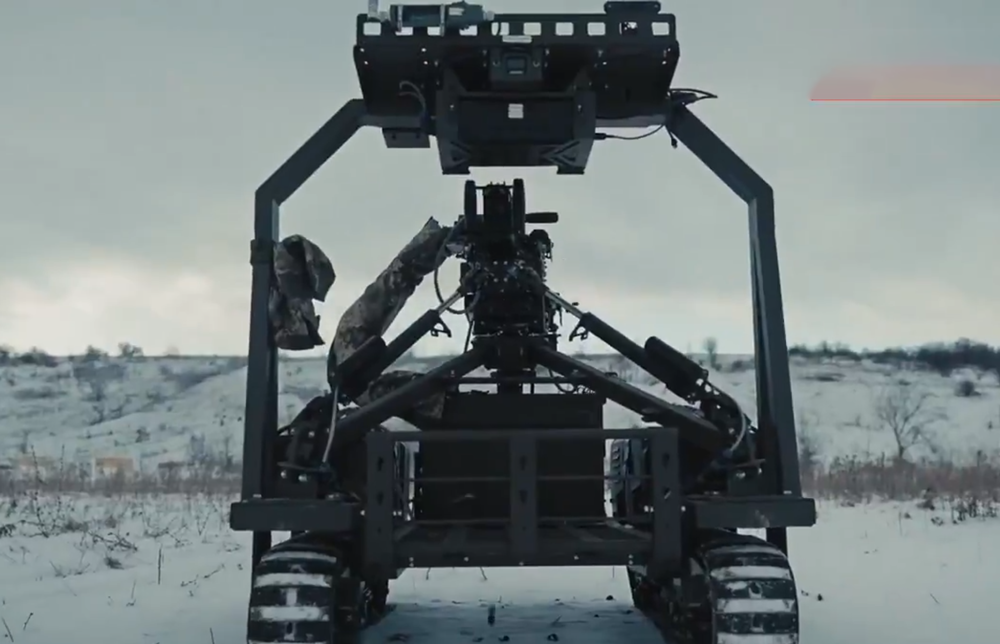

La Russia testa un drone mortaio cingolato con braccio robotico integrato

Future of tactical artillery? Automated 82mm mortar module called “Bagulnik-82” (“wild rosemary”) mounted on Russian “Kuryer” drone platform #ArmoredWarfare pic.twitter.com/XdO4MgzrvW

— Armored Warfare (@ArmoredWar) April 6, 2026

Iscriviti alla Newslettera di Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

L’Ucraina impiega un numero record di 7.000 missioni robotiche contro la Russia in un solo mese

L’Ucraina ha impiegato un numero record di 7.000 missioni robotiche in un solo mese per respingere l’avanzata delle forze russe.

Un operatore di droni ucraino ha dichiarato al giornale brittanica Guardian che il fronte ora «assomiglia più a Terminator» «Un robot terrestre arriva nella tua posizione e non puoi farci niente. Puoi sparare a una persona al petto e questa smette di sparare. Se spari a un robot terrestre, non sente dolore».

Il New York Post spiega: «Quando Kiev ha schierato per la prima volta i robot in prima linea nel 2024, questi erano disponibili in forme e dimensioni limitate. Ora una varietà di droidi assassini può sparare, posare mine e lanciare granate contro il nemico, tra gli altri compiti che hanno portato al numero record di missioni a gennaio».

Proof that remote unmanned robots can now hold infantry positions indefinitely.

TWW127, a Ukrainian robot, sat on position alone for 45 days and did not budge. Daily forward overwatch at contested sector, suppressive fire halting enemy advances.pic.twitter.com/iFuALEp32j— Rohan Paul (@rohanpaul_ai) March 30, 2026

Iscriviti al canale Telegram ![]()

Secondo alcune fonti, a gennaio oltre cento soldati russi si sarebbero arresi ai robot.

Come riportato da Renovatio 21, settimane fa erano circolate immagini di soldati russi che si arrendevano ad un veicolo robotico terrestre TW-7.62, un robot dotato di ruote delle dimensioni di una piccola automobile.

La produzione di robot è sestuplicata nel 2025, rendendo la robotica il settore in più rapida crescita dell’industria della difesa ucraina, con un mercato stimato di 252 milioni di dollari. I robot sono stati impiegati anche per fornire assistenza medica ai soldati ucraini feriti e per la ricerca di mine.

«È molto difficile muoversi a causa dei droni nemici con visuale in prima persona. Per questo utilizziamo sistemi robotici», ha dichiarato Victor Pavlov, tenente del 3° Corpo d’armata ucraino.

Nel 2024, l’Ucraina ha iniziato a impiegare cani «kamikaze» e l’anno scorso sono stati schierati in prima linea piccoli carri armati robotizzati dotati di mitragliatrici.

Come riportato da Renovatio 21, robot umanoidi sarebbero ora testati nel teatro ucraino.

I conflitti in Ucraina e in Medio Oriente hanno dimostrato che la guerra moderna sta diventando sempre più automatizzata, con robot terrestri a basso costo e soprattutto droni, programmi di uccisione basati sull’Intelligenza Artificiale e molte altre tecnologie ora impiegate da vari Paesi.

Robocani sono apparsi nel teatro di guerra ucraino come in quello gazano.

Iscriviti alla Newslettera di Renovatio 21

Immagine screenshot da Twitter

Intelligenza Artificiale

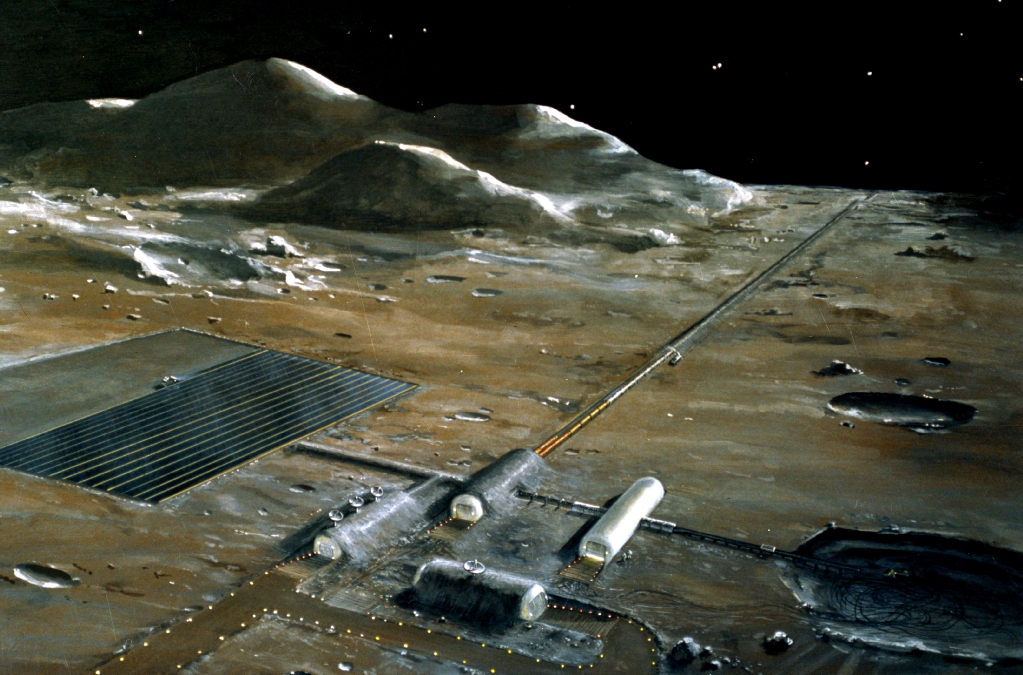

Elon Musk parla di mass driver sulla Luna

Mass drivers on the Moon will be awesome 😎 https://t.co/34aPjVGesn

— Elon Musk (@elonmusk) March 24, 2026

Sostieni Renovatio 21

Se coronato da successo, il dispiegamento di infrastrutture di IA nello spazio ridurrebbe la competizione tra data center e città per l’energia terrestre, consentendo alle operazioni di AI avanzata di espandersi nel vasto e illimitato ambiente energetico della Luna. Sebbene il concetto di un cannone spaziale magnetico esista da quando Edward Fitch Northrup lo teorizzò per la prima volta nel 1937, rimane puramente teorico, non avendo ancora superato la fase di progettazione né raggiunto la superficie lunare. La proposta di Musk per un propulsore lunare è una componente chiave di un più ampio cambiamento strategico annunciato nel febbraio 2026, in cui SpaceX ha dato priorità a una città lunare «autosufficiente» rispetto alla colonizzazione immediata di Marte. Sebbene Marte rimanga la «polizza assicurativa» a lungo termine dell’umanità come secondo pianeta da essa abitato po essere stato colonizzato o «terraformato», la Luna costituirebbe ora ora la priorità industriale immediata. Dal punto di vista logistico, la Luna offre finestre di lancio ogni 10 giorni, rispetto ai 26 mesi di attesa necessari per Marte. Gli scettici, tuttavia, stanno già facendo notare i calcoli impressionanti. I critici sostengono che per lanciare oltre un milione di tonnellate di materiale necessario a raggiungere un petawatt di potenza sarebbero necessari circa 135 lanci di Starship al giorno. «Spingeremo al limite le leggi della fisica nel campo dell’informatica e faremo cose folli e incredibili», ha detto Musk. «Voglio vivere abbastanza a lungo da vedere il lanciatore di massa sulla Luna», ha aggiunto. L’altra ambiziosa visione di Musk è quella di realizzare una fabbrica lunare che utilizzi la robotica per produrre satelliti dotati di IA e alimentati a energia solare, che verrebbero poi lanciati in una rete orbitale distribuita tramite la porpulsione elettromagnetica del mass driver. Sono in fase di valutazione due progetti principali: i cannoni a rotaia, che utilizzano un singolo e potente impulso di forza, e i cannoni a bobina, che impiegano una sequenza di magneti temporizzati per fornire un’accelerazione costante e controllata. Quest’ultimo sembra essere la scelta preferibile per la protezione di carichi sensibili di Intelligenza Artificiale. La storia dei mass driver (o catapulte elettromagnetiche) affonda le radici nella fantascienza e nella fisica applicata. Il primo concetto ingegneristico appare nel 1937 nel romanzo Zero to Eighty del fisico princetoniano Edwin Fitch Northrup (pubblicato con il nom de plume Akkad Pseudoman), che descrisse e costruì prototipi di «electric guns» basati su bobine. L’idea moderna nasce nel 1974 grazie ad un ulteriore fisico princetoniano, il teorico delle colonie spaziali orbitanti Gerard K. O’Neill, che propose appunto i mass driver per lanciare materiali dalla Luna verso i punti di Lagrange (soprattutto L5), dove costruire grandi habitat spaziali – i cosiddetti «cilindri di O’Neill» visibili nella pellicola 2001 Odissea nello Spazio o nelle serie di anime Gundam – senza dover usare costosi razzi chimici. L’obiettivo era sfruttare le risorse lunari per costruire industrie e colonie nello spazio, riducendo drasticamente i costi di lancio.Mass drivers on the moon will be installed by Optimus. pic.twitter.com/PgtzhmeuFh

— Gary Mark⚡️Blue Sky Kites 𝕏 🈴 (@blueskykites) March 24, 2026

Aiuta Renovatio 21

-

Pensiero2 settimane fa

Pensiero2 settimane faPizzaballa incontra il privilegio israeliano. Aspettando il Golem e l’Anticristo

-

Spirito2 settimane fa

Spirito2 settimane faMons. Viganò, la Chiesa e l’intronizzazione dell’«arcivescova» anglicana: «Leone abbraccia l’eresia ecumenista»

-

Salute2 settimane fa

Salute2 settimane faI malori della 13ª settimana 2026

-

Occulto1 settimana fa

Occulto1 settimana faMassoni accusati di aver assassinato un pilota d’auto e di aver tentato di uccidere altre persone

-

Eutanasia2 settimane fa

Eutanasia2 settimane faEutanatizzata dopo essere stata vittima di stupro di gruppo: ecco l’Europa moderna

-

Arte2 settimane fa

Arte2 settimane faL’Iran sta facendo propaganda con fantasiosi video AI

-

Psicofarmaci6 giorni fa

Psicofarmaci6 giorni fa«Nessuno me l’aveva detto»: un’ex paziente psichiatrica denuncia i pericolosi effetti collaterali degli psicofarmaci

-

Sorveglianza7 giorni fa

Sorveglianza7 giorni faOltre il Green Pass: l’OMS con un’azienda legata a Pfizer e Bill Gates lavora ai passaporti vaccinali globali