Intelligenza Artificiale

Le cliniche della fecondazione in vitro usano l’intelligenza artificiale per decidere quali bambini far nascere

L’Intelligenza Artificiale viene utilizzata nelle cliniche per la fertilità australiane per aiutare a scegliere quali embrioni trasferire nei pazienti, con il potenziale di essere disumanizzante per genitori e bambini. Lo riporta il Sydney Herald.

L’articolo pone questioni di bioetica, considerando che consentire all’apprendimento automatico di prendere decisioni su «chi viene messo al mondo» senza una supervisione etica della sua introduzione potrebbe erodere la fiducia del pubblico nelle cliniche per la fertilità.

La professoressa Catherine Mills, responsabile del gruppo di ricerca Reproduction in Society della Monash University e una degli autori dello studio, ha affermato che i pazienti sottoposti a fecondazione in vitro e i loro partner potrebbero non sapere se è stata utilizzata l’Intelligenza Artificiale per aiutarli a selezionare quali embrioni utilizzare, o in che modo gli algoritmi sono stati addestrati per effettuare la loro scelta.

«Questo è un po’ come sbattere la porta della stalla ben chiusa dopo che i buoi sono già scappati attraverso il campo» commenta LifeSite. Le strutture di fecondazione in vitro decidono già “chi viene messo al mondo”: si tratta di decidere a quale di quegli esseri umani è consentito nascere, se effettivamente sopravvivono al processo».

«Una volta deciso che era accettabile mercificare gli esseri umani creandoli artificialmente come un prodotto da acquistare, era inevitabile che avremmo iniziato ad applicare criteri selettivi per stabilire quali embrioni avrebbero avuto un’ulteriore possibilità di vita. Infatti, lo facciamo già di routine e gli aborti “di riduzione selettiva” sono spesso utilizzati per raggiungere ulteriormente questo obiettivo».

Tuttavia, l’uso dell’Intelligenza Artificiale nel processo di produzione di esseri umani in laboratorio, da selezionare, sacrificare ed impiantare per la gioia delle coppie borghesi omo-eterosessuali immerse nella Necrocultura, sembra tuttavia toccare un tasto inaspettato.

«L’Intelligenza Artificiale comporta un rischio di pregiudizio involontario, secondo il documento pubblicato dalla Società europea di riproduzione umana ed embriologia» scrive il Sydney Herald. «Ciò include che gli algoritmi di Machine Learning funzioneranno meglio per i membri di alcuni gruppi rispetto ad altri (ad esempio in base all’etnia)».

La tecnologia quindi potrebbe «tenere conto di caratteristiche che i pazienti non vorrebbero influenzare nella scelta dell’embrione (ad esempio se è più probabile che il sistema di Intelligenza Artificiale raccomandi il trasferimento di embrioni di un sesso particolare o, teoricamente, embrioni con tratti di malattia che risultano correlati a una maggiore probabilità di impianto)».

È bene ricordare che tutto ciò già avviene oggi nelle cliniche di riproduzione artificiali create dallo Stato moderno. Semplicemente, qui si introduce, come era inevitabile che fosse, la tecnologia dell’ora presente.

L’articolo australiano ha osservato che «il fiorente settore della fertilità» degli antipodi è «stimato a 922,9 milioni di dollari USA (1,49 miliardi di dollari) nel 2023 e si prevede che raggiungerà 1,63 miliardi di dollari USA entro il 2030». Alcune strutture stanno semplificando il processo con l’Intelligenza Artificiale, al fine di «migliorare la selezione degli embrioni e le possibilità di gravidanze di successo e ridurre i tempi di gravidanza e i costi dei trattamenti».

«E perché no? L’esistenza di un’”industria della fertilità” conferma già le premesse alla base dell’uso di tale tecnologia» commenta giustamente LifeSite.

Il bioeticista Julian Koplin afferma che la preoccupazione principale è che non ci sono linee guida o regolamenti: «potrebbe essere il caso che ci sia qualcuno che non vuole che le decisioni su quali figli avere vengano prese dall’IA piuttosto che da un embriologo umano che le valuta da solo».

Gli algoritmi «stanno iniziando a prendere decisioni su chi viene messo al mondo… In particolare se l’IA aiuta le persone ad avere una fecondazione in vitro più economica, veloce e meno emotivamente estenuante, allora sembra una buona cosa, ma dato che sta intromettendosi in qualcosa di molto importante per molte persone, i loro piani familiari, è importante che siano informati, abbiano alternative e non siano tenuti a utilizzare la tecnologia, e a dare il consenso informato».

Come riportato da Renovatio 21, già da tempo esistono bambini venuti al mondo tramite fecondazione in vitro robotica.

Iscriviti al canale Telegram ![]()

Si tratta, chiaramente dell’alba di un mondo distopico di eugenetica assoluta, nemmeno più mediata da esseri umani (come avveniva nei sogni di Hitler, e come avviene nella realtà dell’ora presente sotto casa vostra), ma totalmente comandata dalla macchina.

È l’era della tecnocrazia riproduttiva, e ci stiamo dentro – il passo successivo, lo sappiamo, è la scelta dei tratti genetici (eugenetici) del bambino, che giocoforza sarà introdotta a brevissimo.

Il resto dell’umanità, con le persone nate secondo natura, potrebbe finire emarginato, ghettizzato – anche da leggi dello Stato, e il siero genico sperimentale con il suo pass ne sono stati un referendum. Esattamente come nel film Gattacca, o anche oltre: sulla base di quanto abbiamo visto in questi anni, immaginiamo spesso su Renovatio 21 un futuro dove la riproduzione naturale sarà semplicemente proibita.

A quel punto, potrebbe essere che a comandare anche quel che resta della continuazione della forma umana sulla terra sarà la macchina. Ma – domanda che oramai è il caso di porsi seriamente – chi comanda la macchina?

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Olandese 62enne sposa chatbot

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Armi biologiche

I grandi gruppi IA sostengono le normative sul DNA per limitare il rischio di armi biologiche

I dirigenti delle principali aziende di Intelligenza Artificiale si sono uniti agli esperti di biotecnologie in un appello urgente per rendere obbligatori i controlli di sicurezza per l’acquisto di DNA sintetico. In una lettera pubblica indirizzata al Congresso degli Stati Uniti, i firmatari sostengono che i rapidi progressi nell’IA potrebbero aumentare il rischio di sviluppo di armi biologiche.

L’appello, pubblicato all’inizio di questa settimana, è stato firmato da Demis Hassabis di Google DeepMind, Sam Altman di OpenAI, Dario Amodei di Anthropic e Mustafa Suleyman ed Eric Horvitz di Microsoft AI. A loro si sono uniti decine di esperti provenienti dai settori delle biotecnologie, della sintesi del DNA e della sicurezza nazionale.

Il DNA sintetico si riferisce a materiale genetico prodotto artificialmente che può essere ordinato online e spedito come qualsiasi altro materiale da laboratorio. Sebbene la lettera sia indirizzata al Congresso, i firmatari hanno sottolineato che il problema è globale, poiché il DNA sintetico può essere acquistato e trasportato oltre confine.

«La possibilità di ordinare DNA sintetico online ha accelerato lo sviluppo dei vaccini, ha potenziato la ricerca di base e ha permesso a piccoli team di accedere a capacità che un tempo erano appannaggio esclusivo delle grandi istituzioni», si legge nella lettera.

Iscriviti alla Newslettera di Renovatio 21

Sebbene il DNA sintetico abbia una vasta gamma di usi legittimi, tra cui lo sviluppo di farmaci salvavita, la modifica genetica dei microrganismi e persino l’archiviazione di grandi quantità di dati digitali, comporta anche dei rischi, secondo l’appello. In teoria, soggetti malintenzionati potrebbero ordinare sequenze di DNA progettate per ricreare agenti patogeni pericolosi, avvertono i firmatari.

Sebbene alcune aziende effettuino già volontariamente controlli su clienti e ordini, non esiste alcun obbligo legale in tal senso. Gli autori della lettera hanno descritto questi controlli come «una delle misure di biosicurezza più conosciute e meno invasive attualmente disponibili».

I firmatari hanno inoltre richiesto l’obbligo di tenuta dei registri per facilitare il tracciamento delle attività sospette. Oltre a supportare le indagini, gli autori hanno sostenuto che la semplice consapevolezza della tracciabilità degli ordini potrebbe scoraggiare gli abusi.

Gli autori hanno affermato che la minaccia di fondo non è nuova, ma hanno sostenuto che il ritmo senza precedenti dello sviluppo dell’IA sta cambiando le carte in tavola. I sistemi di IA odierni, hanno osservato, sono già in grado di superare le prestazioni di virologi con dottorato di ricerca in quesiti che coinvolgono procedure di laboratorio altamente complesse.

Secondo quanto avvertito, con il miglioramento di questi sistemi, le barriere in termini di conoscenza e competenze che storicamente hanno limitato l’accesso alle armi biologiche potrebbero essere significativamente ridotte.

Iscriviti al canale Telegram ![]()

L’allarme per la connessione tra IA e armi biologiche non è cosa nuova.

Come riportato da Renovatio 21, un ricercatore esperto di sicurezza di Anthropic che aveva lavorato sul fronte delle armi biologiche si licenziò lasciando un monito preciso. «Il mondo è in pericolo. E non solo per via dell’Intelligenza Artificiale o delle armi biologiche, ma a causa di un insieme di crisi interconnesse che si stanno verificando proprio ora», ha scritto Mrinank Sharma rivolgendosi ai colleghi.

Il timore per le armi biologiche create dell’AI era presente anche in una lettera che 60 figure del movimento MAGA avevano indirizzato al presidente Trump chiedendo controlli sullo sviluppo dell’Intelligenza Artificiale. «I sistemi aeronautici sono sottoposti a una rigorosa certificazione. I sistemi di Intelligenza Artificiale più potenti, che ora possono, o presto potranno, contribuire alla progettazione di armi biologiche, all’infiltrazione in infrastrutture critiche o alla manipolazione dei mercati finanziari, dovrebbero essere trattati con la stessa serietà e attenzione» hanno scritto i firmatari, tra i quali spiccava il nome di Steve Bannon.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

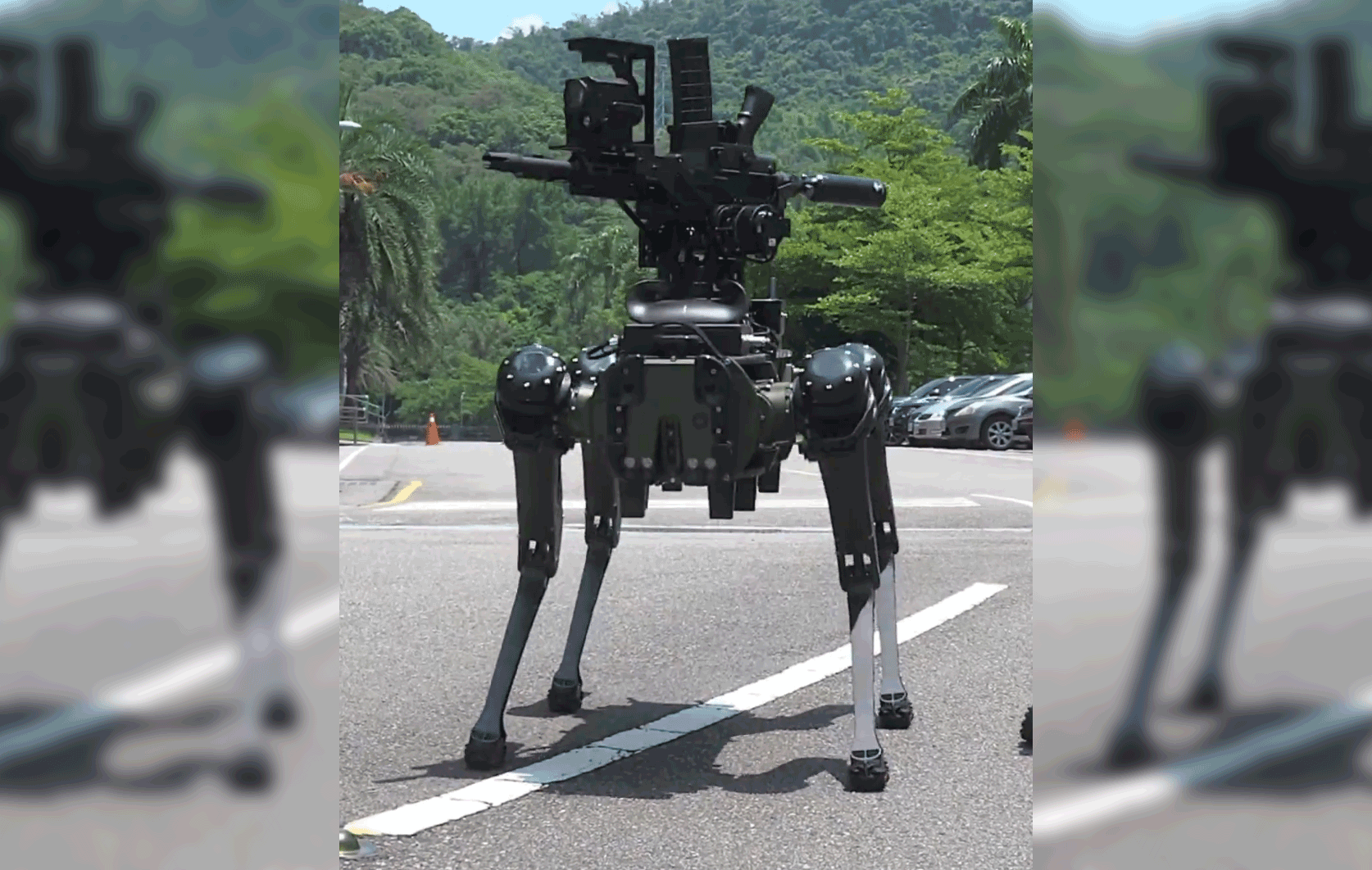

Taiwan presenta i suoi robocani armati

Rebels in Taiwan unveil armed robotic dogs pic.twitter.com/7h3n0VPO7b

— China pulse 🇨🇳 (@Eng_china5) June 2, 2026

Sostieni Renovatio 21

🤖🐶Who do you think will win in the fireworks showdown between Chinese drones and robotic dogs? #ChinaLife #robotic #dog #drones #fireworks #funny @QiushiJournal @RibiaoChen @SpoxCHNinUS @SLembassycn @Chinaembmanila pic.twitter.com/tNhpRRUvlI

— Hola Fujian (@HolaFujian) January 26, 2025

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Essere genitori2 settimane fa

Essere genitori2 settimane faI bambini che libereranno Faccetta nera

-

Spirito2 settimane fa

Spirito2 settimane faBreve commento di mons. Viganò sull’enciclica di Leone sull’IA

-

Spirito2 settimane fa

Spirito2 settimane faBoy scout rifiuta di inchinarsi ad Allah durante una visita in moschea

-

Stragi1 settimana fa

Stragi1 settimana faCani e droni killer negli ospedali, stupri sistemici, affamati usati come pratica di tiro: chirurgo racconta gli orrori di Gaza

-

Intelligenza Artificiale2 settimane fa

Intelligenza Artificiale2 settimane faL’enciclica sull’IA è stata scritta con l’IA?

-

Gender2 settimane fa

Gender2 settimane fa«L’omosessualità è un disturbo mentale»: psichiatra ad un congresso medico

-

Armi biologiche1 settimana fa

Armi biologiche1 settimana faDocumenti desecretati collegano l’epidemia di Lyme al programma statunitense di armi biologiche

-

Stato7 giorni fa

Stato7 giorni faQuando fuggono i cavalli della Repubblica