Intelligenza Artificiale

L’ex scienziato capo di OpenAI lancia SSI per concentrarsi sulla «sicurezza» dell’IA

Il co-fondatore ed ex capo scienziato di OpenAI, Ilya Sutskever, e l’ex ingegnere di OpenAI Daniel Levy hanno unito le forze con Daniel Gross, un investitore ed ex partner dell’acceleratore di startup Y Combinator, per creare Safe Superintelligence, Inc. (SSI). L’obiettivo e il prodotto della nuova azienda sono evidenti già dal nome.

SSI è una società statunitense con uffici a Palo Alto e Tel Aviv. Farà avanzare l’intelligenza artificiale (AI) sviluppando sicurezza e capacità in tandem, hanno affermato i tre fondatori in un annuncio online il 19 giugno.

«Il nostro focus unico non implica alcuna distrazione da parte delle spese generali di gestione o dei cicli di prodotto, e il nostro modello di business significa che la sicurezza, la protezione e il progresso sono tutti isolati dalle pressioni commerciali a breve termine» hanno dichiarato.

Iscriviti al canale Telegram ![]()

Sutskever ha lasciato OpenAI il 14 maggio. Era stato coinvolto nello strano licenziamento del CEO Sam Altman e ha svolto un ruolo ambiguo nella società dopo essersi dimesso dal consiglio dopo il ritorno di Altman. Daniel Levy è stato tra i ricercatori che hanno lasciato OpenAI pochi giorni dopo Sutskever.

Sutskever e Jan Leike erano i leader del team Superalignment di OpenAI creato nel luglio 2023 per considerare come «guidare e controllare i sistemi di intelligenza artificiale molto più intelligenti di noi». Tali sistemi sono indicati come intelligenza generale artificiale (AGI). OpenAI ha assegnato il 20% della sua potenza di calcolo al team di Superalignment al momento della sua creazione.

Anche Leike ha lasciato OpenAI a maggio ed è ora a capo di un team presso la startup di intelligenza artificiale Anthropic, sostenuta da Amazon. OpenAI ha difeso le sue precauzioni relative alla sicurezza in un lungo post X del presidente dell’azienda Greg Brockman, ma ha sciolto il team di Superalignment dopo la partenza dei suoi ricercatori a maggio.

Gli ex ricercatori di OpenAI sono tra i tanti scienziati preoccupati per la direzione futura dell’intelligenza artificiale.

Nel bel mezzo del turnover del personale di OpenAI co-fondatore di Ethereum Vitalik Butertin aveva definito AGI «rischioso».

Aveva tuttavia aggiunto che «tali modelli sono anche molto più bassi in termini di rischio catastrofico rispetto sia alla megalomania aziendale che ai militari».

«Questa azienda è speciale in quanto il suo primo prodotto sarà la superintelligenza sicura, e fino ad allora non farà nient’altro», dice Sutskever in un’intervista esclusiva a Bloomberg sui suoi piani.

«Sarà completamente isolato dalle pressioni esterne derivanti dal dover gestire un prodotto grande e complicato e dal dover rimanere bloccato in una corsa al successo competitiva”.

Il CEO di Tesla Elon Musk, considerabile come fondatore di OpenAI, e il co-fondatore di Apple Steve Wozniak erano tra gli oltre 2.600 leader e ricercatori tecnologici che hanno sollecitato la sospensione dell’addestramento dei sistemi di intelligenza artificiale per sei mesi mentre l’umanità rifletteva sul «profondo rischio» che rappresentavano.

Musk ha risposto a un post su X che evidenziava il potenziale che tutto questo andasse molto storto: «sulla base delle convenzioni di denominazione stabilite da OpenAI e StabilityAI, questa potrebbe essere la società di intelligenza artificiale più pericolosa mai vista».

Elon, che dice di non aver animosità nei confronti di Sutskever, ha rivendicato di averlo in pratica assunto lui al momento della fondazione di OpenAI, all’epoca società no-profit. Musk pochi giorni fa ha ritirato la causa intentata ad OpenAI.

Aiuta Renovatio 21

L’annuncio della SSI rileva che la società sta assumendo ingegneri e ricercatori.

«Per sicuro intendiamo sicuro come la sicurezza nucleare in contrapposizione a sicuro come “fiducia e sicurezza”», afferma Sutskever. Sutskever rifiuta di nominare i sostenitori finanziari di Safe Superintelligence o di rivelare quanto ha raccolto.

Come riportato da Renovatio 21, l’idea che l’AI diventerà una sorta di dio circola da anni e investe direttamente personale di OpenAI come il capo scientifico e cofondatore Ilya Sutskever, il quale ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità».

Nel 2022, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

Intelligenza Artificiale

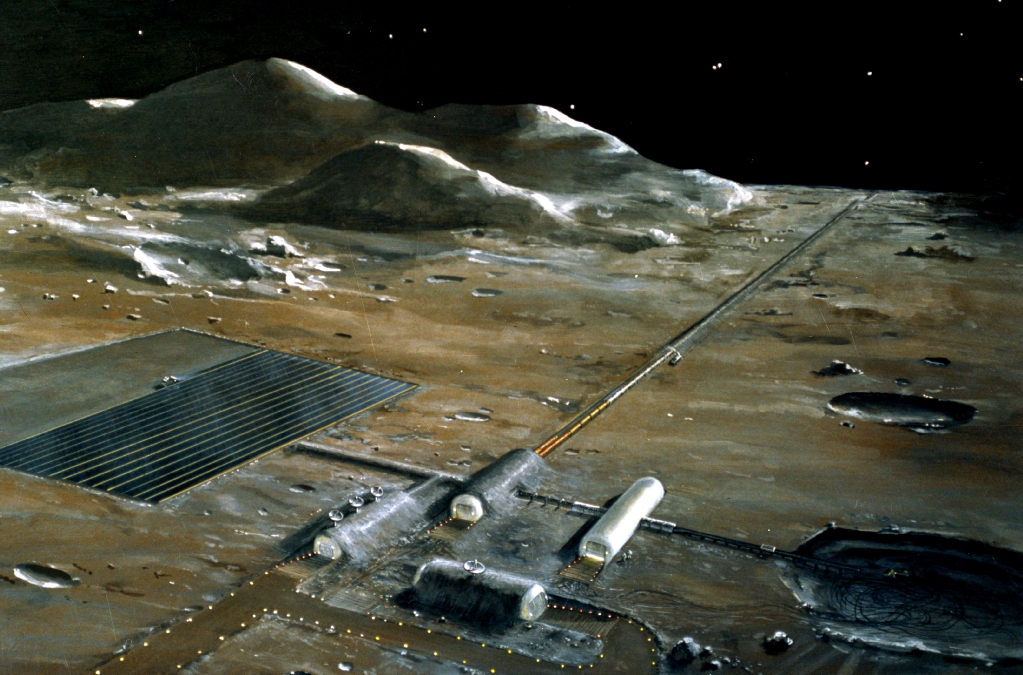

Elon Musk parla di mass driver sulla Luna

Mass drivers on the Moon will be awesome 😎 https://t.co/34aPjVGesn

— Elon Musk (@elonmusk) March 24, 2026

Sostieni Renovatio 21

Se coronato da successo, il dispiegamento di infrastrutture di IA nello spazio ridurrebbe la competizione tra data center e città per l’energia terrestre, consentendo alle operazioni di AI avanzata di espandersi nel vasto e illimitato ambiente energetico della Luna. Sebbene il concetto di un cannone spaziale magnetico esista da quando Edward Fitch Northrup lo teorizzò per la prima volta nel 1937, rimane puramente teorico, non avendo ancora superato la fase di progettazione né raggiunto la superficie lunare. La proposta di Musk per un propulsore lunare è una componente chiave di un più ampio cambiamento strategico annunciato nel febbraio 2026, in cui SpaceX ha dato priorità a una città lunare «autosufficiente» rispetto alla colonizzazione immediata di Marte. Sebbene Marte rimanga la «polizza assicurativa» a lungo termine dell’umanità come secondo pianeta da essa abitato po essere stato colonizzato o «terraformato», la Luna costituirebbe ora ora la priorità industriale immediata. Dal punto di vista logistico, la Luna offre finestre di lancio ogni 10 giorni, rispetto ai 26 mesi di attesa necessari per Marte. Gli scettici, tuttavia, stanno già facendo notare i calcoli impressionanti. I critici sostengono che per lanciare oltre un milione di tonnellate di materiale necessario a raggiungere un petawatt di potenza sarebbero necessari circa 135 lanci di Starship al giorno. «Spingeremo al limite le leggi della fisica nel campo dell’informatica e faremo cose folli e incredibili», ha detto Musk. «Voglio vivere abbastanza a lungo da vedere il lanciatore di massa sulla Luna», ha aggiunto. L’altra ambiziosa visione di Musk è quella di realizzare una fabbrica lunare che utilizzi la robotica per produrre satelliti dotati di IA e alimentati a energia solare, che verrebbero poi lanciati in una rete orbitale distribuita tramite la porpulsione elettromagnetica del mass driver. Sono in fase di valutazione due progetti principali: i cannoni a rotaia, che utilizzano un singolo e potente impulso di forza, e i cannoni a bobina, che impiegano una sequenza di magneti temporizzati per fornire un’accelerazione costante e controllata. Quest’ultimo sembra essere la scelta preferibile per la protezione di carichi sensibili di Intelligenza Artificiale. La storia dei mass driver (o catapulte elettromagnetiche) affonda le radici nella fantascienza e nella fisica applicata. Il primo concetto ingegneristico appare nel 1937 nel romanzo Zero to Eighty del fisico princetoniano Edwin Fitch Northrup (pubblicato con il nom de plume Akkad Pseudoman), che descrisse e costruì prototipi di «electric guns» basati su bobine. L’idea moderna nasce nel 1974 grazie ad un ulteriore fisico princetoniano, il teorico delle colonie spaziali orbitanti Gerard K. O’Neill, che propose appunto i mass driver per lanciare materiali dalla Luna verso i punti di Lagrange (soprattutto L5), dove costruire grandi habitat spaziali – i cosiddetti «cilindri di O’Neill» visibili nella pellicola 2001 Odissea nello Spazio o nelle serie di anime Gundam – senza dover usare costosi razzi chimici. L’obiettivo era sfruttare le risorse lunari per costruire industrie e colonie nello spazio, riducendo drasticamente i costi di lancio.Mass drivers on the moon will be installed by Optimus. pic.twitter.com/PgtzhmeuFh

— Gary Mark⚡️Blue Sky Kites 𝕏 🈴 (@blueskykites) March 24, 2026

Aiuta Renovatio 21

Intelligenza Artificiale

Un tribunale statunitense si pronuncia contro il Pentagono nella controversia sull’Intelligenza Artificiale letale

Un giudice federale statunitense ha bloccato un ordine del Pentagono che designava Anthropic come una minaccia per la sicurezza nazionale, affermando che i funzionari statunitensi hanno probabilmente violato la legge e si sono vendicati contro l’azienda di intelligenza artificiale per i suoi commenti pubblici su come la sua tecnologia dovrebbe essere utilizzata.

Anthropic, azienda leader nello sviluppo di modelli linguistici complessi, è coinvolta in una controversia con il Dipartimento della Guerra statunitense in merito all’utilizzo militare del suo sistema Claude, con i funzionari della difesa che premono per consentire l’impiego della tecnologia per «tutti gli usi leciti».

L’azienda si era opoosta, esprimendo preoccupazione per la possibilità che il sistema potesse essere utilizzato per la sorveglianza di massa sul territorio nazionale o per la creazione di armi completamente autonome. Il Pentagono interruppe i negoziati, impose la designazione e ordinò agli appaltatori di interrompere l’utilizzo di Claude.

Giovedì, la giudice distrettuale statunitense Rita Lin ha inoltre bloccato un ordine di rescissione di tutti i contratti governativi con Anthropic, definendolo una «classica» ritorsione ai sensi del Primo Emendamento.

«Nulla nella legge in materia avvalora l’idea orwelliana che un’azienda americana possa essere etichettata come potenziale avversario… per aver espresso disaccordo con il governo», ha scritto Lin, sottolineando che tale qualifica è in genere riservata a «agenzie di Intelligence straniere, terroristi e altri soggetti ostili».

Iscriviti al canale Telegram ![]()

Lunedì Anthropic ha intentato causa contro l’amministrazione del presidente statunitense Donald Trump, definendo la mossa «senza precedenti e illegale» e sostenendo che si tratti di una ritorsione per le sue critiche alla politica governativa.

«La Costituzione non consente al governo di esercitare il suo enorme potere per punire un’azienda per aver espresso un’opinione tutelata dalla legge», ha dichiarato l’azienda nella sua denuncia.

Il mese scorso Trump ha ordinato a tutte le agenzie federali statunitensi, incluso il Pentagono, di interrompere l’utilizzo della tecnologia di Anthropic, concedendo all’esercito un periodo di sei mesi per la dismissione graduale dei sistemi già in uso.

Il segretario alla Guerra Pete Hegseth ha accusato l’azienda di «arroganza e tradimento», affermando che il Pentagono si sarebbe orientato verso un’alternativa «più patriottica». Il dipartimento ha quindi raggiunto un accordo con OpenAI, il cui CEO, Sam Atman, ha dichiarato che l’accordo include garanzie contro la sorveglianza di massa sul territorio nazionale e richiede la supervisione umana nell’uso della forza.

Anthropic ha avvertito che tali azioni hanno destato preoccupazione tra i clienti, compresi quelli senza legami con il governo federale, e potrebbero costare all’azienda miliardi di dollari in mancati ricavi futuri. Alcune agenzie, tra cui il Dipartimento della Salute e dei Servizi Umani e la General Services Administration, avrebbero già ritirato i suoi prodotti.

Anthropic è stato il primo sviluppatore commerciale di AI a implementare modelli linguistici di grandi dimensioni su reti classificate del Pentagono, nell’ambito di un contratto del valore di 200 milioni di dollari. Il suo chatbot Claude è stato utilizzato per analisi di intelligence, simulazioni operative, operazioni informatiche e flussi di lavoro di pianificazione.

Lo scontro emerso segue alle accuse secondo cui il modello di Intelligenza Artificiale dell’azienda sarebbe stato utilizzato durante l’operazione per rapire il presidente venezuelano Nicolas Maduro all’inizio di gennaio.

Come riportato da Renovatio 21, negli ultimi mesi vi è stato un progressivo deterioramento dei rapporti tra Anthropic e il Pentagono, legato alla volontà del dipartimento della Guerra statunitense di utilizzare l’IA per il controllo di armi autonome senza le garanzie di sicurezza che l’azienda ha cercato di imporre.

Il CEO di Anthropic, Dario Amodei, ha più volte espresso gravi preoccupazioni sui rischi della tecnologia che la sua azienda sta sviluppando e commercializzando. In un lungo saggio di quasi 20.000 parole pubblicato il mese scorso, ha avvertito che sistemi AI dotati di «potenza quasi inimmaginabile» sono «imminenti» e metteranno alla prova «la nostra identità come specie».

Amodei ha messo in guardia dai «rischi di autonomia», in cui l’IA potrebbe sfuggire al controllo e sopraffare l’umanità, e ha ipotizzato che la tecnologia potrebbe facilitare l’instaurazione di «una dittatura totalitaria globale» attraverso sorveglianza di massa basata sull’Intelligenza Artificiale e l’impiego di armi autonome.

Come riportato da Renovatio 21, l’anno passato l’Amodei ha dichiarato che l’AI potrebbe eliminare la metà di tutti i posti di lavoro impiegatizi di livello base entro i prossimi cinque anni.

Lo scorso mese Mrinank Sharma, fino a poco tempo fa responsabile del Safeguards Research Team presso l’azienda sviluppatrice del chatbot Claude, ha pubblicato su X la sua lettera di dimissioni, in cui scrive che «il mondo è in pericolo. E non solo per via dell’Intelligenza Artificiale o delle armi biologiche, ma a causa di un insieme di crisi interconnesse che si stanno verificando proprio ora».

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

OpenAI chiude l’app video Sora

We’re saying goodbye to the Sora app. To everyone who created with Sora, shared it, and built community around it: thank you. What you made with Sora mattered, and we know this news is disappointing.

We’ll share more soon, including timelines for the app and API and details on… — Sora (@soraofficialapp) March 24, 2026

Iscriviti al canale Telegram ![]()

Nel frattempo, la chiusura di Sora precede anche una potenziale IPO di OpenAI, che secondo alcune indiscrezioni potrebbe concretizzarsi entro la fine dell’anno. Gli analisti interpretano la mossa come una strategia di riduzione dei costi, dato che la generazione di video tramite intelligenza artificiale richiede una potenza di calcolo elevata, per la quale OpenAI ha faticato a trovare un modello di business sostenibile. Alcune fonti suggeriscono che le priorità interne si stiano spostando verso aree commercialmente più redditizie, come i «collaboratori» basati sull’IA e la robotica. OpenAI ha dichiarato che a breve fornirà dettagli sulla tempistica di chiusura e su come gli utenti potranno salvare i propri video. SOSTIENI RENOVATIO 21 Immagine screenshot da YouTubeRIP Sora, you gave us the greatest ai video of all time https://t.co/Hd4vbqyw95 pic.twitter.com/37z1IdgBjZ

— spor (@sporadica) March 24, 2026

-

Sanità2 settimane fa

Sanità2 settimane faUna «separazione delle carriere» per chi giudica i medici. Intervista al dottor Giacomini del sindacato DI.CO.SI.

-

Vaccini1 settimana fa

Vaccini1 settimana faStudio su oltre un milione di bambini rileva la miocardite solo nei bambini vaccinati

-

Pensiero1 settimana fa

Pensiero1 settimana faMao e il «blocco storico» che ha vinto il referendum

-

Pensiero2 settimane fa

Pensiero2 settimane faPerché votiamo Sì al referendum

-

Vaccini1 settimana fa

Vaccini1 settimana faProposte di legge USA per definire i vaccini a mRNA contro il COVID «armi di distruzione di massa»

-

Necrocultura2 settimane fa

Necrocultura2 settimane faVolontà politica e Stato moderno: Renovatio 21 saluta Bossi il disintegratore

-

Pensiero3 giorni fa

Pensiero3 giorni faPizzaballa incontra il privilegio israeliano. Aspettando il Golem e l’Anticristo

-

Occulto2 settimane fa

Occulto2 settimane faEmergono ulteriori foto del futuro papa Leone al rito idolatrico della Pachamama