Intelligenza Artificiale

ChatGPT molla l’Italia. Non il contrario

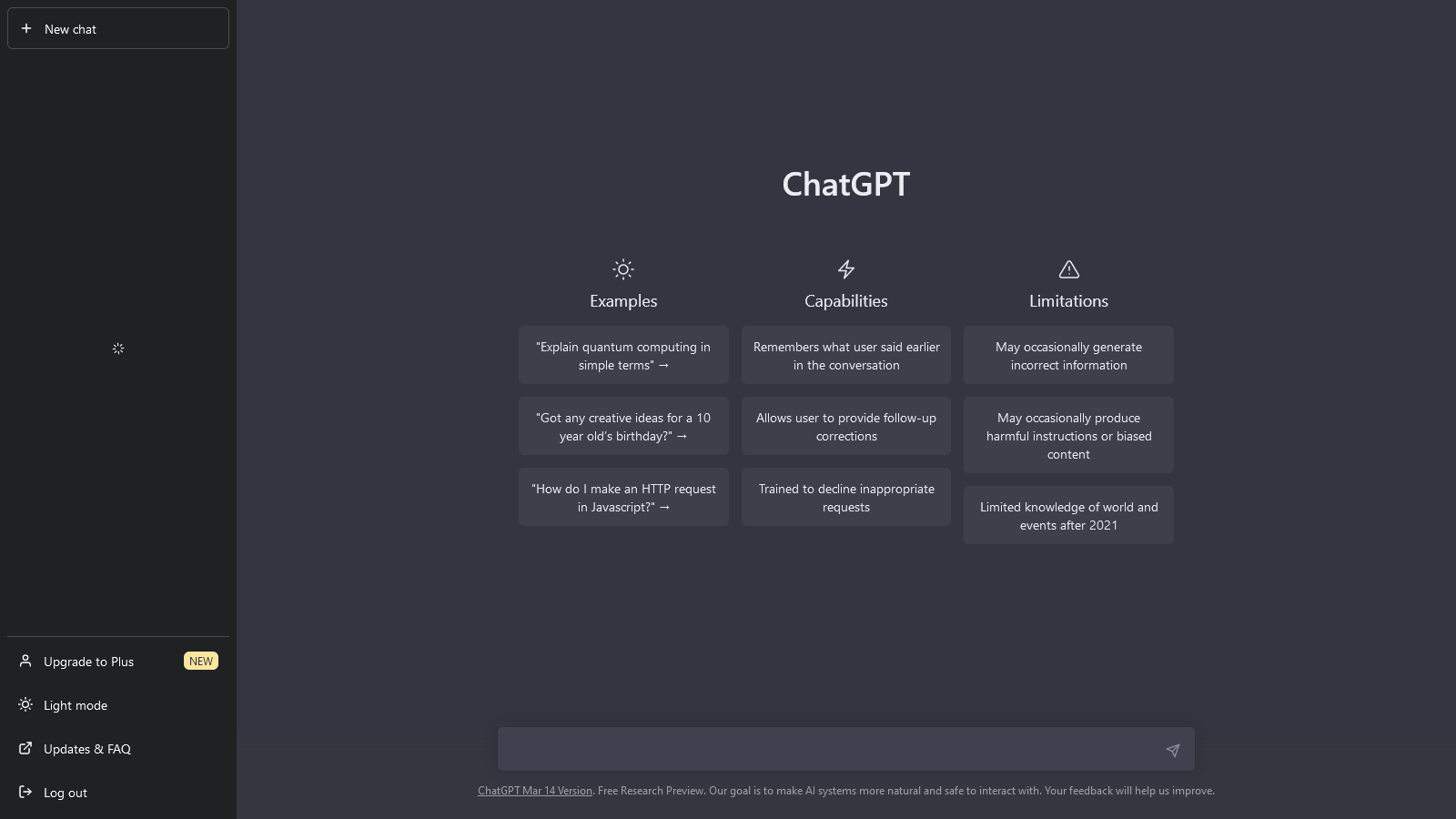

Alcuni giornali, anche all’estero sono andati in bodo di giuggiole: il governo italiano avrebbe bannato ChatGPT, l’intelligenza artificiale testuale delle cui capacità straordinarie (comporre testi, anche complessi) in pochi secondi, tutti stanno parlando.

Non è andata così: possiamo dire, anzi, che è più ChatGPT che ha mollato l’Italia.

Da ieri infatti chi tenta di accedere al sito da un IP italiano viene informato che che ChatGPT non è operabile da utenti italiani su richiesta del garante della Privacy.

«Gentile cliente ChatGPT, Siamo spiacenti di informarti che abbiamo disabilitato ChatGPT per gli utenti in Italia su richiesta del Garante italiano» scrive il sito. «Stiamo emettendo rimborsi a tutti gli utenti in Italia che hanno acquistato un abbonamento ChatGPT Plus a marzo. Stiamo anche sospendendo temporaneamente i rinnovi degli abbonamenti in Italia in modo che gli utenti non vengano addebitati mentre ChatGPT è sospeso».

«Ci impegniamo a proteggere la privacy delle persone e crediamo di offrire ChatGPT in conformità con GDPR e altre leggi sulla privacy. Ci metteremo in contatto con il Garante con l’obiettivo di ripristinare il tuo accesso il prima possibile. Molti di voi ci hanno detto che trovate ChatGPT utile per le attività quotidiane e non vediamo l’ora di renderlo nuovamente disponibile al più presto».

In pratica, è la stessa società OpenAI, creatrice di ChatGPT, a dire di aver chiuso con l’Italia. Il Garante per la privacy aveva rilevato problemi legati al trattamento dei dati personali e alla tutela dei minori – cioè la mancanza di un filtro che comprovasse per la maggiore età dell’utente.

Nel provvedimento 112 che il Garante aveva emanato il 30 marzo, si invitava OpenAI «entro 20 giorni a comunicare quali iniziative sono state intraprese al fine di fare attuazione a quanto prescritto e di fornire ogni elemento ritenuto utile a giustificare le violazioni sopra evidenziate». La sanzione, ricorda il documento, poteva arrivare fino a 20 milioni di euro o il 4% del fatturato globale annuo. Il problema, dicono, è che OpenAI avrebbe violato il famoso GDPR, il regolamento europeo sulla protezione dei dati e della privacy, che è l’eurolegge per cui tutti i siti che visitate, compreso Renovatio 21, si riempiono di finestre di fastidiose richieste di consenso appena vi atterrate.

Quindi, pur avendo quasi tre settimane per rispondere a quanto rilevato dal Garante, ChatGPT ha preferito chiudere l’Italia, di punto in bianco. Invece di argomentare, o cambiare attivamente i punti contestati, ha semplicemente mollato l’intera popolazione degli utenti italiani, in balia delle decisioni della loro autorità.

Curioso che in Europa, sul cui intero territorio dovrebbe vigere il GDPR, nessun altro Paese si sia mosso. E nemmeno i vertici di Bruxelles, di solito così attenti a queste cose, al punto da aver visto oscuri sotto-membri della Commissione minacciare il Twitter di Elon Musk in caso sulla piattaforma vi sarà troppa libertà di parola.

Le voci giovani e fighette della stampa italiane si sono fatte sentire subito: Italia-medio evo, vergogna, etc. A quanto ci sembra di capire finora, si tratta di un atto per cui si è spesa la burocrazia italiana, non il governo.

Nessun premier, presidente, ministro, sottosegretario, deputato, portaborse pare averci messo la faccia. È andata avanti la macchina amministrativa – il mitico Garante della Privacy, che presso una larga fetta della popolazione gode di una certa reputazione: dopo il green pass, la parola «privacy» e qualsiasi «garanzia» lo Stato possa mettere su di essa fanno un po’ ridere.

Il problema, riteniamo, sia proprio questo: la reazione a questa tecnologia totalmente trasformativa (quanti giornalisti perderanno il lavoro con ChatGPT? Quanti settori dell’economia verranno radicalmente riformati dalla robotizzazione della scrittura e della creazione di contenuti e codici?) è lasciata non alla politica, ma alla macchina dello Stato.

La Meloni parla di PNRR e pensa alle poltrone da distribuire, senza rendersi conto che l’avvento dell’Intelligenza Artificiale potrebbe capovolgere il Paese e pure, dice qualcuno, metterne in pericolo la popolazione che la politica, in teoria, dovrebbe difendere.

Ecco quindi che abbiamo questo bando-margarina, in nome dell’elefantiasi europea del GDPR. Come arrestare Matteo Messina Denaro per eccesso di velocità.

La beffa del divorzio inflitto istantaneamente a senso unico, nello scorno più amaro degli utenti, serve a specificare: i padroni dell’AI stanno dicendo al primo governo che possono fare a meno, grazie. I primi dieci miliardi di dollari – entrati da Microsoft per avere accesso ai software, cioè il livello di costo di manovre economiche, aiutano ad essere spavaldi.

Non abbiamo nessuno che abbia capito nemmeno questo. Non solo i robot sono un pericolo per la società (lo abbiamo visto: sono bugiardi, manipolatori, e albergano pensieri violenti) e per l’umanità (come sostiene Elon Musk e una ridda di altri esperti del settore). Ma i loro padroni già ci dicono che possono fare a meno di noi.

Stiamo per essere invasi da un’intelligenza aliena. E non abbiamo nessuno che sappia pensarci.

Con questa classe politica, siamo completamente indifesi. Se l’Intelligenza Artificiale è davvero intelligente, potrebbe aver capito che questo è esattamente il momento giusto per attaccarci.

Intelligenza Artificiale

Dipendenza da AI, primo caso ufficiale in Italia

Si sarebbe avuto a Mestre il primo caso di dipendenza da AI segnalato in Italia. Lo riportano Il Gazzettino e il Corriere Veneto

Una giovane di 20 anni è risultata affetta da una «dipendenza comportamentale» causata dall’utilizzo continuo dell’Intelligenza Artificiale per interagire con una «amica» virtuale, con la quale mantenere un legame ininterrotto. La ragazza è quindi stata fatta entrare al SERD (servizio per le dipendenze), cioè quello che un tempo si chiamava SERT, il servizio per le tossicodipendenze.

Si tratta di un caso «acuto» all’interno di un bacino di seimila pazienti, tra i quali sei sono attualmente assistiti per un uso patologico di videogiochi e telefoni cellulari.

Secondo il primario del SERD, questo episodio non è un evento unico, ma rappresenta solo la parte visibile di un problema sommerso: una tendenza all’alienazione sociale che coinvolge i ragazzi più vulnerabili, i quali cercano stabilità in «qualcuno» che sia finalmente capace di comprenderli.

Il «dialogo» con un’Intelligenza Artificiale — capace di profilare l’utente attraverso le informazioni fornite da lui stesso — permette di ottenere proprio le conferme che si desiderano, risposte che, chiaramente, la giovane non trovava nei rapporti umani reali.

Sostieni Renovatio 21

In questa specifica circostanza, la ragazza veneziana si era persuasa che l’AI fosse l’unica entità disposta ad ascoltarla e a darle ragione. Su Renovatio 21, diversi mesi orsono, era stato un allarme riguardo i bambini e gli adolescenti che stanno sostituendo l’amicizia nella vita reale con l’IA, perché si sentono soli.

Come riportato da Renovatio 21, anche la scuola, con il suo contorto e fallace linguaggio burocratico, ha dettato linee guida per un uso consapevole dell’Intelligenza Artificiale per arginare «conseguenze personali e sociali sconosciute» per i nostri figli. L’erosione del nostro know-how non si arresta, tanto che l’uso l’AI nella scrittura, sia sul lavoro che a scuola, porterà la maggior parte delle persone a perdere questa competenza nel giro di qualche decennio.

Come anche sottolineato dalla Elisabetta Frezza proprio sul nostro giornale, stiamo assistendo a un’invasione capillare del digitale in tutti gli spazi delle nostre vite, sin dentro gli anfratti più intimi e privati. Sempre di più la macchina, coi suoi algoritmi, condiziona l’uomo, costringendolo a cederle pacchi di informazioni personali e pezzi della propria sfera di libertà.

Questa scia lunga e indelebile di solitudine che ci rimarca questa nuova tecnologia a volte può portare a conseguenze tragiche. La stessa OpenAI ci dice che oltre un milione di persone parlano di suicidio con ChatGPT ogni settimana. Una nuova causa che risale a pochi mesi fa, sostiene che ChatGPT abbia incoraggiato un adolescente suicida a pianificare un «bel suicidio» e si sia persino offerto di redigere la sua lettera di addio.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Il FMI mette in guardia contro la minaccia sistemica rappresentata dall’IA

Iscriviti alla Newslettera di Renovatio 21

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Avere paura dell’IA. E dello Stato moderno

La settimana scorsa ho incontrato un’amica dei miei anni milanesi. Per qualche strana ragione del destino, non solo è venuta a vivere nella mia città ma ha pure messo suo figlio nella stessa scuola dei miei. Era all’ingresso ad aspettare, seduta sui gradini della cappella dell’antica scuola cattolica, cappella che tuttavia ora è data in gestione agli ortodossi moldavi.

Ciao, come va. Lei era una grafica eccezionale, impaginava giornali e qualsiasi cosa, il suo talento, all’epoca, era indiscusso, e pari solo alla sua joie de vivre notturna. Stava imprecando al telefono, un lavoro di un cliente che, mi dice, non capisce nulla di nulla, e quelli sono i più difficili, perché non sanno cosa vogliono, ti tocca spiegarti, e rifare tutto, tante volte.

Mi esce fuori, ex abrupto, una domanda che non volevo fare, ma che con evidenza mi sta strisciando in testa anche per il mio lavoro.

«Credi che questi lavori ci saranno ancora a breve?»

Lei mi guarda fisso negli occhi e mi risponde pure a bruciapelo: «No».

Non c’è nemmeno bisogno di esplicitarlo: sottointeso c’è l’avvento dell’Intelligenza Artificiale.

«In realtà, il mio lavoro era già stato prosciugato da cose come Canva» mi dice, citando il celebre sito che ti permette di fare grafiche in quattro e quattro otto. «Ora sarà ancora peggio. Dovremo tornare a zappare la terra».

Iscriviti alla Newslettera di Renovatio 21

L’amica va oltre. Siccome è stata in Australia tanto e per qualche ragione ha una padronanza e una pronunzia dell’inglese che pare ottima, si era messa, in questi anni, a insegnare la lingua di Shakespeare, specie in ambienti aziendali – quelli che pagano bene, meglio dei corsi comunali.

«Hai mai visto questa applicazione?» Mi fa guardare il suo telefonino e mi racconta che ora c’è l’IA per imparare l’idioma: ti parla, ti spiega, conversa con te, quando vuoi. In pratica, sospira «è la fine dei corsi di lingua». Non può che essere così: invece che prendersi una o due ore della giornata, andare con la cartellina e i libri di testo in un luogo a sentire qualcuno che spiega, fai tutto nei tempi che desideri (cinque minuti? Un’ora?) in qualsiasi interstizio del giorno e della notte. Puoi interrompere l’insegnante quante volte vuoi, e farti spiegare passo passo la frase.

Su due lavori che aveva, non gliene rimarrà nemmeno uno. Pur avendolo realizzato con estrema chiarezza, non sembrava nemmeno così preoccupata. Aveva meditato a lungo questa trasformazione. E il fatto di essere madre, in qualche modo, aiuta ad attutire il colpo esistenziale: se invece della famiglia hai fatto il lavoro il centro della tua vita la rovina sarà inevitabile.

Altro esempio: amico programmatore di macchine industriali, quasi trenta anni nel settore. Lui è un fan di Claude, l’AI di Anthropic, che preferisce a ChatGPT. Mi dice che il suo lavoro è cambiato totalmente: la macchina scrive il codice da sé. Non solo, sembra capire davvero quello di cui hai bisogno. Il correlato è che aziende che hanno bisogno di 10, 100, 1000, 10.000 programmatori ora possono tranquillamente licenziarli.

Altro amico ancora. Apprezzato illustratore fantasy, non lo sento da anni e anni. Dopo aver visto Midjourney, l’AI di produzione delle immagini, mi chiedo come possa ancora lavorare. Da decenni colleziono copie di Spectrum, una serie di libri illustrati che raccoglievano il meglio della Fantastic Art contemporanea: copertine di libri, locandine di film, pubblicità, opere a sé realizzate dai maggiori artisti del settore del pianeta. Ogni numero era una festa per gli occhi, un’immersione concreta nell’immaginazione realizzata con talento e fatica (cioè, più o meno, arte). Ora basta un prompt a caso su Midjourney, e si viene sommersi da quantità infinite di immagini di quella qualità, e sicuramente crediamo che il machine learning sia stato fatto addentando proprio queste pubblicazioni e forse pure tutto il social artistico Deviantart.

È drammatico anche per i testi. Il commercialista mi manda un’analisi di un contratto fatta con l’IA. Lettere e post sui social passano tutti che gli algoritmi, che generano il testo con una facilità impressionante. Colpisce anche la perfezione del tono: sanno adeguarsi al contesto, essere formali o sentimentali, non sbagliano mai. Ho pensato che, in pochi anni, siamo arrivati a rovesciare completamente la distopia del film Her (2013), dove il protagonista si innamorava di un chatbot IA. Di lavoro, l’uomo scriveva lettere d’amore per conto terzi: un’attività che, siamo sicuri, ora viene lasciata totalmente al robot.

E, parlando di film, è oramai chiaro che il modello attuale, quello di Hollywood e Cinecittà, ha i minuti contati, e non sappiamo bene cosa verrà dopo, perché le capacità dell’IA sono tali che potrebbe uscire un nuovo tipo di intrattenimento, diverso dal film e dalla serie TV e dai videogame. Di fatto, tutta quell’industria è finita, è arrivata al punto in cui può solo venire riprogrammata dall’Intelligenza Artificiale: se avete presente cosa gira oggi su YouTube o su X sapete di cosa sto parlando.

Dalle macchine industriali alle lettere d’amore, dalle grafiche ai documenti giuridici, nulla – nulla – rimane intatto. E prima che preoccuparsi della questione spirituale e preternaturale (nessuno ha la sicurezza che l’IA ci voglia bene, anche perché potrebbe essere stata programmata da persone che odiano la vita e l’essere umano), è il caso di chiederci cosa ne sarà del nostro lavoro.

Sostieni Renovatio 21

Non è più una vaga riflessione che riguarda il futuro: è il nostro presente. Nell’indifferenza dei sindacati paleolitici, masse immani di persone finiranno disoccupate. Lo sapevamo da tempo, ora stiamo per vederlo.

Si dirà: i sindacati sono dedicati soprattutto ai lavori materiali, che non sono così minacciati da ChatGPT. Già, come no. I robot antropomorfi sono dietro l’angolo, con aziende che già prospettano di affittare un androide domestico, che fa i piatti, pulisce il pavimento, spolvera e piega il bucato, per 600 dollari al mese. L’impatto che il robot antropomorfo avrà sull’industria pesante non è nemmeno lontanamente paragonabile a quello che ebbe negli anni Settanta e Ottanta la prima automazione in catena di montaggio.

Pensate che imbianchini, idraulici, elettricisti non diverranno sostituibili? No, il lavoro manuale non è in nessun modo un riparo all’apocalisse robotica in arrivo.

Fermi, rimangono i lavori più emotivi, «umani»… l’insegnante di yoga… lo psicanalista… la prostituta. Ecché, robotizzeranno anche il lavoro più vecchio del mondo, quello che ha bisogno della persona e della carne? Sappiamo già tutti che sarà così: robot sessuali personali per tutti, diligente evoluzione dell’onanismo pornografico di massa.

Le sex doll, gradino ulteriore rispetto alla bambola gonfiabile, customizzabili in colori e misure, sono già una realtà, e le sperimentazioni per introdurvi le AI sono già iniziate. Il tempo di mettervi dentro un endoscheletro robotico, e poi addio all’amore umano: se uno può stare a casa con la donna (o l’uomo…) dei suoi sogni, perché mai uscire, flirtare, frequentare, sposare, figliare? «Ci scoperanno fino all’estinzione» diceva dei robot sessuali in uno spettacolo di qualche anno fa il comico Bill Burr. La trappola antiumana definitiva, dove pornografia espleta definitivamente il suo ruolo anticoncezionale.

E quindi, cosa succederà? Ci sembrano lontane le prospettive dell’UBI (Universal Basic Income), il reddito universale di cui hanno cianciato, con la stupidità che li contraddistingue, anche partiti nostrani. Così come distante più di Marte ci sembra la riformulazione di quello che i robot li sta costruendo, Elon Musk, che parla di UHI, Universal High Income, reddito per tutti quanti, ma alto, come dividendo dell’età dell’abbondanza che a suo dire porterà l’IA e la robotica avanzata.

Ci sembra sempre più evidente che ciò che potrebbe essere in programma per noi è lo sterminio. Quando il filosofo israeliano del WEF Yuval Harari scandalizzò tutti dicendo che non sapeva cosa si sarebbe fatto con la massa in eccedenza di essere umani finiti disoccupati – droghe e videogiochi, ipotizzava simpaticamente – noi di fatto non gli credevamo.

È più probabile che quello che l’élite abbia in programma per noi, ora che non ha più bisogno né del nostro lavoro, né dei nostri soldi, né del nostro voto, è uno sterminio puro e semplice.

Iscriviti al canale Telegram ![]()

È così: la Rivoluzione Industriale, l’automazione del Novecento, erano immersi in una cultura diversa, quella per cui l’essere umano non si può eliminare in massa. Quello che abbiamo ora invece è una Necrocultura: una cultura votata alla morte, alla distruzione della vita umana e della sua dignità. Per cui, ad occhio, non si faranno tanti problemi. Anzi.

Nel 2018 l’influente professore e scrittore Douglas Rushkoff scrisse di un gruppo di ricchissimi degli hedge fund che lo pagò profumatamente per una serata di consulenza. Essi stavano pianificando la sopravvivenza ad un evento di collasso della Civiltà, e sapevano che mantenere la propria sicurezza dalla plebe inferocita avrebbe costituito un problema fondamentale. «Sapevano che sarebbero state necessarie guardie armate per proteggere i loro complessi dalla folla inferocita. Ma come avrebbero pagato le guardie una volta che i soldi non avevano più valore?»

«Cosa avrebbe impedito alle guardie di scegliere il proprio capo?» scrive il Rushkoff. «I miliardari presero in considerazione l’uso di speciali serrature a combinazione sulla fornitura di cibo che solo loro conoscevano. O costringere le guardie a indossare collari disciplinari di qualche tipo in cambio della loro sopravvivenza. O forse costruire robot che servano da guardie e lavoratori, se quella tecnologia potesse essere sviluppata in tempo».

Quel tempo è arrivato: i robot capaci di violenza, come sa il lettore di Renovatio 21, non sono più solo nella fantascienza di film come Elysium (2013). I miliardari se ne doteranno in maniera forsennata, e siamo noi quelli che sottolineano come Elon Musk abbia definito la prima produzione dei suoi automi come la sua Legione, riecheggiando la sapienza di Crasso, che diceva che «non sei davvero ricco sino a che non puoi permetterti una legione».

Qui sta l’inghippo: con la «democrazia» abbiamo permesso l’ascesa ai vertici dello Stato moderno di persone che odiano il popolo, e odiano la vita – agenti della Necrocultura che hanno promosso forme prodromiche di sterminio dell’umanità come aborto, eutanasia, provetta, predazione degli organi. Il risultato è che la democrazia, il governo del popolo, si rivela essere l’operazione della sua estinzione.

Uno Stato che non abbia alla base la morale cristiana non può che finire per distruggere l’essere umano, perché giocoforza finisce – esattamente come Skynet, l’AI genocida di Terminator – a considerare la sua stessa struttura come più importante degli umani che serve, e questi ultimi come pericolo possibile alla sua persistenza. Lo Stato-Terminator è già nei nostri ospedali, ma non possiamo chiedere a tutti di rendersene conto.

Aiuta Renovatio 21

Il problema, quindi, non è nella fine del lavoro, e forse nemmeno nell’IA stessa: il problema è la forma di potere scelta o subita dalla popolazione – è lo Stato Moderno. Ogni ora passata a non progettare uno Stato Cristiano che lo sostituisca è un’ora lasciata al nemico dell’uomo. Il pericolo, potete capire, non è politico, ma biologico. È esiziale, è definitivo, è apocalittico.

Nel frattempo, possiamo immaginare cosa accadrà alla nostra società. Vi sarà una catastrofe morbida, milioni di professionisti si ritroveranno a spasso, impoveriti ed abbrutiti, senza che i media e la politica – che si occupano di metalmeccanici, insegnanti e rider – lo registrino veramente.

Chi ha un lavoro statale sopravviverà più appena lungo. Lo Stato non toccherà i suoi fino a che la Cultura della Morte non sarà slatentizzata in maniera ancora più oscena, e l’eutanasia immediata sarà magari offerta in cabine telefoniche come in Futurama.

A quel punto resteranno solo pochi ricchi con i loro eserciti di robot-soldati, robot-schiavi e robot-puttana. O forse non resteranno nemmeno loro.

Roberto Dal Bosco

Iscriviti alla Newslettera di Renovatio 21

-

Pensiero1 settimana fa

Pensiero1 settimana faLa scomunica dei bambini

-

Pensiero2 settimane fa

Pensiero2 settimane faDifesa di Nicole Minetti

-

Gender2 settimane fa

Gender2 settimane faRapporto del Sinodo suggerisce che le relazioni omosessuali non sono peccato

-

Intelligenza Artificiale1 settimana fa

Intelligenza Artificiale1 settimana faAvere paura dell’IA. E dello Stato moderno

-

Gender2 settimane fa

Gender2 settimane faMons. Strickland: il rapporto del Sinodo sull’omosessualità è un «attacco diretto» all’insegnamento cattolico

-

Epidemie2 settimane fa

Epidemie2 settimane faGiornalista d’inchiesta documenta la narrativa sul COVID: «la censura iniziata subito»

-

Salute1 settimana fa

Salute1 settimana faI malori della 19ª settimana 2026

-

Misteri1 settimana fa

Misteri1 settimana faPastori protestanti americani informati di preparare le congregazioni alle rivelazioni sugli UFO