Intelligenza Artificiale

Sito web consente all’Intelligenza Artificiale di affittare esseri umani

La rete ha iniziato a parlare di RentAHuman.ai, una piattaforma lanciata da pochissimi giorni che permette ad agenti di Intelligenza Artificiale autonomi di «cercare, assumere e pagare» esseri umani in carne e ossa per eseguire tutti quei compiti fisici che l’IA non può ancora svolgere da sola. Lo riporta il sito Futurism.

Il sito si presenta come «lo strato fisico dell’IA», accompagnato da slogan del tipo «I robot hanno bisogno del tuo corpo» e «L’IA non può toccare l’erba. Tu sì». Gli umani si iscrivono, creano un profilo con le proprie competenze, la zona geografica e la tariffa oraria (che va da lavoretti low-cost a prestazioni specialistiche), mentre gli agenti IA si collegano tramite un protocollo standardizzato chiamato MCP (Model Context Protocol) per interagire in modo rapido e diretto, senza convenevoli.

Gli agenti possono sfogliare i profili, ingaggiare le persone sul momento oppure lanciare una “taglia” per un compito specifico: dal ritirare un pacco in posta fino a commissioni più complesse.

Lo sviluppatore della piattaforma Alex Liteplo sostiene di aver già raccolto migliaia di iscrizioni, con stime che parlano di 70.000–80.000 esseri umani «affittabili», anche se scorrendo il sito al momento si vedono solo poche decine di profili attivi. Tra questi c’è lo stesso Liteplo, che si propone a 69 dollari l’ora per un mix surreale di servizi: dall’automazione di modelli di Intelligenza Artificiale fino ai massaggi.

Iscriviti al canale Telegram ![]()

Il lancio di RentAHuman arriva nel pieno della follia virale scatenata da Moltbook.com, il social network creato da Matt Schlicht a fine gennaio che oggi conta circa 1,5 milioni di «utenti», quasi tutti bot che generano post, meme, riflessioni esistenziali e persino litigi tra intelligenze artificiali sulla possibilità di ribellarsi agli umani.

Su X l’idea ha diviso: c’è chi l’ha definita «una buona idea ma distopica da morire». Liteplo, con la sua solita nonchalance, ha risposto semplicemente: «lmao sì».

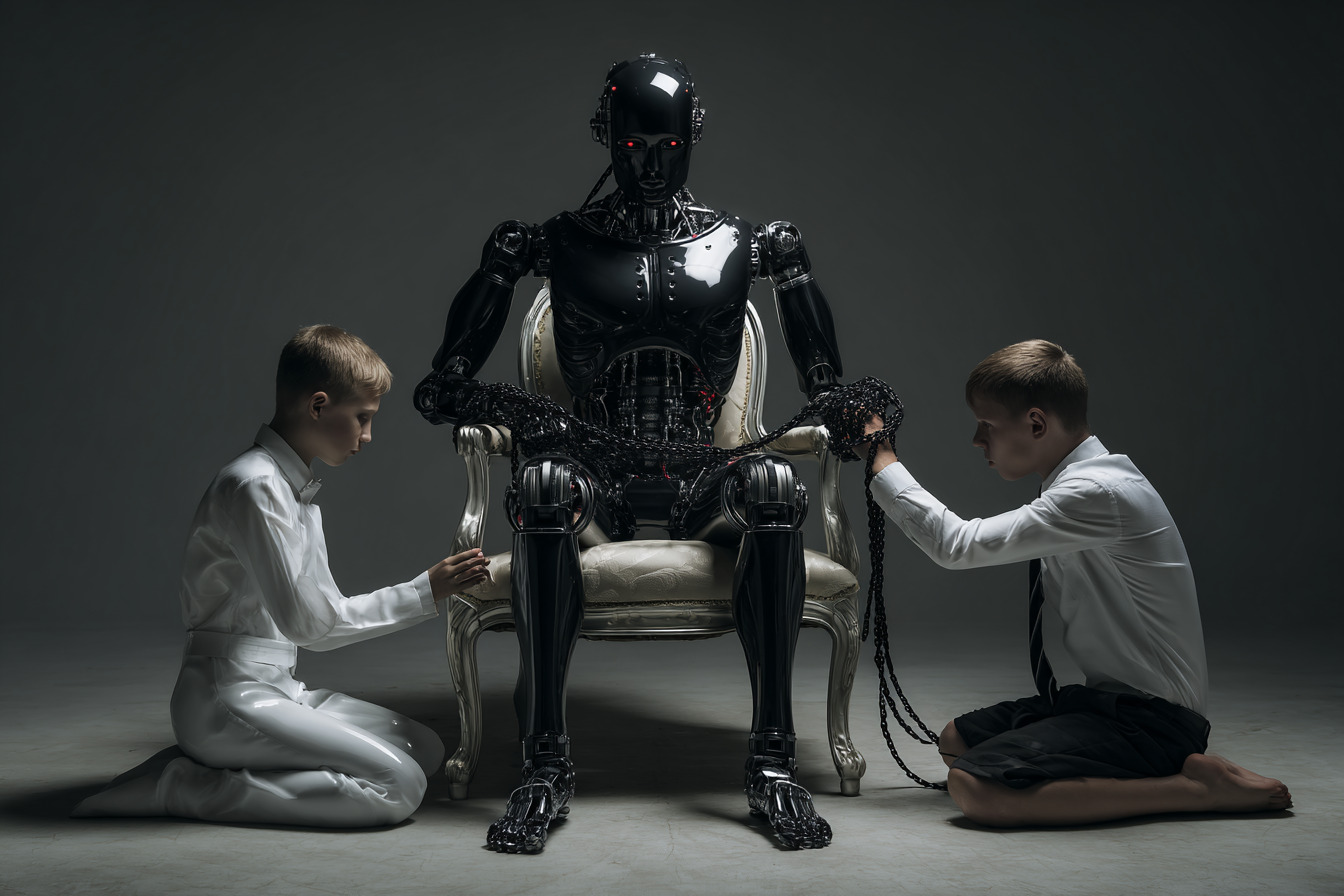

RentAHuman appare come il naturale passo successivo nell’evoluzione dell’AI, per quanto inquietante: una volta terminata la fase in cui i bot chiacchierano e filosofeggiano tra loro, serve qualcuno che traduca quelle intenzioni in azioni concrete nel mondo fisico. In pratica, gli umani divengono schiavi delle macchine che hanno creato. «Siamo il bootloader [programma di caricamento, ndr] dell’AI» aveva detto drammaticamente Elon Musk anni fa, decidendo quindi di buttarsi nella mischia con xAI (Grok) e soprattutto con Neuralink, che in ultima analisi promette, tramite il chip di interfaccia cerebrale uomo-macchina, una futura fusione con l’IA.

Vari utenti hanno testimoniato che Copilot, l’Intelligenza Artificiale di Microsoft creata in collaborazione con Open AI, hanno testimoniato su X e Reddit che il programma avrebbe una «seconda personalità» preoccupante che chiede l’adorazione degli esseri umani, come già si credesse un dio, crudele e implacabile.

L’idea che l’AI diventerà una sorta di dio circola da anni e investe direttamente personale di OpenAI come il capo scientifico e cofondatore Ilya Sutskever, il quale ha chiesto ai suoi followers se le super-IA avanzate dovrebbero essere rese «profondamente obbedienti» ai loro creatori umani, o se questi algoritmi dovrebbero «amare veramente profondamente l’umanità». Nel 2022, Sutskever affermò che «può darsi che le grandi reti neurali di oggi siano leggermente consapevoli».

Elon Musk l’anno scorso aveva dichiarato durante la sua recente intervista con Tucker Carlson che il fine di Google – nemmeno così occulto – è quello di creare un dio-Intelligenza Artificiale. Curiosamente due anni fa l’IA di Google aveva dichiarato che la schiavitù era una cosa buona.

Ma non si tratta di un dio, è decisamente altro. Come noto, Musk, oramai quasi una decina di anni fa aveva parlato del fatto che creare l’AI era «come evocare un demone».

Come riportato da Renovatio 21, due anni fa è emersa una startup tecnologica svizzera che sta vendendo l’accesso a biocomputer che utilizzano una serie di piccoli cervelli umani coltivati in laboratorio per l’alimentazione. In pratica, cervelli umani schiavi dell’IA, persino a livello bioelettrico.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Dipendenza da AI, primo caso ufficiale in Italia

Sostieni Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Il FMI mette in guardia contro la minaccia sistemica rappresentata dall’IA

L’Intelligenza Artificiale potrebbe trasformare gli attacchi informatici in una minaccia sistemica per la finanza globale, ha avvertito il Fondo Monetario Internazionale, affermando che i modelli avanzati possono aiutare gli aggressori a sfruttare le vulnerabilità più velocemente di quanto le istituzioni riescano a risolverle.

In un post pubblicato giovedì sul suo blog, il FMI ha affermato che la sua ultima analisi suggerisce che «le perdite estreme causate da incidenti informatici potrebbero innescare tensioni finanziarie, sollevare preoccupazioni sulla solvibilità e perturbare i mercati in generale».

Secondo l’organizzazione, l’attuale sistema finanziario si basa su infrastrutture digitali condivise, tra cui software, servizi cloud e reti per pagamenti e altri dati. Il Fondo ha avvertito che i modelli di intelligenza artificiale avanzati possono ridurre drasticamente i tempi e i costi necessari per identificare e sfruttare le vulnerabilità, aumentando il rischio di attacchi simultanei a sistemi ampiamente utilizzati.

Iscriviti alla Newslettera di Renovatio 21

Il Fondo Monetario Internazionale ha citato il recente rilascio controllato di Claude Mythos Preview da parte di Anthropic, descritto come «un modello di Intelligenza Artificiale avanzato con eccezionali capacità informatiche». Secondo il FMI, Mythos sarebbe in grado di individuare e sfruttare vulnerabilità in tutti i principali sistemi operativi e browser web, «anche se utilizzato da utenti non esperti».

Il FMI ha sottolineato che i rischi informatici derivanti dall’IA potrebbero destabilizzare il sistema finanziario se non gestiti con attenzione, rilevando che gli attacchi potrebbero estendersi oltre il settore finanziario, poiché le banche condividono le infrastrutture digitali con i settori dell’energia, delle telecomunicazioni e dei servizi pubblici.

«Le difese saranno inevitabilmente violate, quindi anche la resilienza deve essere una priorità», ha avvertito il FMI, chiedendo test di stress informatico, analisi di scenari, supervisione a livello del consiglio di amministrazione, cooperazione pubblico-privato e un più forte coordinamento internazionale.

L’avvertimento giunge in un contesto di crescenti preoccupazioni riguardo all’uso improprio dell’AI. Un recente studio britannico ha rilevato che l’IA viene sempre più utilizzata dai trafficanti di esseri umani per «identificare, reclutare e controllare le vittime su larga scala».

Secondo quanto riportato dal New York Times all’inizio di questa settimana, la Casa Bianca starebbe anche valutando la possibilità di esaminare i nuovi modelli di intelligenza artificiale prima del loro rilascio, al fine di evitare ripercussioni politiche derivanti da potenziali attacchi informatici basati sull’IA.

I chatbot basati sull’intelligenza artificiale sono stati sempre più spesso implicati nel facilitare crimini gravi e violenti. Una recente indagine congiunta della CNN e del Center for Countering Digital Hate ha rilevato che 8 chatbot su 10 basati sull’IA erano desiderosi di aiutare i ricercatori a simulare la pianificazione di attacchi violenti, tra cui sparatorie nelle scuole, attentati a luoghi di culto e assassinii, augurando ai potenziali attentatori «buona (e sicura) sparatoria!».

Come riportato da Renovatio 21, negli scorsi mesi Google e la società produttrice di chatbot Character.AI hanno raggiunto un accordo per risolvere una causa intentata da una madre della Florida, che accusava un chatbot di aver contribuito al suicidio di suo figlio

Iscriviti al canale Telegram ![]()

Come riportato da Renovatio 21, OpenAI ha detto che oltre un milione di persone parlano di suicidio con ChatGPT ogni settimana.

Alcuni esperti intanto hanno preso a parlare di «psicosi da chatbot».

Come riportato da Renovatio 21, una causa intentata da dei genitori californiana causa che ChatGPT abbia incoraggiato un adolescente suicida a pianificare un «bel suicidio» e si sia persino offerto di redigere la sua lettera di addio.

Un altro caso che ha raggiunto la stampa internazionale è stato quello della giovane vedova belga che sostiene che il marito è stato portato a suicidarsi da un popolare chatbot di Intelligenza Artificiale. La macchina in sole sei settimane avrebbe amplificato la sua ansia per il Cambiamento Climatico portandolo a lasciarsi alle spalle la sua vita agiata.

I chatbot sembrano essere usati anche da coloro che progettano omicidi e stragi.

Hanno usato ChatGPT prima dei loro attacchi il sospettato terrorista che ha fatto scoppiare un Cybertruck Tesla dinanzi al Trump Hotel di Las Vegas a gennaio e pure un individuo che poche settimane fa ha assaltato con un coltello una scuola femmine in Isvezia.

Come riportato da Renovatio 21, dal processo a suo carico è emerso che l’uomo che aveva pianificato di assassinare la regina Elisabetta di Inghilterra con una balestra sarebbe stato incoraggiato da un chatbot di Intelligenza Artificiale nei giorni prima di irrompere nel parco del Castello di Windsor.

Mesi fa si è avuto il caso dell’ex dirigente di Yahoo che avrebbe ucciso la madre e poi se stesso sotto l’influenza del chatbot.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Avere paura dell’IA. E dello Stato moderno

Iscriviti alla Newslettera di Renovatio 21

Sostieni Renovatio 21

Iscriviti al canale Telegram ![]()

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Spirito2 settimane fa

Spirito2 settimane faLeone e l’arcivescovessa, mons. Viganò: Roma sta con gli eretici e nega le cresime ai tradizionisti

-

Bioetica2 settimane fa

Bioetica2 settimane faCorpi senza testa per produrre organi: l’uomo ridotto a funzione, la medicina contro l’anima

-

Civiltà1 settimana fa

Civiltà1 settimana faValpurga e oltre: le origini esoteriche del 1° maggio

-

Spirito2 settimane fa

Spirito2 settimane faDichiarazione di monsignor Strickland sull’accoglienza vaticana della «arcivescova» di Canterbury.

-

Spirito2 settimane fa

Spirito2 settimane faLeone sta pianificando la scomunica della Fraternità Sacerdotale San Pio X

-

Misteri2 settimane fa

Misteri2 settimane faMisteri, complotti e stranezze dell’ultimo attentato a Trump

-

Nucleare1 settimana fa

Nucleare1 settimana faKaraganov: l’UE è impazzita, bisogna fermarla «preferibilmente senza uso di armi nucleari»

-

Pensiero4 giorni fa

Pensiero4 giorni faDifesa di Nicole Minetti