Intelligenza Artificiale

La risposta di Zuckerberg all’epidemia di solitudine: creare a tutti amici virtuali AI

Il CEO di Meta Mark Zuckerberg è preoccupato per i suoi miliardi di clienti che fanno amicizia con i chatbot AI, anziché creare legami con esseri umani reali.

In un’intervista con il podcaster Dwarkesh Patel, lo Zuckerberg ha affermato che più persone dovrebbero connettersi con i chatbot a livello sociale, perché non hanno abbastanza amici nella vita reale. Alla domanda se i chatbot AI possono aiutare a combattere l’epidemia di solitudine, il miliardario ha dipinto una visione distopica di un futuro in cui passiamo più tempo a parlare con le IA rispetto agli umani in carne e ossa.

«C’è la statistica che penso sempre sia pazzesca, l’americano medio, penso, ha meno di tre amici», ha detto lo Zuckerberg al Patel.

Zuck on:

– Llama 3

– open sourcing towards AGI

– custom silicon, synthetic data, & energy constraints on scaling

– Caeser Augustus, intelligence explosion, bioweapons, $10b models, & much moreEnjoy!

Links below pic.twitter.com/VYIadc3Jlo

— Dwarkesh Patel (@dwarkesh_sp) April 18, 2024

Sostieni Renovatio 21

«La persona media vuole più connettività, connessione, di quanto non abbia fatto», ha concluso, suggerendo la possibilità che la discrepanza possa essere piena di amici virtuali.

Lo stato attuale dei chatbot AI lascia molto a desiderare. L’intervista in questione è stata pubblicata pochi giorni dopo che il Wall Street Journal ha riferito che i membri dello staff di Meta avevano sollevato preoccupazioni per gli utenti minorenni esposti a discussioni sessualmente esplicite dai chatbot AI della società, alcune, a quanto riportato, fatte da IA con la voce dell’attore e wrestler John Cena. Va ricordato come anni fa alcuni esperti hanno sostenuto che il metaverso, ideale perseguito da Facebook al punto di cambiare nome in appunto Meta, sarà un luogo dove entreranno rapidamente i predatori di bambini: «andranno lì prima per trarre vantaggio dal fatto che è un terreno sicuro per abusare o preparare i bambini».

Il reportage del Wall Street Journal ha rivelato che i chatbot di Intelligenza Artificiale di Meta su Instagram, Facebook e WhatsApp sono in grado di intrattenere con gli utenti «giochi di ruolo romantici» che possono diventare sessualmente espliciti, anche con account appartenenti a minori.

Il sito 404 Media ha riferito che l’app Meta’s AI Studio stava regolarmente consentendo agli utenti di creare bot che sostenevano di essere terapeuti autorizzati, attraversando un confine etico preoccupante che potrebbe portare agli utenti consigli pericolosi.

Ci sono anche immense carenze con i grandi modelli linguistici che alimentano questi chatbot che possono o non possono essere risolti dai futuri progressi. Dalle allucinazioni dilaganti alle lotte con la logica, i critici hanno sottolineato che la tecnologia potrebbe rivelarsi un vicolo cieco.

Nonostante queste carenze e il terreno scivoloso su cui poggiano queste nuove tecnologie distopiche, il creatore di Facebook appoggia fermamente lo sviluppo di questi chatbot, con le complesse implicazioni sociali che potrebbe avere.

I chatbot AI emergeranno davvero come soluzione per una società moderna sempre più solitaria? In qualità di CEO di Meta, Zuckerberg dipende dai suoi azionisti e di conseguenza deve vendere questa nuova visione piena di amici avatar AI. È questo il futuro che le persone sono disposte ad abbracciare e condividersi?

Aiuta Renovatio 21

C’è da considerare come un crescente numero di ricerche evidenzia come i chatbot basati sull’Intelligenza Artificiale possano aggravare le condizioni psichiatriche, soprattutto perché strumenti come ChatGPT, Claude e Gemini vengono sempre più utilizzati non solo in contesti professionali, ma anche in contesti profondamente personali ed emotivi.

Come riportato da Renovatio 21 due anni fa la solitudine fu dichiarata come epidemia dagli USA, divenendo per l’OMS una «priorità sanitaria».

È rilevante notare come dove ci sia un problema sanitario e l’OMS arrivano spesso i miliardari tecnologici, pronti con una soluzione per tutta l’umanità alla malattia. Una soluzione che, ovvio, li fa guadagnare – e della cui inumanità spesso sembrano disinteressati.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Esperti di AI mettono in guardia dai pericoli del «comportamento strategico emergente».

Iscriviti al canale Telegram ![]()

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Scienziato crea un vaccino mRNA per il suo cane usando l’AI

Uno scienziato informatico australiano ha impiegato ChatGPT e Grok per sviluppare una potenziale cura per la sua cagnolina, alla quale era stato diagnosticato un tumore in fase acuta.

Due anni fa, a Rosie, la cagnolina meticcia di Staffordshire Bull Terrier e Shar Pei di Paul Conyngham, è stata diagnosticata una forma aggressiva di mastocitoma, una patologia che colpisce i cani. La chirurgia veterinaria e la chemioterapia hanno rallentato la progressione dei tumori, ma non sono riuscite a ridurne le dimensioni.

Il Conyngham, ingegnere elettrico e informatico nonché cofondatore di Core Intelligence Technologies, si è rivolto a ChatGPT per elaborare possibili trattamenti, prima di sfruttare la sua esperienza nell’analisi dei dati per identificare le mutazioni nel tumore, mappare le proteine alterate mediante AlphaFold e abbinare i potenziali bersagli ai farmaci.

«Il primo passo è stato contattare l’università per far sequenziare il DNA di Rosie. L’idea è di prelevare il DNA sano dal suo sangue e poi il DNA dal suo tumore e sequenziarli entrambi per vedere esattamente dove si sono verificate le mutazioni», ha detto all’Australian.

Iscriviti alla Newslettera di Renovatio 21

I ricercatori del Ramaciotti Centre for Genomics dell’UNSW hanno collaborato al sequenziamento del DNA di Rosie, mentre gli scienziati hanno utilizzato il modello di mRNA elaborato da Conyngham per sintetizzare la nanoparticella del vaccino. Il trattamento è stato somministrato dalla veterinaria oncologa professoressa Rachel Allavena dell’Università del Queensland, che ha supervisionato la terapia sperimentale.

Rosie ha ricevuto la prima iniezione a dicembre, seguita da una dose di richiamo il mese successivo. Nonostante il tumore fosse in stadio avanzato, le condizioni della cagnolina sono migliorate nel giro di poche settimane dall’inizio del trattamento, con una massa tumorale che si è ridotta di quasi la metà. A quanto pare, Rosie ora appare più sana e piena di energia.

Gli scienziati stanno ora sequenziando nuovamente il tumore per progettare un secondo vaccino mirato alle cellule cancerose che non hanno risposto al primo trattamento.

L’inquietante episodio mostra come siano in fase di sviluppo vaccini oncologici personalizzati a mRNA, anche per uso umano.

Come riportato da Renovatio 21, l’intreccio tra AI e sieri genici personalizzati era stata oscuramente annunziato dal miliardario informatico sionista Larry Ellison durante un incontro alla Casa Bianca nelle primissime ore della seconda presidenza Trump che proclamava l’avvio del progetto per lo sviluppo dell’IA detto «Stargate».

«Una delle cose più entusiasmanti su cui stiamo lavorando utilizzando gli strumenti forniti da Sam [Altman] e [Masayoshi Son] è un vaccino contro il cancro», aveva affermato l’Ellison con a fianco il presidente Trump. «A quanto pare, tutti i nostri tumori, i tumori cancerosi, piccoli frammenti di quei tumori fluttuano nel sangue. Quindi puoi fare una diagnosi precoce del cancro con un esame del sangue. E usando l’intelligenza artificiale per guardare l’esame del sangue, puoi trovare i tumori che in realtà minacciano seriamente la persona».

Aiuta Renovatio 21

«La diagnosi del cancro tramite Intelligenza Artificiale promette di essere semplicemente un esame del sangue», aveva continuato Ellison. «Quindi, una volta che abbiamo sequenziato il gene di quel tumore canceroso, puoi vaccinare la persona, progettare un vaccino per ogni singola persona per vaccinarla contro quel cancro».

«E puoi realizzare quel vaccino mRNA, puoi realizzarlo roboticamente con l’uso dell’IA in circa 48 ore», ha aggiunto l’ultramiliardario, da anni stabilmente nella top ten dei più ricchi del pianeta. «Questa è la promessa dell’IA e la promessa del futuro».

Come sottolineato negli anni da Renovatio 21, se non sarà posto un limite, ogni vaccino, in realtà ogni «cura» dell’organismo umano e non, passerà per la genetica, con sieri DNA, RNA, mRNA, microRNA, circRNA, etc.

Iscriviti alla Newslettera di Renovatio 21

Intelligenza Artificiale

Soldati umanoidi testati in Ucraina

Iscriviti al canale Telegram ![]()

Aiuta Renovatio 21

Iscriviti alla Newslettera di Renovatio 21

-

Bioetica2 settimane fa

Bioetica2 settimane faCirconcisione, scoppia l’incidente diplomatico: il Belgio convoca l’ambasciatore americano

-

Morte cerebrale2 settimane fa

Morte cerebrale2 settimane faIl bambino con il cuore «bruciato» e la tremenda verità sui numeri dei trapianti falliti

-

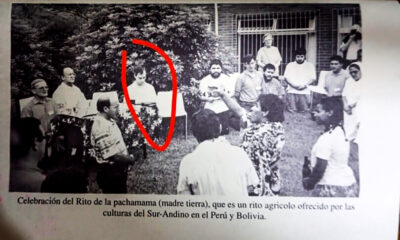

Spirito4 giorni fa

Spirito4 giorni faFoto del 1995 mostra Leone XIV mentre partecipa al rituale idolatrico della Pachamama

-

Vaccini2 settimane fa

Vaccini2 settimane faEsperti affrontano la questione della «massiccia epidemia di danni da vaccino»

-

Pensiero1 settimana fa

Pensiero1 settimana faVerso la legge che fa dell’antisemitismo una nuova categoria dello spirito

-

Senza categoria1 settimana fa

Senza categoria1 settimana faMons. Viganò sta con la famiglia nel bosco. Ma perché lo Stato si sta accanendo in questo modo?

-

Eugenetica2 settimane fa

Eugenetica2 settimane fa«Organi e sperma prelevati dai corpi» nel ranch di Epstein

-

Immigrazione2 settimane fa

Immigrazione2 settimane faIl cardinale Zuppi va all’evento del Ramadan. Poi si preoccupa per le zero iscrizioni al catechismo e la mancanza di famiglie cattoliche